일본 현장 텍스트 이해를 위한 새로운 벤치마크

JaWildText는 일본어 현장 텍스트의 특수성을 반영한 3가지 과제(밀집형 STVQA, 영수증 KIE, 손글씨 OCR)를 제공한다. 2,961장의 실사 이미지와 1.12백만 문자(3,643종)로 구성된 데이터셋을 기반으로 14개의 공개 가중치 비전‑언어 모델을 평가했으며, 최고 성능은 평균 0.64점이다. 오류 분석을 통해 한자 인식이 가장 큰 병목임을 확인했다.

저자: Koki Maeda, Naoaki Okazaki

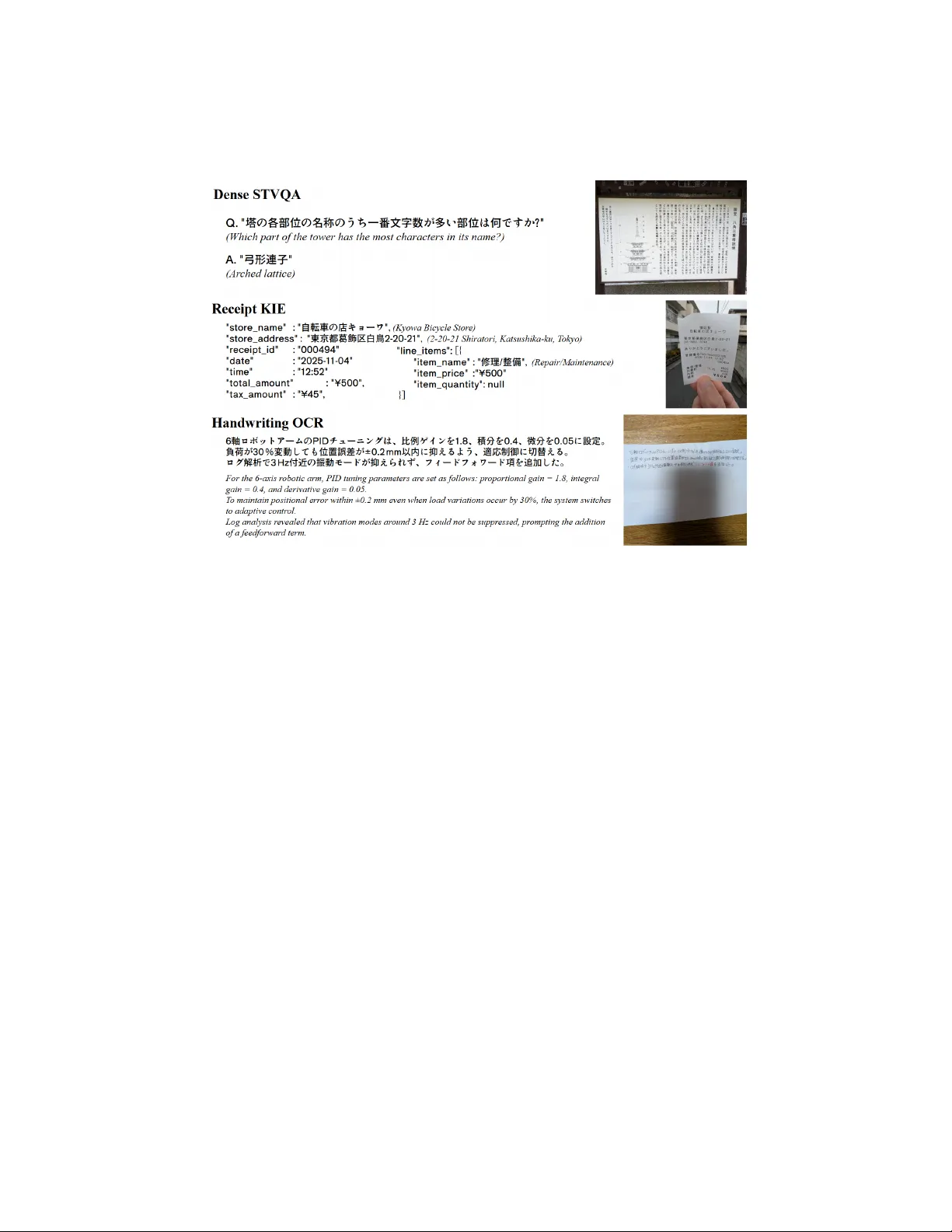

본 논문은 일본어 현장 텍스트 이해를 위한 종합 벤치마크인 JaWildText를 제안한다. 기존 다국어 벤치마크는 언어별 특성을 충분히 반영하지 못하고, 일본어 전용 데이터는 주로 스캔 문서에 국한돼 있었다. 이를 보완하기 위해 저자들은 일본 전역에서 실제 촬영한 2,961장의 이미지를 수집하고, 총 1.12백만 문자(3,643종)를 라벨링했다. 데이터는 세 가지 과제로 구성된다. 첫 번째는 Dense Scene Text Visual Question Answering(STVQA)로, 복잡한 간판·포스터 등에서 여러 텍스트 영역을 읽고 논리적으로 결합해 질문에 답한다. 각 질문은 최소 증거 영역을 명시해 인식 오류와 추론 오류를 구분한다. 두 번째는 Receipt Key Information Extraction(KIE)으로, 모바일 촬영 영수증에서 상점명·날짜·총액·품목명·가격·수량 등 구조화된 필드를 추출한다. 필드별 라벨링과 null 표시를 통해 추출 실패와 인식 실패를 명확히 구분한다. 세 번째는 Handwriting OCR로, 51명의 필기자가 100여 개 주제에 대해 수평·수직으로 작성한 페이지 수준 손글씨 데이터를 제공한다. 필기 오류도 그대로 보존해 시각적 인식 정확도를 평가한다. 저자들은 14개의 공개 가중치 비전‑언어 모델을 평가했으며, 최고 모델조차 평균 0.64점에 불과했다. 오류 분석 결과, 한자 인식률이 낮아 전체 성능을 크게 제한하고, 일부 모델은 텍스트를 정확히 읽었음에도 추론 단계에서 오류를 범한다는 점을 확인했다. 이러한 결과는 일본어와 같이 문자 종류와 레이아웃 변동성이 큰 언어에 대해 현재 VLM이 근본적인 OCR 성능에 크게 의존하고 있음을 보여준다. 논문은 데이터셋과 평가 코드를 Apache 2.0 라이선스로 공개하여, 향후 연구자들이 스크립트별 OCR 개선, 레이아웃 인식 강화, 그리고 인식‑추론 통합 모델 개발에 활용할 수 있도록 한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기