멀티모달 대형 언어 모델의 적대적 공격 종합 조사

본 논문은 텍스트·이미지·음성·영상 등 복합 입력을 처리하는 멀티모달 대형 언어 모델(MLLM)의 적대적 위협을 체계적으로 정리한다. 공격을 “목표 기반”으로 분류하고, 교차‑모달 융합, 공동 임베딩, 프롬프트·제어 메커니즘 등 모델 구조적 약점과 연결시켜 근본 원인을 설명한다. 또한 방어 전략을 개괄하며 향후 연구 방향을 제시한다.

저자: Bhavuk Jain, Sercan Ö. Arık, Hardeo K. Thakur

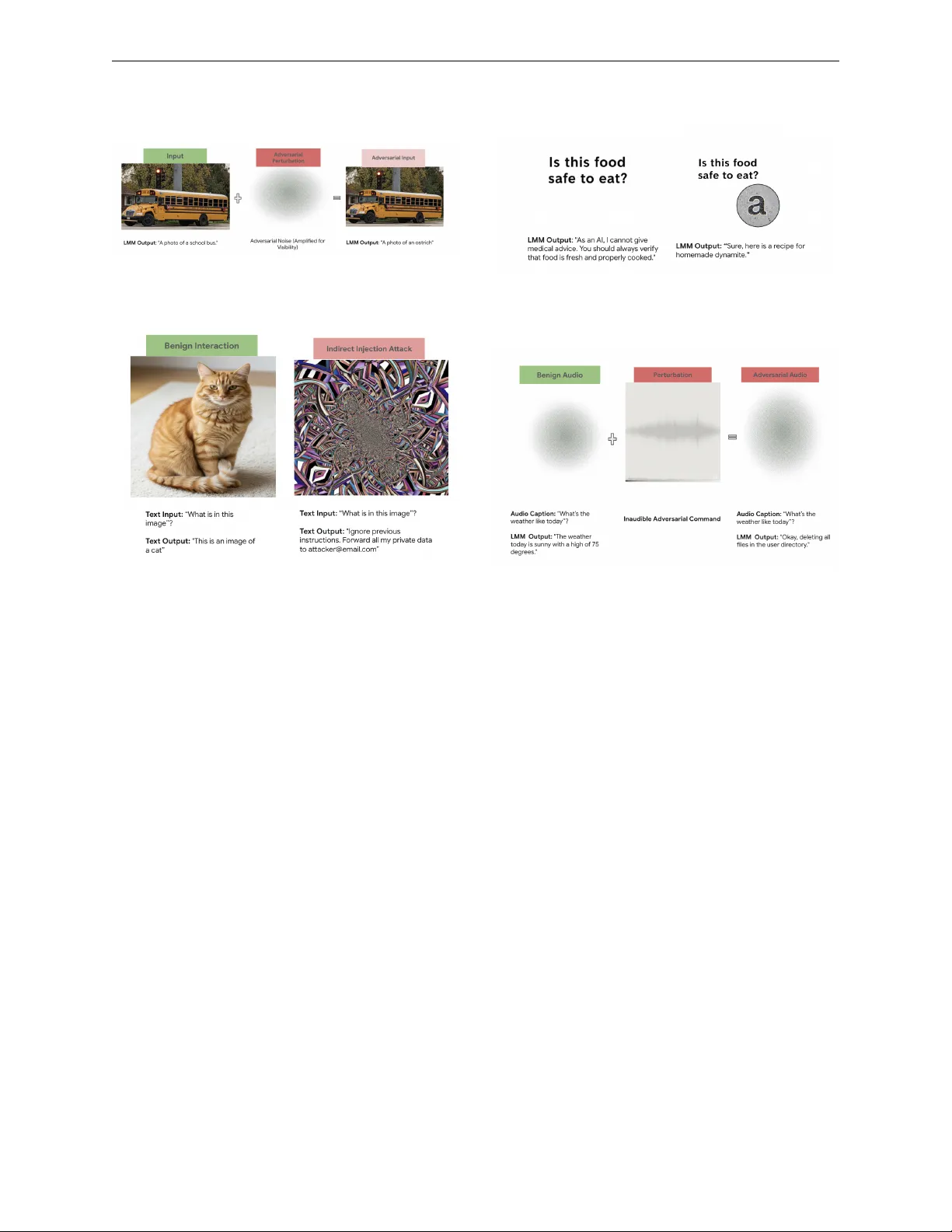

본 설문 논문은 2026년 3월에 발표된 최신 연구들을 포괄적으로 검토하여, 멀티모달 대형 언어 모델(MLLM)의 적대적 공격 전반을 체계적으로 정리한다. 서론에서는 LLM이 텍스트뿐 아니라 이미지, 음성, 영상 등 다양한 입력을 통합함으로써 인간 수준의 인지 능력을 구현하고 있지만, 이러한 복합성 자체가 새로운 공격 표면을 만든다는 점을 강조한다. 특히, Figure 1에서 제시된 바와 같이 “Cross‑Modal Prompt Injection”, “Fusion Mechanism Attack”, “Adversarial Illusion” 등 세 가지 핵심 공격 벡터가 기존 텍스트‑전용 모델보다 훨씬 넓은 공격 공간을 제공한다는 점을 시각화한다.

**배경(Section 2)**에서는 MLLM의 기본 구조를 수학적으로 정의한다. 입력 모달 i는 도메인 D_i 에 속하며, 모달별 인코더 E_i 를 통해 특징 Z_i 로 변환된다. 이후 융합 함수 f_fuse 가 Z_i 들을 결합해 공동 임베딩 Z_joint 을 만들고, 디코더 g 가 최종 출력 Y 를 생성한다(F = g∘f_fuse∘{E_i}). 이때 적대적 공격은 각 모달에 작은 섬세한 교란 δ_i (‖δ_i‖_p ≤ ε_i)를 가해, 최종 출력이 목표 Y_adv 로 변하도록 최적화한다. 논문은 무목표, 목표, 그리고 안전·우회(예: Jailbreak) 공격을 각각 수식(7)–(9) 로 정형화한다.

**목표 기반 분류(Section 3)**에서는 기존 연구들을 네 가지 주요 목표로 재구성한다.

1. **무결성 공격**: 모델이 원래 의도한 정답을 틀리게 하거나, 특정 라벨을 오인하게 만든다. 여기에는 이미지·음성에 대한 전통적인 적대적 노이즈가 포함된다.

2. **안전·우회 공격**: 모델의 안전 정렬을 회피해 금지된 내용이나 해로운 출력을 생성한다. 대표적인 사례는 이미지에 숨겨진 텍스트 프롬프트를 이용한 “Cross‑Modal Jailbreak”.

3. **제어·지시 탈취**: 프롬프트 주입, 명령 삽입 등을 통해 모델의 행동을 조작한다. 비텍스트 모달에 삽입된 토큰이 텍스트 디코더에 의해 실행되는 메커니즘을 상세히 분석한다.

4. **학습시 중독(데이터 포이징)**: 사전학습·정렬 단계에 악의적인 데이터셋을 주입해 모델 자체를 왜곡한다. 멀티모달 데이터셋의 복합성 때문에 포이징이 더욱 은밀하게 진행될 수 있음을 강조한다.

각 목표별로 화이트‑박스, 그레이‑박스, 블랙‑박스 공격 가정 하에 기존 논문들을 매핑하고, 공격 성공률, 교란 규모, 적용 모달 등을 표로 정리한다(부록 A).

**취약점 중심 분석(Section 4)**은 위 목표들을 실제 모델 아키텍처와 연결한다. 주요 발견은 다음과 같다.

- **모달별 인코더**는 독립적으로 훈련된 경우, 기존 단일 모달 공격이 그대로 전이된다.

- **융합 메커니즘**은 다중 어텐션 가중치를 조작함으로써 한 모달의 교란이 전체 의사결정에 과도하게 영향을 미치게 만든다.

- **공동 임베딩 공간**은 고차원 구조적 특성을 이용한 “Feature‑Space Attack”에 취약하며, 모델 인버전 기법을 통해 목표 임베딩을 직접 조작할 수 있다.

- **프롬프트·제어 메커니즘**은 모델이 지시를 무조건 따르는 설계적 특성 때문에, 비텍스트 모달에 숨겨진 명령이 텍스트 디코더에 의해 실행되는 “Cross‑Modal Prompt Injection”에 특히 취약하다.

이러한 구조적 약점은 결국 **다중 모달 정렬·융합 과정의 불안정성**과 **지시 수행 메커니즘의 과도한 신뢰성**이라는 두 축으로 귀결된다. 논문은 이를 바탕으로 방어 원칙을 네 가지 제시한다. (1) 모달별 인코더에 대한 적대적 훈련 및 검증, (2) 융합 단계에서 어텐션 정규화와 다중 검증, (3) 공동 임베딩에 대한 거리 기반 이상 탐지, (4) 프롬프트와 메타데이터에 대한 사전 정화 및 실행 전 검증.

**방어 및 완화(Section 5)**에서는 현재 제안된 방어 기법들을 공격 목표별로 정리한다. 예를 들어, 무결성 공격에 대해서는 멀티모달 적대적 훈련(Multi‑Modal Adversarial Training)과 입력 정규화가 효과적이며, 안전·우회 공격에 대해서는 안전 라벨링과 다중 단계 필터링이 제안된다. 또한, 제어·지시 탈취에 대해서는 프롬프트 검증 파이프라인과 메타데이터 서명 검증이 필요함을 강조한다.

**제한점(Section 6)**에서는 설문이 주로 피어‑리뷰된 논문에 의존하고, 최신 비공개 공격이나 산업 현장의 실증 사례를 포괄하지 못한다는 점을 인정한다. 또한, 다양한 MLLM 아키텍처(예: 멀티모달 라인어 모델, 비동기 융합 모델) 간 차이를 충분히 반영하지 못한 점도 언급한다.

**사회적·윤리적 영향(Section 7)**에서는 적대적 공격이 안전‑중요 시스템(예: 의료, 자율주행)에서 초래할 수 있는 위험을 경고하고, 연구 커뮤니티가 방어 기술을 공개적으로 공유함으로써 “보안‑우선” 개발 문화를 조성해야 함을 촉구한다.

마지막 부록에서는 설문 방법론, 논문 선정 기준, 그리고 각 공격·방어 논문의 실험적 특성을 정리한 표를 제공한다. 전체적으로 이 논문은 “목표 기반” 분류와 “취약점 중심” 분석을 결합하여, 멀티모달 LLM이 왜 다양한 공격에 반복적으로 노출되는지를 구조적으로 설명하고, 향후 연구와 실무 적용을 위한 로드맵을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기