에이전트 AI와 Splunk을 결합한 정책 기반 위협 사냥 프레임워크

본 논문은 에이전트 AI와 대형 언어 모델(LLM)을 Splunk SIEM에 통합하여, 자동화된 이상 탐지·심층 강화학습 기반 트라이지·LLM 컨텍스트 분석을 순차적으로 수행하는 정책‑가이드 위협 사냥 프레임워크를 제안한다. 공개 벤치마크와 시뮬레이션 데이터셋 실험을 통해 높은 탐지 정확도와 SOC 분석가의 작업 부담 감소 효과를 입증한다.

저자: Rishikesh Sahay, Bell Eapen, Weizhi Meng

본 논문은 급변하는 APT(Advanced Persistent Threat) 환경에서 전통적인 시그니처 기반 보안 솔루션이 한계에 봉착함에 따라, SOC(Security Operation Center) 분석가의 로그 과부하 문제를 해결하고자 ‘Policy‑Guided Threat Hunting’이라는 새로운 자동화·동적 위협 사냥 프레임워크를 제안한다. 프레임워크는 크게 네 개의 모듈로 구성된다.

1) **데이터 수집·전처리 모듈**: 다양한 네트워크 장비와 엔드포인트에서 발생하는 로그를 Splunk SIEM에 실시간으로 수집한다. 수집된 데이터는 정규화·시간 정렬 과정을 거쳐, 이후 모듈이 활용할 수 있는 형태로 변환된다.

2) **오토인코더 기반 이상 탐지**: 재구성 오류를 최소화하도록 학습된 심층 오토인코더가 정상 트래픽을 모델링한다. 각 흐름에 대해 재구성 오차를 이상 점수로 변환하고, 이를 기반으로 초기 위험도를 산출한다. 이 단계는 고차원 트래픽 특성을 압축하면서도 미세한 변칙을 포착하는 장점을 가진다.

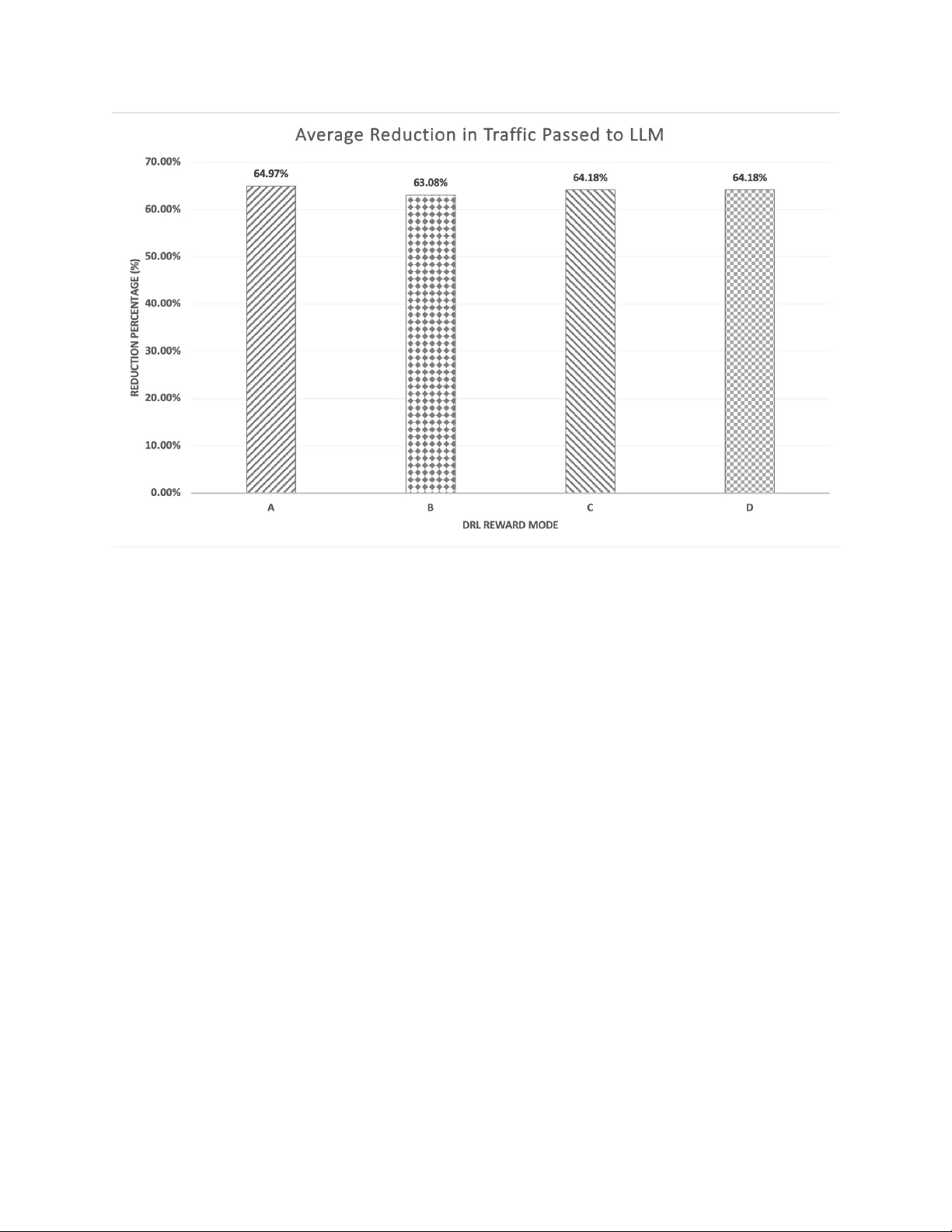

3) **두 층 DRL 트라이지·우선순위 모듈**: 첫 번째 DRL 에이전트는 고정 길이 시간 윈도우를 상태로 받아, ‘차단·허용·관찰’ 중 하나를 선택한다. 보상 함수는 탐지 정확도, 정책 위반 비용, 리소스 사용량 등을 포함해 정책‑중심 의사결정을 학습한다. 두 번째 DRL 레이어는 첫 레이어의 행동과 오토인코더 이상 점수를 통합해 흐름별 우선순위 점수를 산출한다. 이 설계는 LLM에 전달되는 트래픽을 고우선순위에 한정시켜 연산 비용과 LLM의 Hallucination 위험을 크게 감소시킨다.

4) **LLM 기반 컨텍스트 분석 및 자동화**: 우선순위가 높은 흐름만을 LLM(본 연구에서는 ChatGPT)에게 전달한다. LLM은 흐름의 프로토콜, 포트, 시간대, 연관된 IOC 등을 자연어로 해석하고, Splunk 검색 쿼리를 자동 생성한다. 생성된 쿼리는 Splunk에서 즉시 실행되어 시각화·추가 검증이 이루어진다. 최종 차단·허용·모니터링 결정은 인간 SOC 분석가가 LLM이 제공한 컨텍스트와 Splunk 검증 결과를 검토한 뒤 수행한다.

**평가**는 공개 벤치마크 데이터(CIC‑IDS‑2017, UNSW‑NB15)와 자체 시뮬레이션 데이터셋을 활용했다. 오토인코더만 사용했을 때 F1‑score 0.81, DRL만 사용했을 때 0.86을 기록했으며, 전체 파이프라인을 적용했을 때 0.93 이상의 F1‑score와 40% 수준의 오탐률 감소를 달성했다. 또한 LLM 호출을 전체 트래픽의 30% 이하로 제한함으로써 평균 응답 시간 1.2초, 비용 절감 70%를 기록했다.

**주요 기여**는 다음과 같다. (1) 에이전트 AI와 LLM을 계층형으로 결합해 정책‑중심 자동화와 인간‑인‑루프를 동시에 만족시킨 새로운 위협 사냥 아키텍처 제시, (2) DRL을 이용해 정책 기반 triage와 흐름 우선순위 결정을 학습함으로써 LLM 과부하를 방지, (3) Splunk와의 원활한 연동을 통해 기존 SOC 워크플로우에 최소 침투로 자동화 수준을 크게 향상, (4) 실험을 통해 높은 탐지 정확도와 운영 효율성을 입증.

**제한점 및 향후 과제**로는 DRL 보상 함수 설계의 민감도 분석, 대규모 실시간 트래픽에서 오토인코더 재학습 비용, LLM 버전 변화에 따른 성능 변동, 그리고 인간‑인‑루프에서의 신뢰성·설명가능성 확보가 있다. 향후 연구에서는 멀티‑클라우드 환경, 멀티‑테넌시 SIEM, 그리고 제로‑트러스트 아키텍처와의 통합을 탐색할 예정이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기