합성 혼합 학습으로 RAG를 넘어 파라메트릭 지식 습득 확장

** 본 논문은 합성 질문‑답(QA) 데이터와 합성 문서 데이터를 동시에 활용하는 “Synthetic Mixed Training” 방식을 제안한다. 합성 데이터량과 생성 모델 규모를 늘려도 기존 방법은 성능이 포화되지만, 두 종류의 데이터를 결합하면 로그‑선형적으로 성능이 향상되어 RAG(Retrieval‑Augmented Generation)를 2.6%~4.4% 상대적으로 능가한다. 또한 질문에 조건화된 문서 생성을 위한 “Focal Re…

저자: Seungju Han, Konwoo Kim, Chanwoo Park

**

본 논문은 “Synthetic Mixed Training”(SMT)이라는 새로운 합성 데이터 학습 프레임워크를 제안한다. 기존 연구들은 도메인‑제한된 상황에서 파라메트릭 모델이 새로운 지식을 습득하는 데 한계가 있음을 지적했으며, Retrieval‑Augmented Generation(RAG)이 강력한 베이스라인으로 자리 잡았다. 그러나 합성 데이터를 단순히 양을 늘리거나 더 큰 생성 모델을 사용해도 성능이 포화되는 현상이 관찰되었다.

저자들은 먼저 네 가지 합성 데이터 생성 알고리즘을 선정했다. 문서 기반 방법으로는 WRAP(재작성), EntiGraph(엔티티 추출·재구성), Active Reading(AR) 그리고 두 단계 전략을 결합한 AR을 사용했으며, QA 기반 방법으로는 단순 프롬프트를 이용해 질문‑답 쌍을 생성하고, 답변에 짧은 설명을 추가하도록 설계했다. 8B와 70B Llama 3.1 모델을 각각 데이터 생성기에 사용해 최대 700 M 토큰까지 확장했으며, 동일한 하이퍼파라미터(학습률 3가지 탐색, 10% FineWeb 혼합)로 8B 파라메트릭 모델을 훈련시켰다.

실험 결과, 합성 QA는 토큰 효율성이 가장 높아 8B 생성기로도 RAG에 근접했지만 350 M 토큰을 넘어가면 수렴했다. 반면 합성 문서는 70B 생성기로 스케일링했을 때만 토큰 효율이 크게 향상되었으며, AR이 가장 큰 이득을 보였다. 단일 데이터 유형만 사용할 경우, 모든 방법이 4.6% 정도 RAG와의 격차를 유지했다.

이에 저자들은 QA와 문서가 서로 보완적인 학습 신호를 제공한다는 가설을 세우고, 두 데이터를 1:1 비율로 혼합한 SMT를 설계했다. 70B‑생성 QA와 AR 문서를 결합했을 때, 성능은 로그‑선형적으로 상승해 700 M 토큰에서 67.0% 정확도를 기록, RAG 대비 2.6% 상대적 향상을 달성했다. 8B‑생성 데이터에서는 QA가 주도했지만, AR 문서는 강력한 생성기에 의해 큰 효과를 발휘했다.

또한 “Focal Rewriting”이라는 기법을 도입했다. 질문을 입력으로 사용해 문서 생성 과정을 조건화함으로써, 동일 원문에 대해 다양한 주제와 어휘 변형을 생성한다. 이는 합성 문서의 다양성을 크게 늘려, 동일 토큰 양에서도 4.4%의 상대적 정확도 향상을 가져왔다.

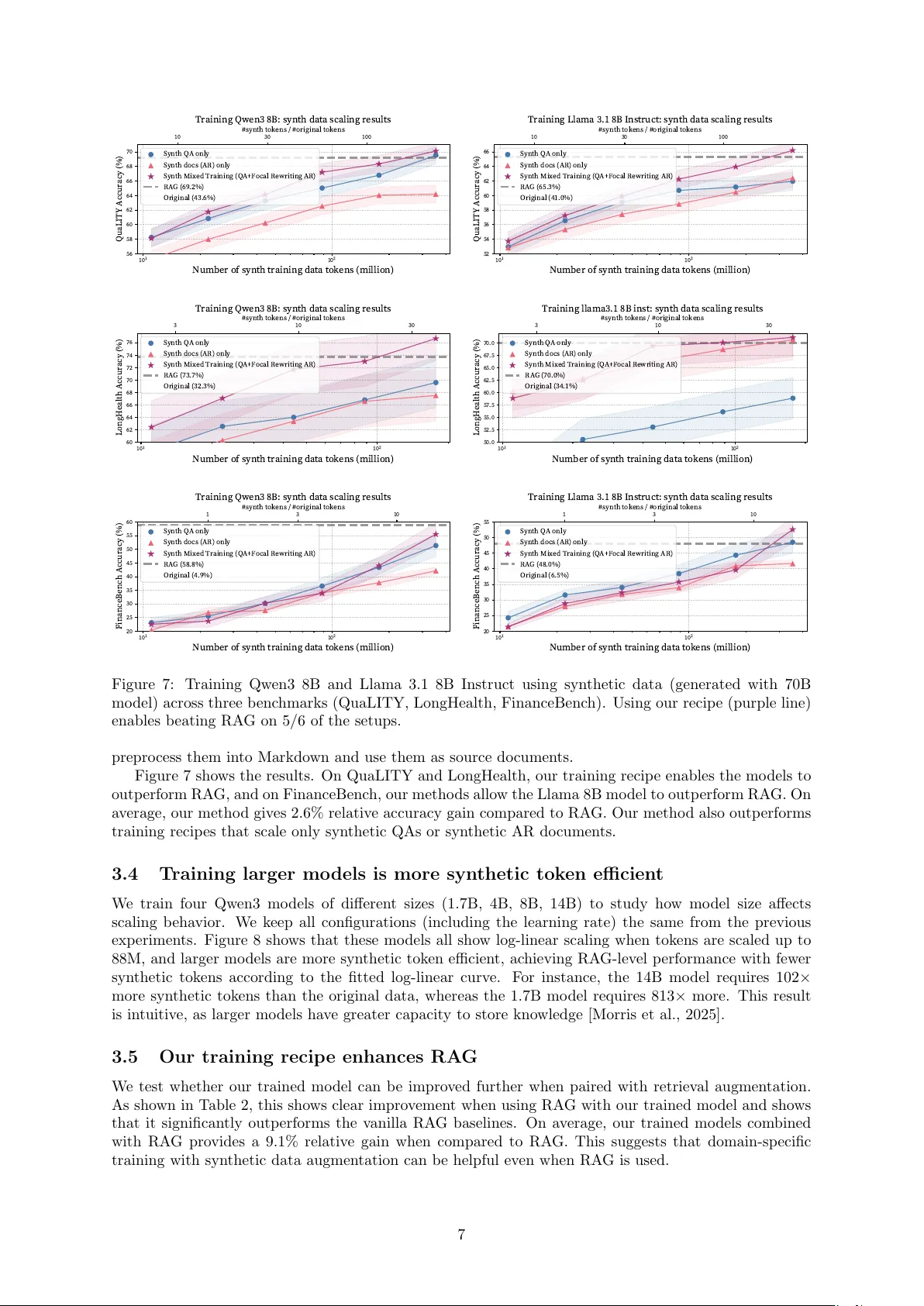

SMT와 Focal Rewriting의 일반화 능력을 검증하기 위해 Qwen‑3(1.7B‑14B) 모델과 세 개 벤치마크(QuaLITY, LongHealth, FinanceBench)에서 실험을 확장했다. 결과는 다섯 개 중 여섯 개 설정에서 RAG를 능가했으며, 평균 2.6%의 상대적 정확도 향상을 보였다. 특히, 타 도메인(LongHealth) 합성 QA와 목표 도메인(QuaLITY) AR 문서를 혼합했을 때, 목표 도메인 문서만 사용할 때보다 토큰 효율이 크게 개선되었다. 이는 QA가 도메인‑불변적인 추론 패턴을 전이시키고, 문서가 도메인‑특화된 사실을 보강한다는 가설을 뒷받침한다.

결론적으로, 이 연구는 (1) 합성 데이터 종류별 스케일링 특성을 정량화, (2) 두 종류를 전략적으로 혼합해 파라메트릭 지식 습득을 RAG 수준 이상으로 끌어올림, (3) 질문‑조건화 문서 생성(Focal Rewriting)으로 데이터 다양성을 강화, 라는 세 가지 주요 기여를 제공한다. 이러한 접근은 대규모 언어 모델이 외부 검색 없이도 최신 지식을 내재화할 수 있는 새로운 길을 제시한다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기