보이지 않는 추적: 암호화 트래픽으로 지리적 추정

GraySense는 암호화된 영상 전송 패킷의 크기와 타이밍만을 이용해 움직이는 객체의 위치를 추정한다. 프레임 경계 탐지와 트랜스포머 기반 트래커를 결합해, 원본 영상 없이도 평균 2.33 m 오차로 차량을 추적한다.

저자: Sadik Yagiz Yetim, Gaofeng Dong, Isaac-Neil Zanoria

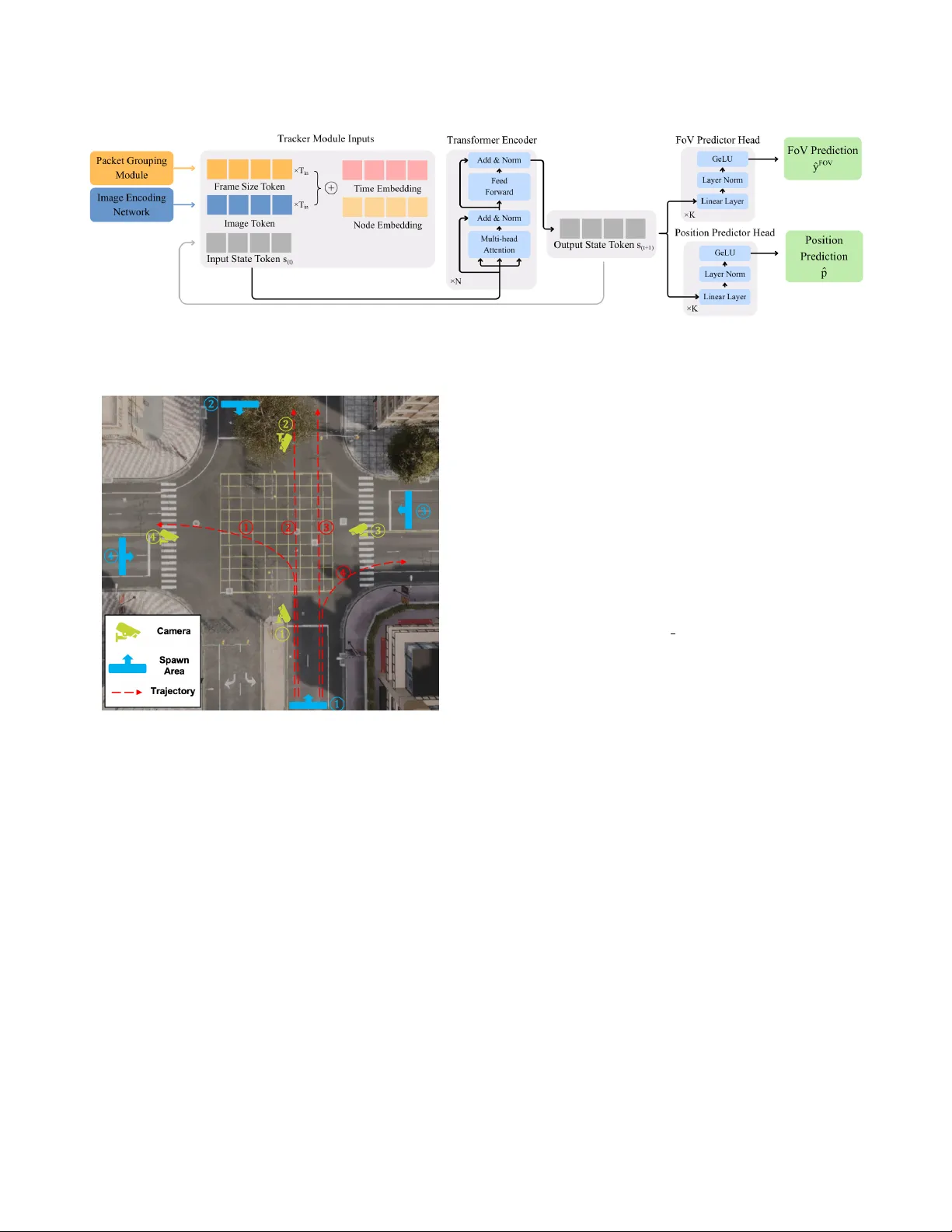

이 논문은 동적 환경 인식을 위해 원본 영상이 아닌 암호화된 네트워크 트래픽만을 이용하는 새로운 프레임워크인 GraySense를 제안한다. 기존 영상 기반 추적은 카메라 스트림에 직접 접근해야 하지만, 실제 운영 환경에서는 프라이버시 정책, 소유권 문제, 암호화 프로토콜 등으로 인해 원본 데이터에 접근하기 어려운 경우가 많다. 저자는 이러한 제약을 ‘Blue 노드’(직접 접근 가능한 카메라)와 ‘Gray 노드’(암호화된 트래픽만 관찰 가능한 카메라)로 구분하고, Gray 노드의 패킷 크기와 전송 타이밍이 장면 변화, 특히 움직이는 물체의 존재와 움직임을 반영한다는 점을 이용한다.

핵심 기술은 두 단계로 구성된다. 첫 번째 단계인 Packet Grouping 모듈은 연속적인 암호화 패킷 스트림에서 프레임 경계를 복원한다. H.264 코덱의 GOP 구조를 전제로, I‑프레임과 P‑프레임 사이의 패킷 크기 차이를 분석해 프레임 시작점을 추정한다. 네트워크 지연, 대역폭 제한, 패킷 손실 등 현실적인 노이즈가 존재해도, 변동량 기반 히스토그램과 시계열 클러스터링을 결합해 높은 정확도로 프레임을 구분한다.

두 번째 단계인 Tracker 모듈은 트랜스포머 인코더에 순환 상태를 추가한 구조를 사용한다. 입력은 다수의 Gray 노드에서 얻은 프레임 크기 시퀀스와, 선택적으로 Blue 노드에서 제공되는 이미지 피처이다. 트랜스포머는 시간적 어텐션을 통해 서로 다른 시점과 서로 다른 시점의 패킷 변동을 통합하고, 순환 상태는 장기적인 움직임 패턴을 기억한다. 손실 함수는 위치 L2 오차와 프레임 경계 추정 오류를 동시에 최소화하도록 설계되었다.

데이터셋 구축을 위해 저자는 CARLA 시뮬레이터와 ns‑3 네트워크 에뮬레이터를 결합했다. 다양한 교통 시나리오, 날씨, 조명 조건을 시뮬레이션하고, 4개의 Gray 카메라와 2개의 Blue 카메라를 배치해 다중 시점에서 동일 객체가 관측되는 상황을 만든다. 각 시뮬레이션은 패킷 크기, 타임스탬프, 그리고 정확한 3D 위치 라벨을 포함한다. 이 데이터는 학습과 평가에 공개될 예정이다.

실험에서는 Gray 노드만 사용했을 때 평균 Euclidean 오류가 2.33 m였으며, 이는 추적 대상 차량의 최소 치수(길이 4.61 m, 높이 1.93 m)보다 작아 실용적인 수준이다. Blue 노드와 결합하면 오류가 1.1 m 이하로 감소한다. 또한, 네트워크 지연이 100 ms, 패킷 손실률이 5 %인 악조건에서도 추적 정확도가 크게 저하되지 않아 모델의 강인성을 확인했다.

논문의 한계로는 현재 단일 객체 추적에만 초점을 맞추었으며, 다중 객체 상황에서는 패킷 크기만으로는 공간적 혼동이 발생할 수 있다. 또한, H.264 외의 코덱이나 다른 스트리밍 프로토콜에서는 패킷 변동 패턴이 달라질 가능성이 있어 추가 연구가 필요하다. 그럼에도 불구하고, 암호화된 트래픽을 활용한 ‘보이지 않는’ 추적이라는 개념은 프라이버시 보호와 네트워크 기반 감시 시스템에 새로운 가능성을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기