학생들의 생성형 AI 인식과 활용: 고등교육에서의 모순과 기대

본 연구는 영국 허트포드 대학교 컴퓨터과학 대학원생 436명을 대상으로 설문조사를 실시해, 학생들의 생성형 AI(GenAI) 친숙도와 실제 사용 빈도 사이의 격차, 인식된 장·단점, 그리고 대학 차원의 지원 요구를 탐색한다. 60% 이상이 도구에 익숙하다고 답했지만 일상적 활용은 제한적이며, 인지적 스캐폴딩(개념 설명·브레인스토밍) 목적이 주를 이룬다. 데이터 프라이버시·신뢰성·비판적 사고 저하에 대한 우려와 AI 리터러시 교육·공정한 접근성 …

저자: Harpreet Singh, Jaspreet Singh, Satwant Singh

본 논문은 생성형 인공지능(GenAI)이 고등교육 현장에 급속히 확산되는 배경에서, 기존 연구가 주로 교직원·기관 차원의 관점을 다루는 반면, 학생들의 실제 인식과 활용 행태는 상대적으로 소홀히 다루어졌다는 점을 지적한다. 이를 보완하고자 영국 허트포드 대학교의 컴퓨터과학 대학원생 436명을 대상으로 설문조사를 실시했으며, 설문은 인구통계, AI 도구 친숙도, 사용 빈도·목적, 기대 효과·우려, 그리고 제도적 지원 요구 등 다섯 영역으로 구성되었다.

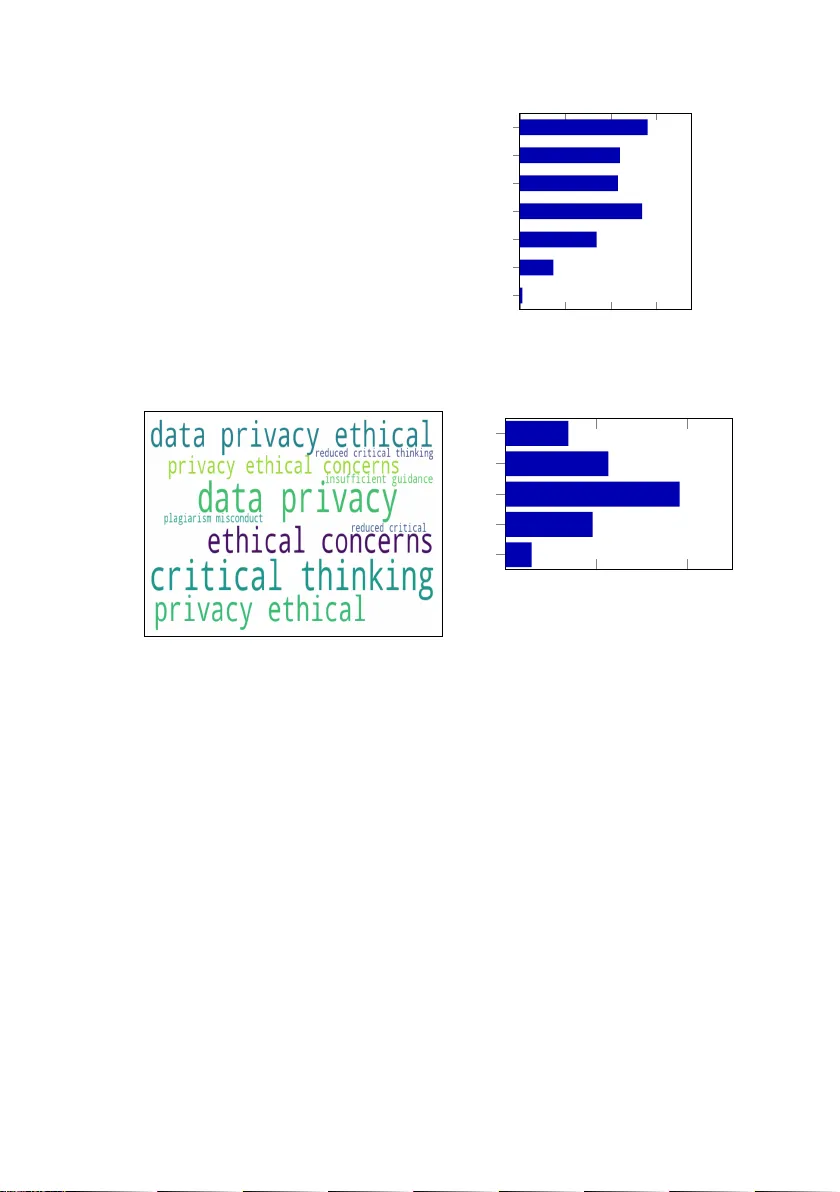

분석 결과, 60% 이상이 ChatGPT, Gemini, Claude 등 주요 GenAI 도구에 ‘높은 친숙도’를 보였지만, 실제 학업에서 일일 사용 비율은 28%에 불과했다. 학생들은 주로 ‘인지적 스캐폴딩’(개념 설명, 아이디어 브레인스토밍, 코드 디버깅 등) 목적으로 AI를 활용했으며, 완전 자동화된 과제 작성이나 시험 답안 생성 등 고위험 활용은 회피하는 경향을 보였다. 이는 ‘Confidence‑Competence Paradox’라 명명된 현상으로, 도구에 대한 자신감과 실제 적용 능력 사이에 괴리가 존재함을 의미한다.

학생들이 제시한 주요 장점은 (1) 학습 효율성 향상, (2) 개인 맞춤형 피드백 제공, (3) 다국어 지원을 통한 접근성 확대 등이었다. 반면 우려 사항은 (1) 데이터 프라이버시와 보안, (2) AI 출력의 정확성·편향성, (3) 비판적 사고와 창의성 저하, (4) 학문적 무결성 위협으로 요약된다. 특히, ‘Algorithmic Paywall’ 현상으로 인해 프리미엄 AI 서비스에 대한 접근이 제한된 학생들은 도구 활용도에서 차이를 보이며, 이는 디지털 격차를 심화시킬 위험이 있다.

응답자들은 대학 차원의 지원을 강력히 요구했으며, 구체적으로는 (1) AI 리터러시 교육을 정규 커리큘럼에 통합, (2) 윤리·법적 가이드라인의 명확화, (3) 전공·학년별 맞춤형 활용 지침 제공, (4) AI 도구에 대한 공정한 접근성 보장을 위한 라이선스 제공 및 비용 보조 등을 꼽았다. 또한, ‘Social Desirability Bias’가 존재함을 확인했는데, 이는 학생들이 AI 활용을 과소 혹은 과대 보고하는 경향이 있어 실제 사용 실태 파악에 한계가 있음을 시사한다.

문헌 검토에서는 기존 연구가 주로 ‘인식 수준’과 ‘사용 의도’를 조사했으나, 실제 사용 행태와 교육적·제도적 연계 방안에 대한 실증적 자료가 부족함을 강조한다. 본 연구는 이러한 공백을 메우며, ‘Utility Gap’, ‘False Peak of Familiarity’, ‘Algorithmic Paywall’ 등 새로운 개념을 도입해 GenAI 도입 과정에서 발생할 수 있는 구조적·인지적 문제들을 체계적으로 제시한다.

결론적으로, 대학은 단순히 AI 사용을 금지하거나 감시하는 ‘policing’ 전략을 넘어, AI 리터러시와 윤리 교육을 중심으로 한 포괄적 프레임워크를 구축해야 한다. 이는 학생들이 AI를 비판적·창의적으로 활용하도록 돕고, 학습 효과를 극대화함과 동시에 학문적 무결성을 유지하는 데 필수적이다. 향후 연구는 다양한 학문 분야와 교육 단계에서의 비교 연구, 그리고 실제 AI 통합 교육 프로그램의 효과 검증을 통해 정책적 구현 방안을 구체화할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기