저랭크 적응이 순차적 트랜스포머 인코더 파인튜닝에서 망각을 크게 감소시킨다

본 논문은 사전학습된 BERT와 RoBERTa 인코더를 순차적으로 파인튜닝할 때, 저랭크 어댑터(LoRA)를 적용하면 전체 파인튜닝 대비 평균 망각률을 19.9%에서 0.6%로 97% 이상 감소시킨다는 실증적 증거를 제시한다. 또한, 백본을 거의 고정한 상태에서 적은 비율의 파라미터만 학습하는 것이 망각 감소의 핵심 메커니즘임을 정밀 실험과 표현 유사도 분석을 통해 입증한다.

저자: Ashish P, ey

본 논문은 사전학습된 트랜스포머 인코더(BERT‑base, RoBERTa‑base)를 순차적인 다중 작업 환경에 적용할 때, 파라미터 효율적 파인튜닝 기법인 Low‑Rank Adaptation(LoRA)이 기존의 전체 파인튜닝(full‑FT) 대비 망각을 현저히 감소시킨다는 점을 체계적으로 검증한다. 연구는 크게 네 부분으로 구성된다.

1. **실험 설계 및 메트릭**

- 작업 순서는 GLUE 데이터셋의 RTE → MRPC → CoLA → SST‑2이며, 각 작업을 순차적으로 학습한 뒤 이전 작업에 대한 정확도 변화를 통해 망각(F) 을 정의한다.

- 평균 망각은 모든 이전 작업에 대한 망각을 평균한 값이며, 양수이면 망각, 음수이면 역전이(전이 학습)로 해석한다.

- 주요 실험은 5개의 시드(45–49)에서 전체 검증(full‑validation) 프로토콜을 적용해 재현성을 확보한다.

2. **핵심 결과: LoRA vs. Full‑FT**

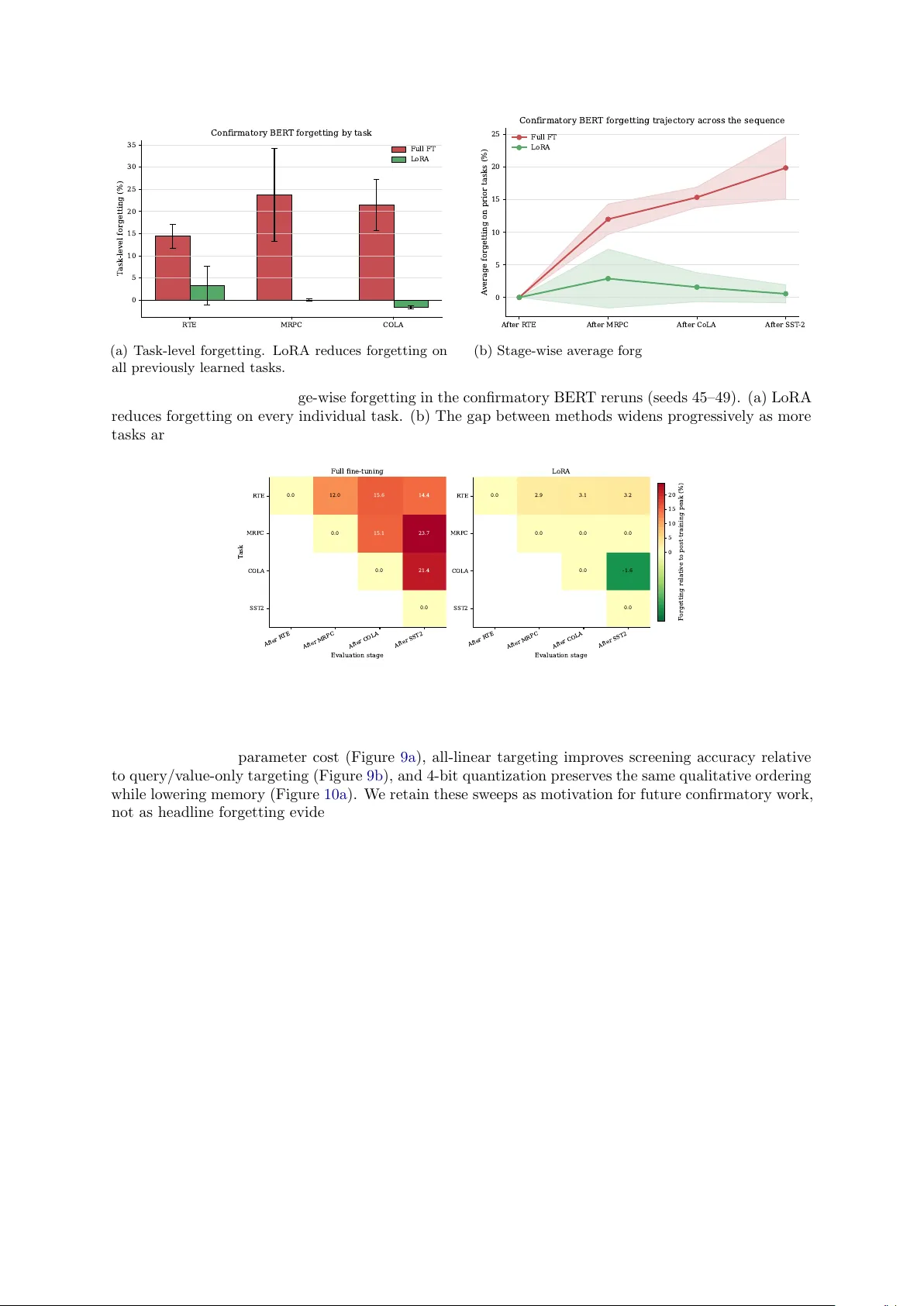

- BERT‑base에 대해 full‑FT는 평균 망각 19.9 % ± 4.8 %를 기록했으며, LoRA(r=8, query/value)에서는 0.6 % ± 1.4 %로 97 % 이상의 상대 감소를 보였다.

- 통계적 검증(p=0.002, Cohen’s d = 3.12)으로 차이가 유의함을 확인했다.

- 작업별로는 MRPC와 CoLA에서 가장 큰 차이가 나타났으며, LoRA는 거의 모든 이전 작업에서 망각을 0에 가깝게 유지했다. 다만 최종 정확도는 full‑FT(64.5 %)가 LoRA(59.5 %)보다 약간 높았다.

3. **보조 실험 및 일반화**

- RoBERTa‑base에서도 동일한 패턴이 재현되었으며, Elastic Weight Consolidation(EWC) 같은 전통적 연속학습 기법보다 LoRA가 더 낮은 망각(15.5 % ± 1.4 %)을 보였다.

- 6‑task 확장 실험에서는 평균 망각이 낮아도 MRPC와 같은 특정 작업에서 높은 변동성이 존재함을 보여, 평균 지표만으로는 충분히 평가할 수 없음을 강조한다.

- 파라미터 프리징 비율을 단계적으로 늘리는 실험에서는 95 % 이상 고정될 때 망각이 급격히 감소하는 ‘프리징 절벽’ 현상이 관찰되었다. 이는 LoRA의 효과가 저랭크 구조 자체보다는 백본 고정에 크게 의존한다는 가설을 뒷받침한다. classifier‑only와 shallow‑adapter 같은 얕은 어댑터도 95 % 이상 고정 시 LoRA와 비슷한 수준의 망각 감소를 보였다.

4. **표현 수준 분석**

- 별도 저장소에서 GPT‑2와 RoBERTa를 이용해 task‑similarity 프로브를 수행했다. 각 작업의 은닉 상태 중심을 추출해 코사인 유사도를 계산한 결과, 백본을 고정한 경우(LoRA 포함)에는 작업 간 유사도가 크게 유지되었으며, 점진적인 언프리징은 유사도를 서서히 감소시켰다.

- 특히 최종 트랜스포머 레이어에서 full‑FT와의 차이가 가장 크게 나타나, 파라미터 자유도가 증가할수록 레이어‑와이즈 표현이 분산되는 경향을 확인했다.

5. **해석 및 의의**

- 저자들은 LoRA가 망각을 감소시키는 주된 원인을 “백본을 거의 고정함으로써 공유된 특징 스캐폴드를 안정적으로 보존한다”는 메커니즘으로 규정한다. 이는 기존 연속학습 기법이 도입하는 복잡한 정규화·리플레이·아키텍처 변경 없이도 상당한 망각 완화를 가능하게 한다는 점에서 실용적이다.

- 또한, LoRA를 “선택적 가소성(selective plasticity)”을 탐구하기 위한 실험적 프로브로 활용함으로써, 파라미터 자유도와 표현 안정성 사이의 관계를 정량적으로 파악할 수 있는 새로운 방법론을 제시한다.

결론적으로, 본 연구는 LoRA가 단순히 파라미터 효율성을 넘어, 백본 고정을 통한 표현 안정성 확보가 순차적 파인튜닝에서 망각을 크게 완화한다는 강력한 실증 증거를 제공한다. 이는 연속 학습 시스템 설계 시 복잡한 방지 메커니즘 대신 LoRA와 같은 PEFT 기법을 기본 베이스라인으로 채택할 근거를 마련한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기