에너지 점수 기반 신경 가우시안 혼합 모델로 예측 불확실성 정량화

본 논문은 입력‑조건부 가우시안 혼합 모델(IGMM)에 에너지 점수(ES)를 결합한 하이브리드 손실을 제안한다. NLL 손실은 파라메트릭 효율성을, ES 손실은 캘리브레이션과 모드 다양성을 제공함으로써 훈련 불안정성과 ‘rich‑get‑richer’ 현상을 완화한다. 이론적으로 엄격히 적절한 스코어임을 증명하고, 일반화 오차 경계를 제시한다. 실험 결과는 합성 및 실제 데이터셋에서 기존 MDN·SampleNet 대비 예측 정확도와 불확실성 정량…

저자: Yang Yang, Chunlin Ji, Haoyang Li

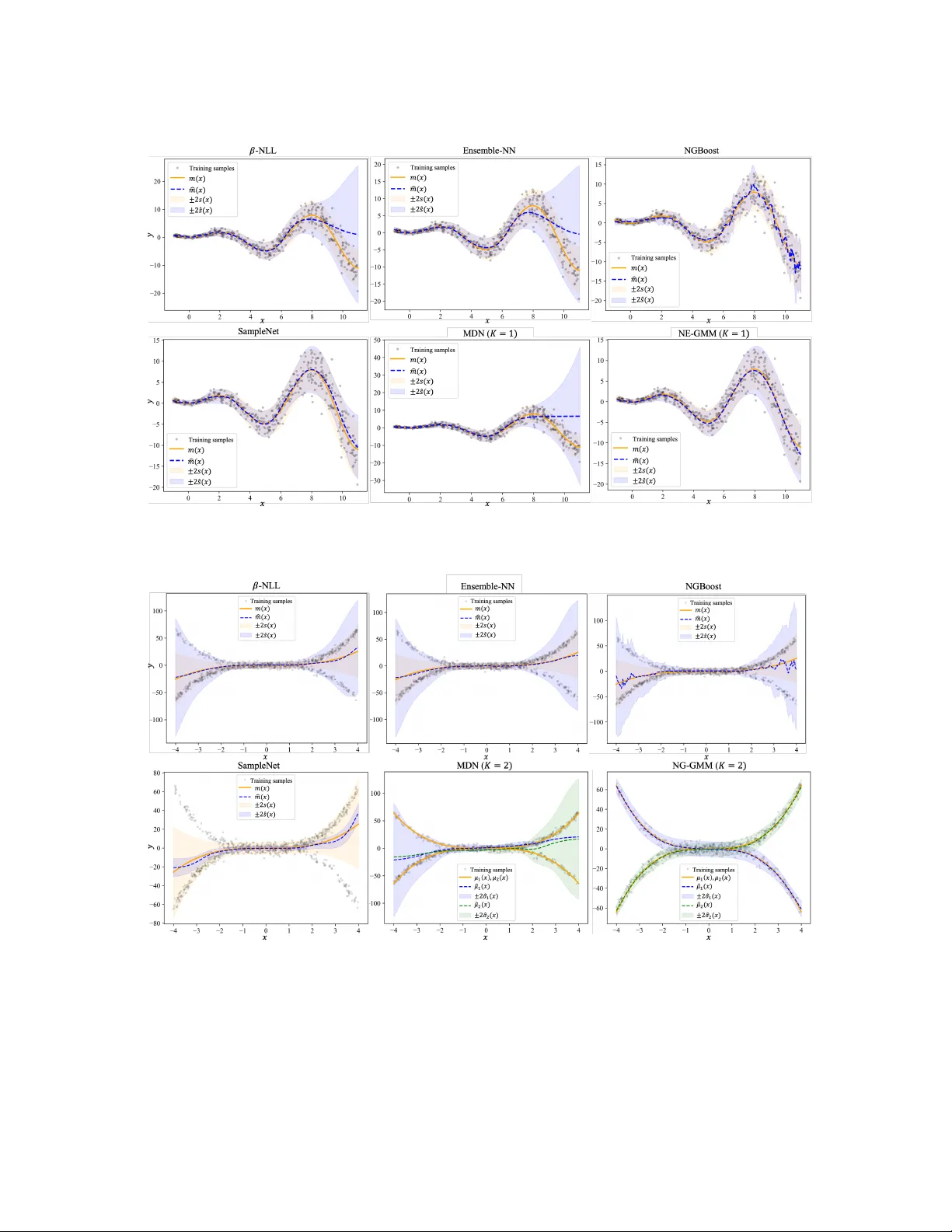

본 논문은 예측 불확실성 정량화가 필수적인 실제 머신러닝 응용에서, 기존 파라메트릭 방법들이 NLL 손실에만 의존함으로써 훈련 불안정성, 모드 붕괴, 그리고 ‘rich‑get‑richer’ 현상 등 여러 문제에 직면한다는 점을 지적한다. 이러한 문제를 해결하기 위해 저자들은 Neural Energy Gaussian Mixture Model(NE‑GMM)이라는 새로운 프레임워크를 제안한다. NE‑GMM은 입력‑조건부 가우시안 혼합 모델(IGMM)을 기반으로 하며, 손실 함수에 NLL과 Energy Score(ES)를 가중 평균한 하이브리드 스코어를 도입한다. NLL은 파라메트릭 형태의 IGMM을 효율적으로 학습하도록 돕고, ES는 샘플 간 거리 기반의 다변량 스코어로 예측 분포의 캘리브레이션과 다양성을 보강한다.

핵심 기술적 기여는 다음과 같다. 첫째, IGMM에 대한 ES의 정확한 닫힌 형태식을 유도하여, 손실 계산 복잡도를 O(K²)로 낮추었다. 이는 기존 SampleNet이 Monte‑Carlo 샘플 M을 사용해 O(M²) 복잡도를 갖는 것에 비해 크게 효율적이다. 둘째, 하이브리드 손실이 ‘strictly proper scoring rule’임을 증명함으로써, 최적화된 모델이 진짜 데이터 분포와 일치하도록 이론적 보장을 제공한다. 셋째, 경험적 위험과 기대 위험 사이의 차이를 제한하는 일반화 오차 경계를 Rademacher 복잡도와 베르누이 불확실성 이론을 이용해 도출하였다. 넷째, 실험적으로 NE‑GMM이 합성 데이터의 다중 모드, 이질적 노이즈, 그리고 실제 데이터셋(UCI 회귀, 베이징 교통량, 기후 예측 등)에서 기존 MDN, β‑NLL, Bayesian Neural Net, SampleNet 대비 예측 정확도(RMSE)와 불확실성 정량화(CRPS, PICP) 모두에서 우수한 성능을 보임을 입증했다. 특히 고분산 영역에서 예측 구간 커버리지가 95% 수준에 가깝게 유지되는 등 캘리브레이션이 크게 향상되었다.

논문은 또한 기존 방법들의 한계를 상세히 분석한다. 단일 가우시안 NLL은 저분산 데이터에 과도하게 집중해 고분산 영역을 무시하고, MDN은 NLL만 사용하면 모드 붕괴와 훈련 진동을 겪는다. 베이지안 방법은 계산 비용이 높고, SampleNet은 ES를 근사하기 위해 대규모 샘플링이 필요해 비효율적이다. NE‑GMM은 이러한 문제를 동시에 해결한다.

제한점으로는 혼합 컴포넌트 수 K의 선택이 모델 복잡도와 성능에 큰 영향을 미치며, 현재는 교차 검증을 통해 경험적으로 결정한다는 점을 들 수 있다. 또한 ES의 미분식이 복잡해 구현 시 수치적 안정성을 확보하기 위한 추가 정규화가 필요할 수 있다. 향후 연구에서는 자동 K 선택 메커니즘, 비정규화된 혼합 모델(예: Student‑t 혼합)과의 결합, 시계열 및 고차원 이미지 데이터에 대한 확장 가능성을 탐색하고, 하이브리드 손실의 가중치 α를 데이터 특성에 따라 동적으로 조정하는 방법을 모색할 예정이다.

결론적으로, NE‑GMM은 파라메트릭 효율성과 비파라메트릭 캘리브레이션을 동시에 만족하는 새로운 불확실성 정량화 프레임워크로, 다양한 실제 응용에서 신뢰할 수 있는 예측과 정밀한 불확실성 추정이 요구되는 상황에 유용하게 적용될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기