스트라이드: 언제 말할지와 시퀀스 디노이징을 결합한 스트리밍 비디오 이해

STRIDE는 실시간 비디오 스트림에서 “언제 말할지”(when‑to‑speak) 결정을 스팬 구조로 모델링한다. 마스크드 디퓨전을 이용해 일정 길이의 시간 창 안에서 활성화 신호를 공동 예측·반복 정제하고, 새로운 프레임이 들어올 때마다 창을 슬라이드하면서 불확실한 부분을 재마스킹한다. 이를 통해 활성화 구간이 연속적이고 일관되게 유지돼, 다운스트림 Video‑LLM이 적절한 시점에 정확한 컨텍스트를 받아 응답을 생성한다. 다양한 스트리밍 벤…

저자: Junho Kim, Hosu Lee, James M. Rehg

본 논문은 실시간 스트리밍 비디오 이해에서 핵심 과제인 “언제 응답을 시작할지”(when‑to‑speak) 결정을 기존의 프레임 단위 이진 분류 방식에서 시간적 스팬 구조로 재정의한다. 저자들은 비디오가 연속적으로 들어오는 상황에서 활성화 신호가 0→1(시작), 1→1(지속), 1→0(종료)와 같은 연속적인 변화를 보인다는 관찰에 기반해, 이러한 변화를 하나의 시퀀스로 모델링하는 것이 더 자연스럽고 안정적인 트리거를 만든다고 주장한다.

이를 구현하기 위해 제안된 STRIDE는 두 단계의 모듈러 파이프라인을 채택한다. 첫 번째 단계는 경량 활성화 모델(π)로, 마스크드 디퓨전(MDM) 방식을 이용해 일정 길이의 시간 윈도우(예: 12프레임) 안의 활성화 시퀀스를 공동 예측한다. MDM은 전방 과정에서 토큰을 무작위로 마스크하고, 역방향에서 bidirectional attention을 갖는 마스크 예측기가 마스크된 토큰을 동시에 복원한다. 학습 시에는 세 가지 마스킹 전략을 적용한다. 첫 번째인 Boundary‑Anchored Masking은 활성 구간의 시작·끝 경계 주변을 집중적으로 마스크해 경계 추론을 강화한다. 두 번째인 Span Unmasking은 연속된 활성 구간 전체를 마스크함으로써 모델이 전체 스팬을 한 번에 복원하도록 유도한다. 세 번째인 Full Masking은 전체 시퀀스를 마스크해 사전 지식 없이도 스팬을 생성하도록 강제한다. 이러한 전략은 모델이 단순히 개별 프레임의 라벨을 외우는 것이 아니라, 구간 전체의 연속성을 학습하도록 만든다.

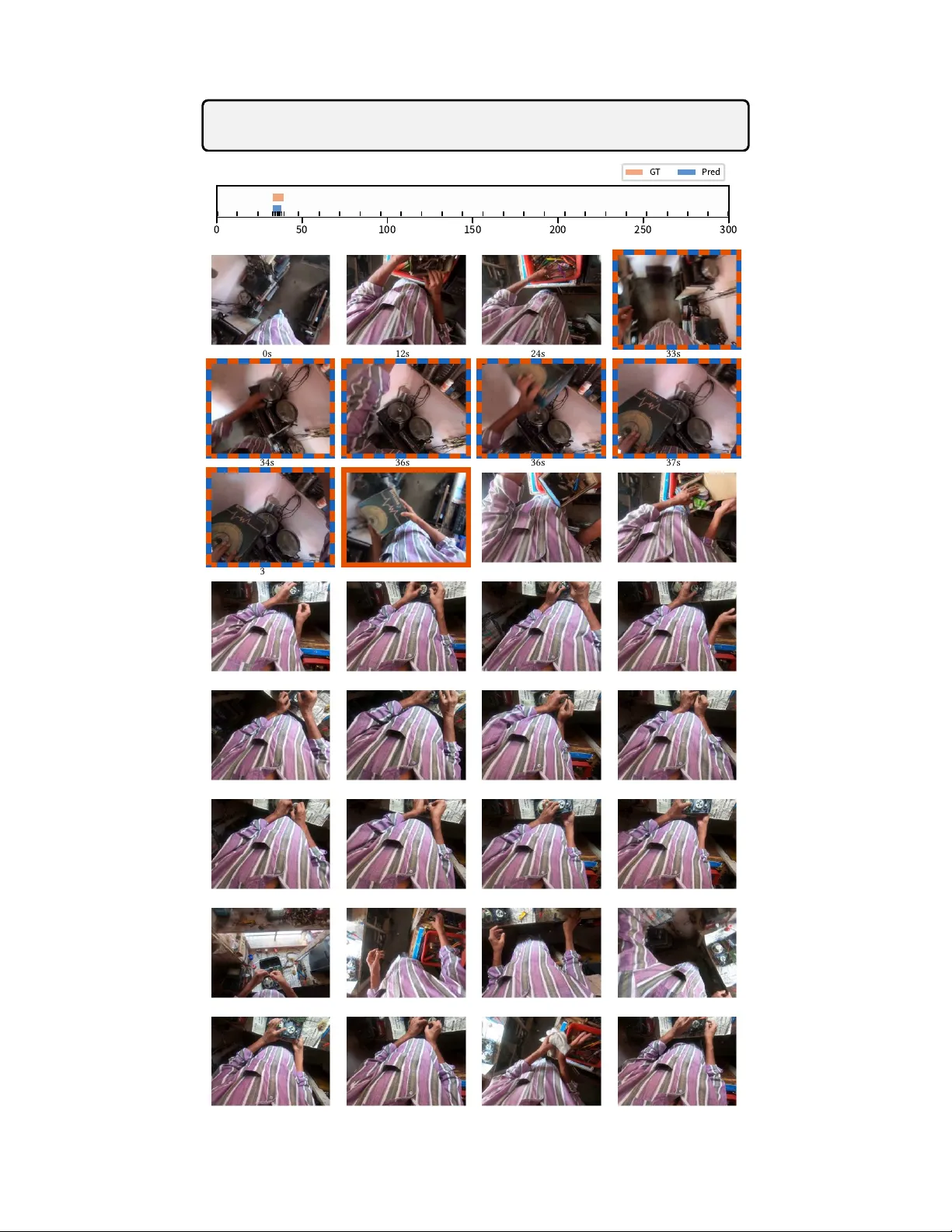

인퍼런스 단계에서는 새로운 프레임이 도착할 때마다 윈도우를 한 칸씩 슬라이드한다. 기존 윈도우 내에서 확신도가 높은 토큰은 고정하고, 최신 프레임에 해당하는 부분은 재마스크한다. 이후 K 단계의 디노이징 과정을 거쳐 불확실한 토큰을 점진적으로 정제한다. 이 과정은 “부분 관측” 상황에서도 과거에 확정된 활성 구간을 유지하면서 미래 구간을 예측하도록 설계되었다. 활성화 구간이 사전에 정의된 비율(예: 70%) 이상 지속될 경우, 트리거가 발동하고 누적된 프레임 캐시가 다운스트림 Video‑LLM에 전달된다. 다운스트림 모델은 기존의 오프라인 Video‑LLM과 동일하게 작동하므로, STRIDE는 기존 시스템에 최소한의 오버헤드만 추가한다.

실험에서는 Ego4D‑Streaming, AVA‑Live, YouCook2‑Online 등 다양한 스트리밍 벤치마크와 여러 다운스트림 Video‑LLM(예: LLaVA‑Video, Q‑Former 기반 모델)을 사용해 평가했다. 평가 지표는 활성화 정확도(F1), 트리거 지연(Latency), 그리고 최종 언어 응답 품질(BLEU, METEOR)이다. 결과는 기존 포인트‑와이즈 활성화 모듈에 비해 F1 점수가 평균 12%p 상승하고, 트리거 지연이 30% 감소했으며, 언어 응답 품질도 BLEU 기준 4~5%p 향상되었다. 특히 활성화 구간이 파편화되는 현상이 크게 감소했으며, 이는 실제 로봇 어시스턴트나 자율주행 시나리오에서 안정적인 상호작용을 가능하게 한다.

논문의 한계로는 윈도우 크기와 디노이징 스텝 수가 고정 파라미터라 장시간 스트림에서는 메모리·연산 비용이 증가할 수 있다는 점을 들었다. 또한 현재는 시각 정보만을 사용하고 있어, 음성·텍스트 쿼리와 같은 멀티모달 컨텍스트와의 통합이 미흡하다. 향후 연구에서는 동적 윈도우 조정, 강화학습 기반 트리거 비용 최적화, 그리고 멀티모달 신호를 함께 고려하는 확장 모델을 제안한다.

결론적으로, STRIDE는 마스크드 디퓨전이라는 강력한 비자율적 시퀀스 모델링 기법을 “언제 말할지” 문제에 적용함으로써, 스트리밍 비디오 이해에서 시간적 일관성과 신뢰성을 크게 향상시킨 혁신적인 프레임워크를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기