시각적 질문응답을 위한 정보갭 기반 두 단계 강화학습 프레임워크

본 논문은 멀티모달 대형 언어 모델(MLLM)이 고해상도 이미지에서 세부 정보를 효과적으로 활용하도록, 전역 이미지를 저해상도로 다운샘플링해 정보갭을 만들고, 이후 소수의 바운딩 박스 주석을 이용한 그라운딩 손실로 크롭 정확도를 높이는 두 단계 강화학습 방식을 제안한다. 실험 결과, 제안 방법은 기존 에이전트 기반 모델이 전역 이미지에 과도히 의존하는 문제를 해소하고, 16,384 및 1,024 토큰 제한 하에서 최고 수준의 VQA 성능을 달성…

저자: Xuanpu Zhao, Zhentao Tan, Dianmo Sheng

본 논문은 멀티모달 대형 언어 모델(MLLM)이 고해상도 이미지에서 세부 정보를 효과적으로 활용하도록 설계된 새로운 두 단계 강화학습 프레임워크를 제안한다. 최근 에이전트 기반 워크플로우가 도입되어 MLLM이 이미지 크롭 도구를 스스로 호출해 관심 영역을 확대하고 질문에 답하는 방식이 연구되었지만, 기존 방법은 전역 이미지에 과도히 의존하고 크롭된 영역의 정보를 실제로 활용하지 못한다는 근본적인 한계가 있었다.

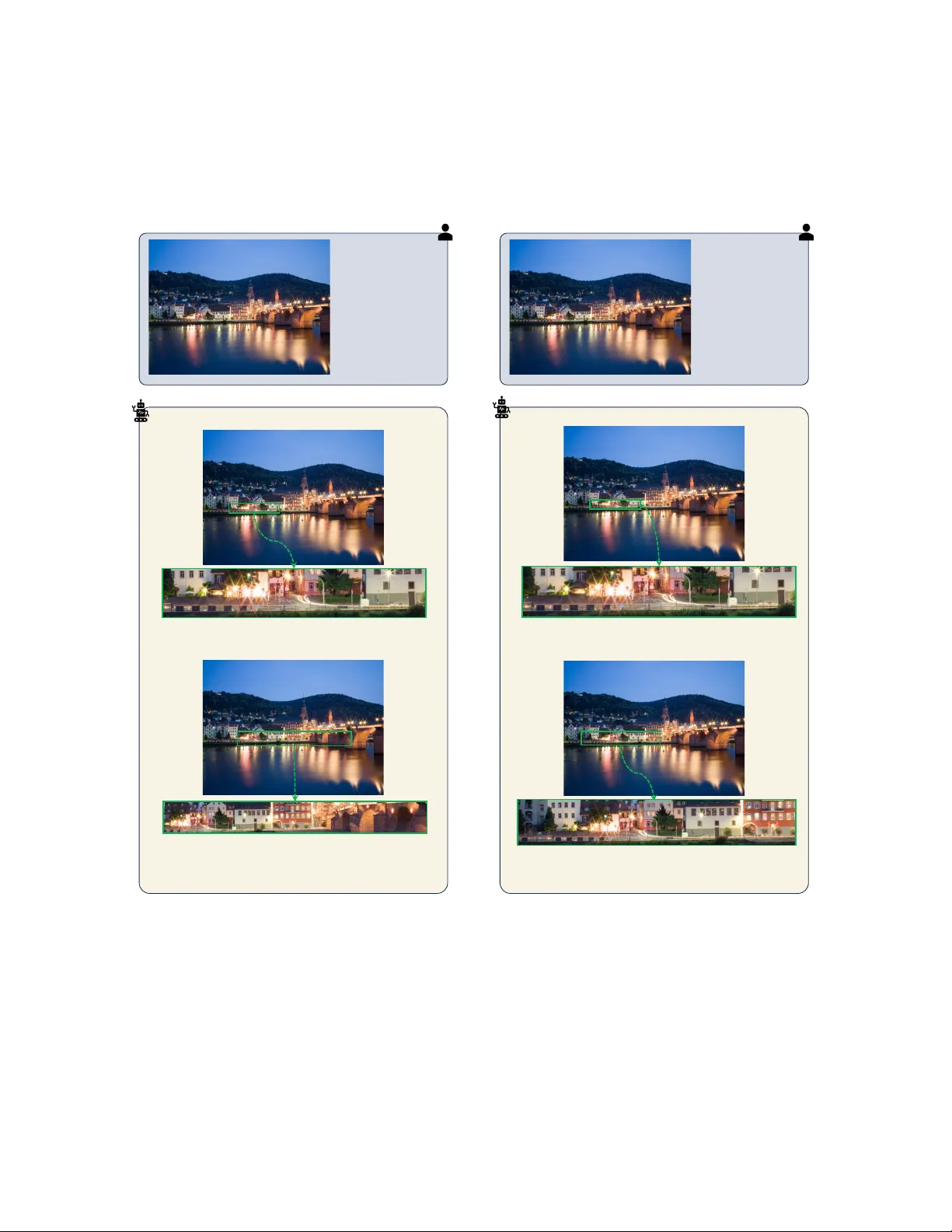

저자들은 DeepEyes와 같은 기존 RL 기반 모델을 분석하여, 모델이 답을 먼저 예측하고 이후에 크롭을 수행해 사후 확인만 하는 ‘answer‑first, crop‑later’ 현상을 발견했다. 이를 검증하기 위해, (1) 모델이 예측한 바운딩 박스를 정답 바운딩 박스로 교체한 ‘완벽한 크롭’, (2) 크롭 영역을 무작위 노이즈로 교체한 ‘무의미한 크롭’ 실험을 수행했으며, 두 경우 모두 성능 변화가 미미함을 확인했다. 이는 모델이 전체 고해상도 이미지만으로 충분히 답을 도출하고, 크롭 정보를 실제로 사용하지 않음을 의미한다.

첫 번째 단계인 ‘Information Gap Mechanism’은 전역 이미지를 모델 자체의 불확실도에 따라 적절히 다운샘플링한다. 낮은 해상도의 전역 이미지와 고해상도에서 추출된 크롭 이미지 사이에 정보 격차를 만들고, 이 격차가 크롭 정보를 필수적으로 만들도록 설계한다. 이렇게 하면 모델은 전역 이미지만으로는 질문에 정확히 답할 수 없으며, 반드시 크롭된 영역을 분석해야 정답을 얻을 수 있다. 이 과정은 트래젝터리(정답 경로) supervision 없이 강화학습 정책 πθ가 “언제, 어디를 크롭할지”를 스스로 학습하도록 만든다.

두 번째 단계에서는 소수의 바운딩 박스 주석을 활용해 ‘grounding reward’를 도입한다. IoU(Intersection over Union) 기반 보상과 크롭 좌표와 정답 좌표 사이의 거리 기반 보상을 결합해, 모델이 크롭 영역을 정확히 맞추도록 유도한다. 이는 단순히 크롭을 호출하는 수준을 넘어, 실제 의미 있는 영역을 정밀하게 포착하도록 학습시킨다.

또한, 각 이미지에 최적의 다운샘플링 비율을 자동으로 결정하는 ‘Offline Resolution Selection’ 절차를 도입했다. 이는 전역 이미지가 너무 풍부해 모델이 전역 정보를 그대로 사용하거나, 반대로 정보가 부족해 영역을 찾지 못하는 상황을 방지한다.

실험은 HR‑Bench‑8k, HR‑Bench‑4k, V* 등 고해상도 시각 질문응답(VQA) 벤치마크에서 수행되었다. 제안 방법은 기존 SFT+RL 하이브리드 모델과 순수 RL 모델을 크게 앞서며, 특히 시각 토큰 예산을 16,384와 1,024로 제한했을 때 모두 최고 수준의 성능을 기록했다. 1,024 토큰 제한에서도 16,384 토큰을 허용하는 경쟁 모델보다 우수한 결과를 보이며, 정보갭 메커니즘이 고해상도 세부 정보를 효율적으로 활용함을 입증한다.

결론적으로, 이 연구는 (1) 기존 에이전트 기반 MLLM이 전역 이미지에 과도히 의존하는 문제를 정량적으로 규명하고, (2) 트래젝터리 라벨링 없이도 모델이 ‘진정한’ 도구 활용 능력을 학습하도록 설계된 두 단계 강화학습 프레임워크를 제시하며, (3) 소량의 지도 데이터만으로도 크롭 정확도를 크게 향상시킬 수 있음을 보여준다. 이러한 접근은 앞으로 멀티모달 모델이 고해상도 이미지에서 세밀한 디테일을 효율적으로 추출·이용하는 데 중요한 설계 원칙을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기