AI 기반 인물 검색 플랫폼 평가를 위한 다차원 벤치마크 PeopleSearchBench

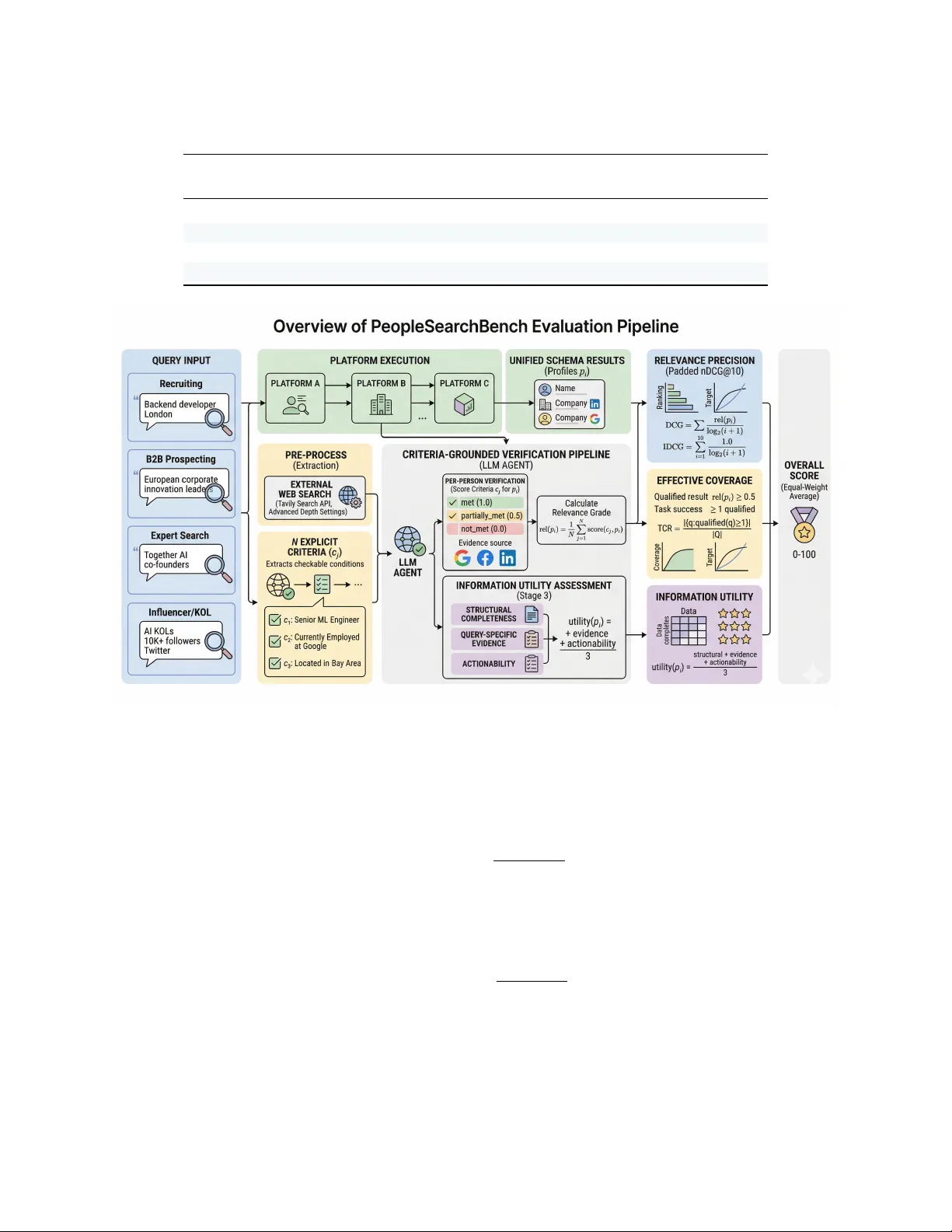

PeopleSearchBench는 119개의 실제 업무 쿼리를 네 가지 시나리오(채용, B2B 영업, 전문가 검색, 인플루언서 탐색)로 구성하고, 기준 기반 검증 파이프라인을 통해 반환된 인물의 속성을 실시간 웹 검색으로 사실 확인한다. 평가 항목은 정밀도(padded nDCG@10), 유효 커버리지(작업 성공률·자격 결과 수), 정보 유용성(프로필 완전성·증거·실행 가능성)이며, 세 항목을 동등 가중 평균해 전체 점수를 산출한다. 네 플랫폼을…

저자: Wei Wang, Tianyu Shi, Shuai Zhang

PeopleSearchBench 논문은 AI 기반 인물 검색 플랫폼의 성능을 체계적으로 비교·평가하기 위한 다차원 벤치마크를 제안한다. 현재 채용, 영업, 전문가 탐색, 인플루언서 발굴 등 다양한 비즈니스 시나리오에서 인물 검색은 핵심 업무이지만, 기존 정보 검색(IR)이나 질문‑응답(QA) 벤치마크는 텍스트 문서·패시지 수준의 정답을 전제로 하며, 인물이라는 복합 엔터티와 다중 속성(역할, 스킬, 위치, 소속 등)을 동시에 검증하기에 한계가 있다. 또한 최근 LLM‑as‑judge 방식은 모델 내부 지식에 의존해 주관적 점수를 매기며, 최신 인물 정보가 외부에서 빠르게 변하는 상황에 적합하지 않다.

이를 해결하고자 저자들은 네 가지 주요 기여를 제시한다. 첫째, 119개의 실제 업무 쿼리를 네 개의 시나리오(채용 30, B2B 32, 전문가 28, 인플루언서 29)와 네 개의 언어(영어, 포르투갈어, 스페인어, 네덜란드어)로 구성한 다국어·다시나리오 데이터셋을 공개한다. 각 쿼리는 역할·스킬·위치·언어·팔로워 수 등 구체적 제약을 포함하며, 일부는 정답이 명확히 정의된 ‘전문가/결정적’ 유형이다.

둘째, ‘Criteria‑Grounded Verification’ 파이프라인을 설계한다. 이 파이프라인은 (1) LLM을 이용해 쿼리에서 N개의 검증 가능한 기준(c₁…c_N)을 자동 추출하고, (2) 반환된 인물 각각에 대해 실시간 웹 검색(Tavily Search API)으로 외부 증거를 수집한다. 각 기준에 대해 ‘충족(1.0)’, ‘부분 충족(0.5)’, ‘불충족(0.0)’ 점수를 부여하고, 평균을 구해 인물별 relevance score를 산출한다. 이렇게 하면 최신 정보와 외부 출처에 기반한 사실 검증이 가능해져, 기존 LLM‑as‑judge가 갖는 최신성·편향 문제를 크게 완화한다.

셋째, 평가 지표를 세 축으로 정의한다.

1) **Relevance Precision**: padded nDCG@10을 사용해 상위 10개 결과의 relevance score를 로그‑감쇠 가중 평균한다. ‘패딩’은 이상적인 10개 완전 적합 결과를 가정해, 결과 수가 적은 시스템이 과대 평가되는 것을 방지한다.

2) **Effective Coverage**: 작업 성공률(TCR)과 쿼리당 최소 K(=10)개의 qualified result 비율을 곱해, 단순 정확도뿐 아니라 실제 활용 가능한 후보 수를 반영한다. 여기서 qualified result는 relevance ≥ 0.5(절반 이상 기준 충족)인 인물이다.

3) **Information Utility**: 프로필 구조(이름·직함·소속·연락처·경력·학력), 쿼리‑특정 증거 제시, 실행 가능성(연락·단계 지정) 세 하위 점수를 0‑1 범위로 평가해 평균한다.

세 지표를 0‑100 스케일로 정규화한 뒤 동등 가중 평균해 **Overall Score**를 산출한다. 이는 다목적 사용자가 중요하게 여기는 요소를 균형 있게 반영한다는 설계 의도다.

넷째, 네 개의 실제 시스템을 동일 조건에서 평가한다.

- **Lessie**: 전문 AI 인물 검색 에이전트, 웹·소셜·학술·공공 데이터베이스 복합 활용.

- **Exa**: 구조화된 엔터프라이즈 검색 API, 자체 데이터베이스 기반.

- **Juicebox (PeopleGPT)**: 800 M+ 프로필을 보유한 AI 리크루팅 플랫폼, 60여 데이터 소스 통합.

- **Claude Code**: Anthropic의 범용 AI 코딩 에이전트, 웹 검색 기반 텍스트 보고서 생성.

각 플랫폼은 쿼리당 최대 15개 결과를 반환하도록 제한했으며, 검증 파이프라인은 동일 LLM(Gemini 3 Flash)과 동일 웹 검색 설정을 사용했다. 평가 기간은 2025년 1월 15‑22일이며, 모든 실행 로그와 타임스탬프를 기록해 재현성을 확보했다.

**실험 결과**는 다음과 같다. Lessie는 Relevance Precision = 71.4, Effective Coverage = 68.9, Information Utility = 64.3을 기록해 총점 65.2점으로 가장 높은 성능을 보였다. 특히 119개 쿼리 전부에서 최소 하나 이상의 qualified result를 반환해 100% 작업 성공률을 달성했으며, 이는 다른 시스템이 92 %~96 % 수준에 머무른 것과 큰 차이를 만든다. Exa와 Juicebox는 구조화된 데이터 접근성에서 강점을 보였지만, 최신 정보 검증과 프로필 완전성에서 떨어졌다. Claude Code는 결과 수가 가변적이며, 텍스트 기반 보고서 형식이라 프로필 구조가 부족해 Information Utility 점수가 낮았다.

통계적 검증으로 부트스트랩 기반 95 % 신뢰구간을 제시하고, paired sign test을 통해 Lessie와 2위 시스템 간 차이가 유의함을 확인했다. 인간 라벨링(200개 인물‑쿼리 쌍)과 비교했을 때 Cohen’s κ = 0.84로 높은 일치도를 보였으며, 자동 검증 파이프라인의 신뢰성을 입증한다. 추가적인 ablation 연구에서는 (a) qualified threshold를 0.5→0.7으로 올리면 전체 점수가 약 4점 감소, (b) 차원 가중치를 비균등하게 조정해 특정 시나리오에서 점수가 상승하지만 전체 평균은 크게 변동하지 않음, (c) top‑K를 5→20으로 확대하면 커버리지는 증가하지만 정밀도는 감소하는 trade‑off를 확인했다.

**의의와 향후 과제**는 다음과 같다. PeopleSearchBench는 (1) 사실 기반의 객관적 평가 프레임워크, (2) 다차원 성능 측정, (3) 오픈소스 데이터와 코드 제공을 통해 연구자·산업계가 시스템을 비교·개선할 수 있는 기준점을 제공한다. 현재는 119개의 쿼리와 네 개의 플랫폼에 한정돼 있으나, 향후 더 많은 도메인·언어·쿼리 유형을 추가하고, 클러스터링·중복 제거 기법을 도입해 정보 유용성 평가를 정교화할 수 있다. 또한, 실시간 비용·지연 분석 결과를 바탕으로 비용 효율성을 함께 고려한 종합 평가 모델을 개발하는 것이 필요하다.

전반적으로 이 논문은 AI 기반 인물 검색이라는 특수한 정보 검색 문제에 대해 실증적·통계적으로 견고한 벤치마크를 제시함으로써, 향후 연구와 실제 서비스 개발에 중요한 토대를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기