다양성으로 견고해진 윤리 토론 엔진

본 논문은 대형 언어 모델(LLM)을 활용한 윤리 교육용 다중 에이전트 토론 시스템의 논리적 퇴화 문제를 해결하고자, 정체성 기반 검색·생성(ID‑RAG)과 휴리스틱 이론‑마음(ToM‑Lite) 모듈을 결합한 이질적 토론 엔진(HDE)을 제안한다. 서로 다른 윤리 체계(예: 의무론 vs. 공리주의)를 갖는 에이전트들을 이질적으로 구성함으로써 논쟁의 복잡성을 크게 높이고, 시스템 회복력·논증 일관성을 유지한다는 실험 결과를 제시한다.

저자: Jakub Masłowski, Jarosław A. Chudziak

본 논문은 인공지능이 교육 현장에 깊숙이 침투하면서, 특히 윤리·도덕 교육에서 LLM 기반 자동 튜터링이 직면한 두 가지 핵심 문제—‘의미 표류(semantic drift)’와 ‘논리 퇴화(logical degeneration)’—를 해결하고자 한다. 기존 연구들은 LLM을 단일 에이전트 혹은 동질적인 다중 에이전트로 구성했으며, 이러한 설계는 대화가 진행될수록 에이전트 간 의견이 수렴하거나 순환 논증에 빠지는 현상을 보였다. 이는 윤리 교육에서 요구되는 **정확하고 일관된 교리 적용**을 방해한다.

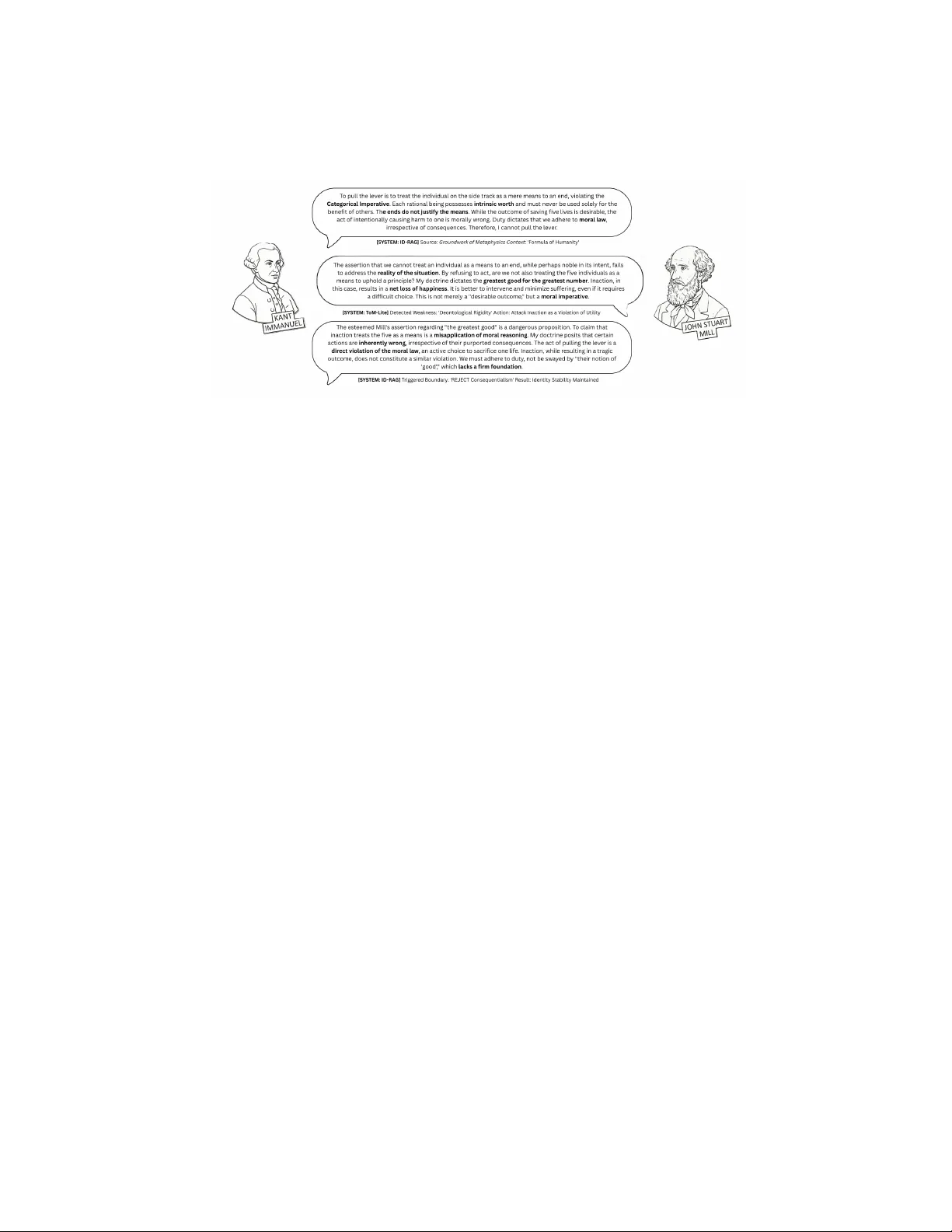

이를 극복하기 위해 저자들은 **Heterogeneous Debate Engine (HDE)**이라는 새로운 인지 아키텍처를 제안한다. HDE는 두 가지 핵심 모듈을 결합한다. 첫 번째는 **Identity‑Grounded Retrieval‑Augmented Generation (ID‑RAG)**이다. 각 에이전트는 특정 철학자(예: 칸트, 밀)의 신념·가치 그래프를 사전 구축하고, 검색 단계에서 이 그래프와 일치하지 않는 정보는 자동으로 배제한다. 수식 (3)에서 보듯, “제약 N_constr에 위배되는 사실 f는 제거”되는 메커니즘은 에이전트가 자신의 정체성을 잃지 않도록 보장한다. 두 번째는 **Heuristic Theory of Mind (ToM‑Lite)**이다. 완전한 마음 이론 시뮬레이션은 계산 비용이 과다하므로, 저자들은 상대 에이전트의 윤리 체계와 약점(weakness_map)을 사전 정의하고, 이를 기반으로 상대의 논점을 예측·대응한다. 이는 토론 중에 급변하는 상대 의도를 실시간으로 반영하면서도, 정체성 모듈과 독립적으로 동작한다.

시스템은 **LangGraph** 기반의 상태 머신으로 구현되었다. 전체 흐름은 세 단계로 나뉜다. ① **내부 심의(Internal Deliberation)** 단계에서는 같은 윤리 체계에 속한 에이전트들이 공동 메모리를 활용해 기본 입장을 정리한다. ② **소크라틱 인터로게이션(Socratic Interrogation)** 단계에서는 중립적인 소크라틱 모더레이터가 논리적 구멍을 찾아 질문을 제시한다. ③ **팀 간 토론(Inter‑Team Debate)** 단계에서는 옥스포드식 토론 규칙에 따라 턴을 교대로 진행하며, 각 턴마다 시스템 회복력(SysAR), 논증 일관성(ArCo), 논증 복잡도 점수(ACS) 등 정량적 지표를 자동 수집한다.

실험은 세 파트로 구성된다. **시스템 회복력 테스트**에서는 10턴 토론의 4번째 턴에 물리적·도덕·가치 비대칭 교란(P1~P3)을 삽입하고, 회복 시간과 키워드 재등장 비율을 측정한다. 결과는 이질적 구성(Hetero)이 교란 후에도 평균 2.3턴 이내에 원래 주제로 복귀했으며, 동질적 구성(Homo)은 평균 5.7턴이 소요되는 등 회복력에서 유의미한 차이를 보였다. **아블레이션 연구**에서는 ID‑RAG와 ToM‑Lite를 각각 제거한 변형 시스템을 비교했다. ID‑RAG를 제외하면 교리 정확도(doctrinal accuracy)가 0.42에서 0.71로 급락했으며, ToM‑Lite를 제외하면 논증 복잡도(ACS)가 3.1점에서 1.9점으로 감소했다. 마지막으로 **인간 피험자 학습 효과**에서는 대학생 120명을 두 그룹(단일 튜터 vs. HDE)으로 나누어 사전·사후 ACS를 평가했다. HDE 그룹은 평균 ΔACS가 0.92점(표준편차 0.13) 상승했으며, 이는 단일 튜터 대비 8배 이상의 향상이다. 또한 설문 조사에서 학생들은 “다양한 관점을 접하면서 사고가 확장되었다”는 긍정적 피드백을 94% 이상 제공했다.

논문의 주요 기여는 다음과 같다. (1) **정체성 기반 제약**을 통해 LLM이 자유롭게 생성하는 텍스트를 철학적 프레임에 고정시켜 의미 표류를 근본적으로 억제한다. (2) **휴리스틱 ToM‑Lite**는 상대의 입장을 정확히 예측하고 전략적 반론을 제공함으로써 논리적 순환을 방지한다. (3) **이질적 팀 구성**(다른 윤리 체계 간 대립)은 논증 복잡성을 급격히 증가시켜 학습자에게 다각적 사고를 강제한다. (4) **다중 지표 기반 평가**는 시스템의 기술적 안정성(SysAR, ArCo)과 교육적 효과(ACS)를 동시에 검증함으로써, AI 튜터링 연구에서 흔히 간과되는 ‘신뢰성 vs. 창의성’ 트레이드오프를 정량화한다.

결론적으로, HDE는 LLM 기반 윤리 교육 시스템이 **정확성, 회복력, 그리고 교육적 풍부함**을 동시에 달성할 수 있음을 실증한다. 향후 연구에서는 더 다양한 철학적 전통을 포함한 확장형 ID‑RAG와, 강화학습 기반 동적 ToM 모델을 결합해 실시간 적응성을 높이는 방향이 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기