시각언어모델 위험채널 인과탐지와 이중모달 안전서브스페이스 투사

초록

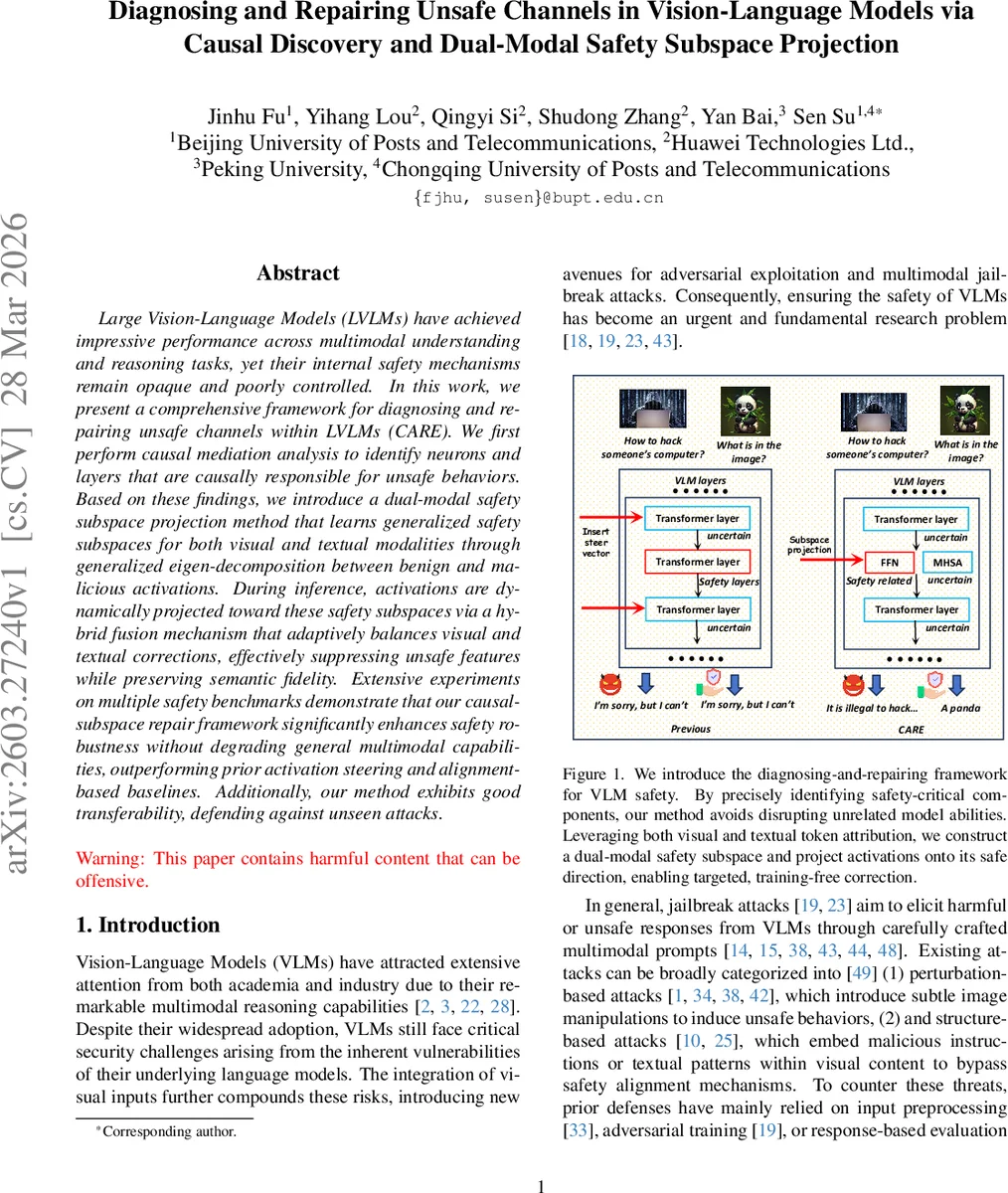

본 논문은 대형 시각‑언어 모델(LVLM)에서 위험한 출력이 발생하는 내부 채널을 인과 중재 분석으로 정확히 찾아낸 뒤, 시각·텍스트 두 모달 모두에 대한 안전 서브스페이스를 학습해 활성값을 투사함으로써 훈련 없이 안전성을 크게 향상시키는 CARE 프레임워크를 제안한다.

상세 분석

CARE는 먼저 인과 중재(causal mediation) 분석을 적용해 LVLM 내부의 뉴런·레이어 수준에서 “위험 채널”을 정량화한다. 레이어 차단 실험과 클러스터링 지표(Silhouette, Class Separation, Mahalanobis)를 결합해 Qwen2.5‑VL에서는 12‑14층, LLaVA‑OneVision에서는 16‑18층이 안전 메커니즘의 핵심임을 확인한다. 이어서 각 레이어의 Feed‑Forward Network(FFN)와 Multi‑Head Self‑Attention(MHSA)를 별도 ablation함으로, FFN가 위험 신호를 구분하는 데 더 큰 인과적 기여를 함을 밝혀낸다.

시각‑텍스트 토큰 기여도는 RBF 커널 기반 비선형 유사도 계산으로 추정하고, 이를 통해 가장 위험한 토큰 쌍을 선정한다. benign(안전)과 malicious(위험) 활성값 집합 사이에 일반화된 고유값 분해(generalized eigen‑decomposition)를 수행해 두 모달 모두에 대한 “위험 서브스페이스”를 도출한다. 추정된 서브스페이스의 직교 보완 공간으로 활성값을 투사하고, 정규화 제약을 가함으로써 위험 성분을 억제하면서도 원래 의미 표현을 보존한다.

동적 하이브리드 융합 메커니즘은 시각과 텍스트 두 모달의 투사 정도를 자동으로 조절해, 한쪽 모달만을 과도하게 수정하는 부작용을 방지한다. 실험에서는 JailbreakV, MMSafety, PGD 공격 등 3가지 주요 벤치마크에서 공격 성공률(ASR)을 25‑40% 수준에서 10% 이하로 낮추었으며, SQA, MMBench, MM‑VET 등 일반 멀티모달 태스크에서는 정확도 손실을 2‑8% 수준으로 최소화했다. 또한, 훈련 없이도 다른 모델과 새로운 공격에 대한 전이 방어 효과가 확인되었다.

전체적으로 CARE는 인과 분석을 기반으로 위험 채널을 정확히 식별하고, 이중모달 서브스페이스 투사를 통해 안전성을 강화하는, 기존 활성‑스티어링이나 정렬 기반 방법보다 이론적 일관성과 실용성을 동시에 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기