3D 생성 세계로 로봇 VLA의 시뮬레이션 실세계 강화학습 확장

본 논문은 대규모 비전‑언어‑액션(VLA) 모델을 시뮬레이션에서 강화학습(RL)으로 미세조정하고, 생성형 3D 세계와 언어 기반 씬 디자이너를 활용해 수백 개의 다양한 인터랙티브 씬을 자동 생성한다. 이를 통해 시뮬레이션 성공률을 9.7%에서 79.8%로, 실제 로봇 성공률을 21.7%에서 75%로 크게 향상시켰으며, 씬 다양성이 제로샷 일반화에 미치는 긍정적 영향을 실증하였다.

저자: Andrew Choi, Xinjie Wang, Zhizhong Su

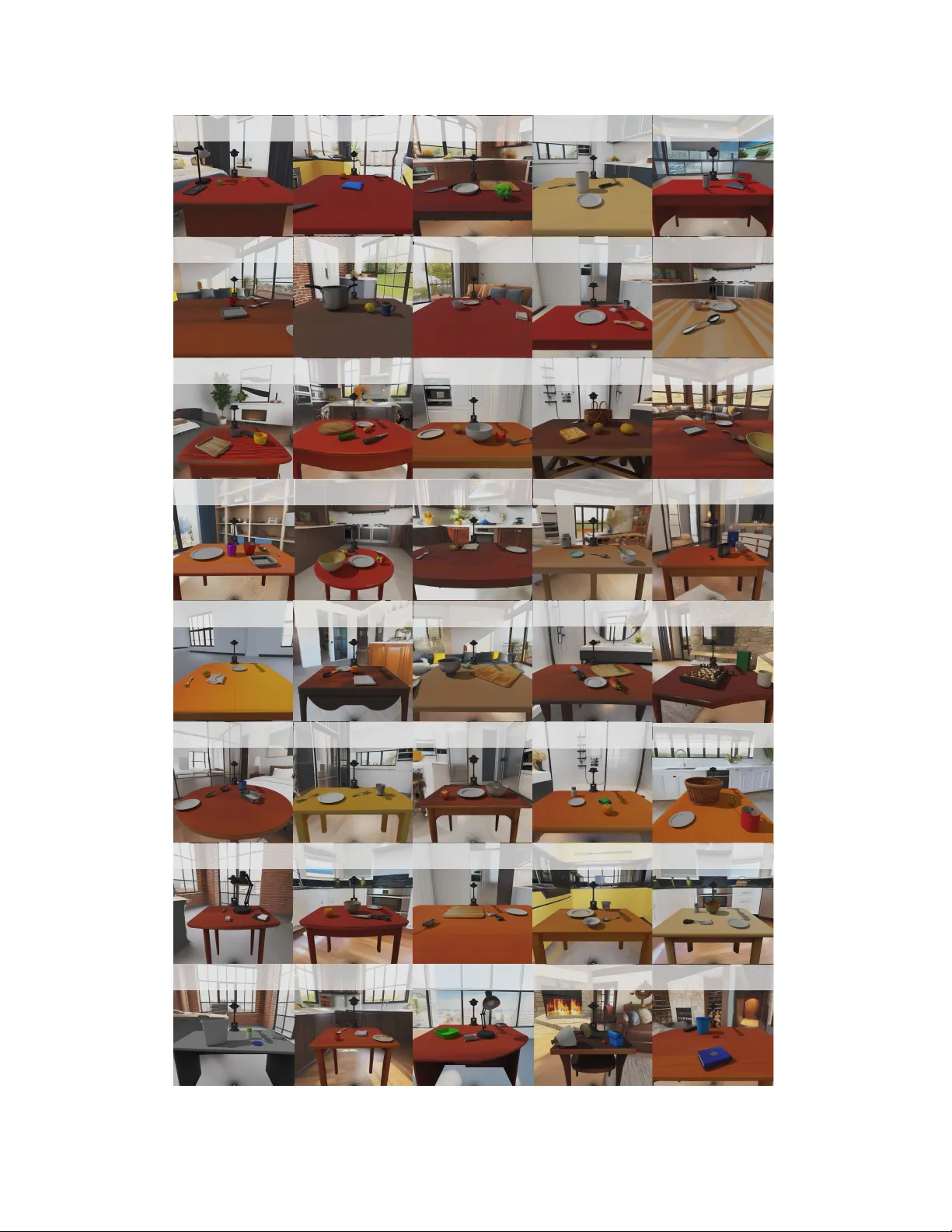

본 논문은 대규모 비전‑언어‑액션(VLA) 모델을 로봇 조작에 적용하기 위해, 시뮬레이션 기반 강화학습(RL)과 최신 3D 생성 모델을 결합한 새로운 파이프라인을 제안한다. 기존 연구들은 VLA를 실제 로봇에서 직접 RL로 미세조정하거나, 제한된 수의 수작업 설계 씬에서 학습함으로써 시뮬‑실제 격차를 회피했지만, 이는 씬 다양성 부족으로 모델이 특정 환경에 과적합되는 문제를 야기한다. 저자들은 이러한 문제를 해결하기 위해 두 가지 핵심 기술을 도입한다. 첫 번째는 언어‑구동 씬 디자이너이다. GPT‑4o를 활용해 작업 명령을 “배경‑목표‑방해‑로봇” 등 의미역으로 분해하고, 각 객체와 공간 관계를 구조화된 씬 그래프로 표현한다. 이 그래프는 EmbodiedGen이라는 텍스트‑투‑3D 생성 엔진에 입력되어, 물리적으로 상호작용 가능한 3D 환경을 자동으로 구성한다. 자동 품질 검증 루프는 물리적 불가능한 배치나 시뮬레이션 오류를 사전에 걸러내어 대규모 병렬 생성이 안정적으로 이루어지도록 한다. 두 번째는 RL 미세조정 알고리즘인 PPOFlow이다. 기존 흐름 매칭 기반 정책은 결정적이어서 PPO와 같은 정책 그라디언트 방법을 적용하기 어려웠다. PPOFlow는 흐름 매칭 과정에 학습 가능한 노이즈를 삽입해 연속적인 가우시안 정책으로 변환하고, 로그 확률을 이용해 중요도 비율을 계산한다. 이를 통해 PPO의 클리핑 손실과 GAE 기반 어드밴티지를 그대로 활용하면서도, 흐름 매칭 모델의 높은 표현력을 유지한다. 실험에서는 사전 학습된 imitation 정책(π₀)을 초기화로 사용하고, 100개의 자동 생성 씬에서 RL을 수행했다. 시뮬레이션 성공률은 9.7%에서 79.8%로, 작업 완료 시간은 1.25배 가속되었다. 씬 다양성에 대한 정량적 분석에서는, 학습 씬 수를 1에서 50으로 늘릴 때 제로샷 OOD 성공률이 24.7%p 상승함을 확인했다. 이는 생성형 3D 데이터가 로봇 정책의 일반화에 직접적인 이점을 제공한다는 증거이다. 실제 로봇 실험에서는 고품질 디지털 트윈과 도메인 랜덤화, 중력 보상 PD 제어를 결합해 시뮬‑실제 전이 성공률을 21.7%에서 75%로 끌어올렸으며, 작업 속도도 1.13배 향상시켰다. 전체 파이프라인은 대규모 병렬 시뮬레이션(ManiSkill 3)과 자동 씬 생성, PPOFlow 기반 RL을 통합함으로써, 로봇 VLA 모델을 비용 효율적으로 스케일링하고, 실제 환경에서도 강인하게 동작하도록 만든다. 이 연구는 생성형 3D 세계가 로봇 학습 데이터의 병목을 해소하고, 대규모 foundation 모델을 로봇 조작에 효과적으로 적용할 수 있는 길을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기