AI 금지 너머: 오픈소스 커뮤니티의 생성형 AI 거버넌스 첫 조망

생성형 AI가 오픈소스 개발에 광범위하게 활용되면서 생성 비용은 낮아졌지만, 검토 및 유지보수 부담은 커져 프로젝트 운영에 위기가 도래했습니다. 본 연구는 67개 주요 오픈소스 프로젝트의 정책 문서를 분석하여 AI가 제기하는 7가지 핵심 문제점을 식별하고, 이에 대응하는 '금지주의', '경계와 책임', '품질 우선'이라는 3가지 거버넌스 방향성과 12가지 구체적 전략을 도출했습니다. AI 거버넌스는 단순한 허용/금지 문제를 넘어 책임성, 검증,…

저자: Wenhao Yang, Runzhi He, Minghui Zhou

본 논문 "Beyond Banning AI: A First Look at GenAI Governance in Open Source Software Communities"은 생성형 AI의 확산으로 인한 오픈소스 소프트웨어 커뮤니티의 거버넌스 변화를 실증적으로 분석한 연구입니다. 연구진은 GitHub 스타 순위 상위 800개 프로젝트를 스크리닝하고 스노우볼 샘플링을 통해 최종적으로 67개 고가시성 오픈소스 프로젝트에서 공개된 거버넌스 자료(CONTRIBUTING, SECURITY, 이슈/PR 템플릿, AGENTS.md 파일 등)와 관련 정당화 자료(공지사항, 논의 스레드)를 수집했습니다. 이를 다단계 정성적 코딩과 비교 분석을 통해 체계적으로 연구했습니다.

연구는 먼저 생성형 AI가 오픈소스 기여 워크플로우 전반에 걸쳐 제기하는 7가지 주요 문제점(RQ1)을 규명했습니다. 이는 △대량의 저품질 코드 기여로 인한 리뷰 부담 가중, △AI 생성 커뮤니케이션(이슈, 댓글)으로 인한 신호 대 노이즈 비율 악화, △보안 취약점 리포트의 정제되지 않은 대량 유입, △기존 기여자 동기 구조 훼손 가능성, △코드 출처 및 라이선스 불확실성, △플랫폼 인프라의 부적합성 등으로, 기존의 오픈소스 유지보수 문제를 AI에 의해 격화시킨 양상입니다.

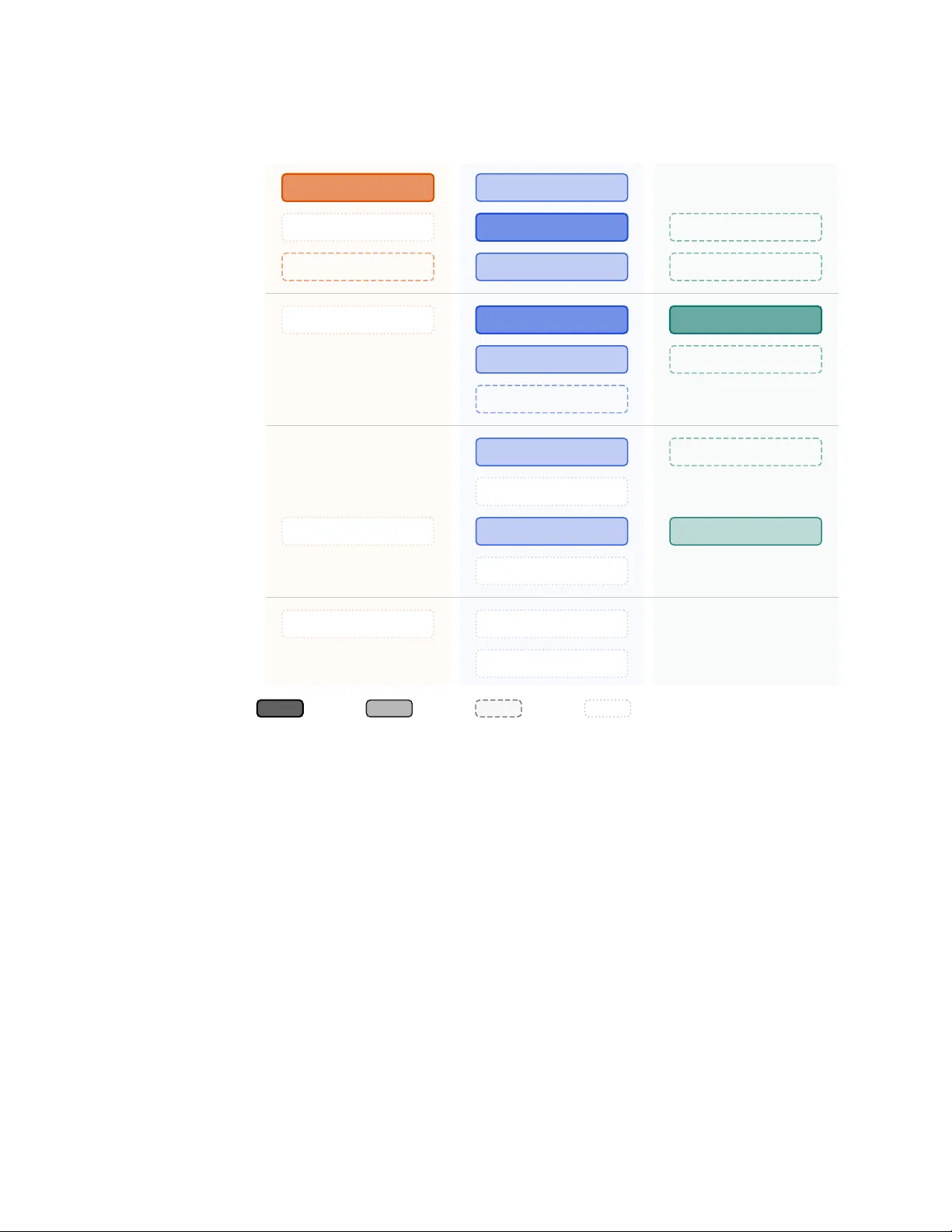

이러한 문제 인식에 기반하여, 각 프로젝트는 서로 다른 '거버넌스 방향성'(RQ2)을 형성하고 있었습니다. 분석 결과, 프로젝트의 대응은 크게 세 가지 유형으로 구분되었습니다. (1) **금지주의**: AI 생성 기여를 출처 불명, 라이선스 위험, 유지보수 불가능성을 이유로 원칙적으로 금지합니다. (2) **경계와 책임**: AI 사용을 완전 차단하지는 않지만, 반드시 공개할 것을 요구하며, 최종 책임은 AI를 사용한 인간 기여자에게 귀속시킵니다. AI 도구의 행동을 리포지토리 규칙(AGENTS.md)으로 직접 제어하기도 합니다. (3) **품질 우선**: 생성 수단에 관계없이 최종 결과물의 품질과 적합성만을 판단 기준으로 삼아 AI를 하나의 도구로 수용합니다.

연구진은 이러한 방향성을 구현하는 구체적인 수단으로 12가지 반복적으로 나타나는 '거버넌스 전략'을 추출 및 정리했습니다. 전략에는 △AI 사용 의무 공개 △기여자 책임 주지 △도구 행동 제어(AGENTS.md) △보안 채널 분리 △저품질 기여 자동화 필터링 △외부 PR 일시 중단 △플랫폼 이전 △라이선스 명시화 등이 포함됩니다. 예를 들어, AGENTS.md 파일은 AI 코딩 에이전트에게 해당 리포지토리의 기여 규칙, 테스트 요구사항, 허용되지 않는 변경 범위 등을 직접 지시하는 새로운 메타 거버넌스 도구로 등장했습니다.

결론적으로, 이 연구는 생성형 AI 시대의 오픈소스 거버넌스가 단순한 '금지' 논의를 넘어, 책임성(Accountability), 검증(Verification), 리뷰 역량(Review Capacity), 코드 출처(Provenance), 플랫폼 인프라(Platform Infrastructure)라는 다섯 가지 축에서 조율된 대응이 필요함을 강조합니다. 연구는 산발적인 커뮤니티 실천을 체계화한 개념적 기준을 제시함으로써, 향후 연구를 위한 기초를 마련하고, 유지보수자와 플랫폼 설계자에게 실용적인 참조 지침을 제공하는 데 기여합니다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기