샤플리와 롤스의 조화: 불공정성 측정과 설명을 위한 통합 프레임워크

이 논문은 AI의 공정성과 설명가능성을 통합하는 새로운 프레임워크를 제시합니다. 협력 게임 이론의 샤플리 가치를 활용하여 표준 그룹 공정성 기준(독립성, 분리, 충분성) 하에서 불공정성을 정의하고, 그 원인이 되는 특징을 설명합니다. 2단계 샤플리 접근법을 통해 먼저 그룹 간 불공정성을 측정한 후, 각 그룹 내 특징들의 기여도를 분해합니다. 이 방법론은 계산 효율성이 높은 ESL 값 계열로 확장 가능하며, 센서스 소득 데이터에 적용한 결과 '연…

저자: Fadoua Amri-Jouidel, Emmanuel Kemel, Stéphane Mussard

이 논문 "Shapley meets Rawls: an integrated framework for measuring and explaining unfairness"은 인공지능의 두 가지 핵심 윤리적 관심사인 알고리즘 공정성과 설명가능성을 수학적으로 통합하는 새로운 방법론을 제안합니다. 저자들은 공정성 기준을 정의하고 감사하는 작업과, 모델 결정의 원인을 설명하는 작업이 지금까지 별개의 영역으로 발전해왔으나, 본 연구에서는 협력 게임 이론의 '샤플리 가치'를 매개로 하여 이 둘을 하나의 체계 안에 결합합니다.

논문은 먼저 서론에서 AI 의사결정 시스템이 확대 적용됨에 따라 발생하는 편향 문제(예: COMPAS 알고리즘, 아마존 채용 도구)를 지적하며, 공정성 모니터링과 설명 제공의 필요성을 강조합니다. 이론적 배경 섹션에서는 그룹 공정성의 세 가지 표준 기준(독립성/통계적 균형, 분리/균등 확률, 충분성/조건부 사용 정확도)과 설명가능성을 위한 특징 기여도 측정 방법(샤플리 가치, 부분 의존도 그림)을 간략히 검토합니다.

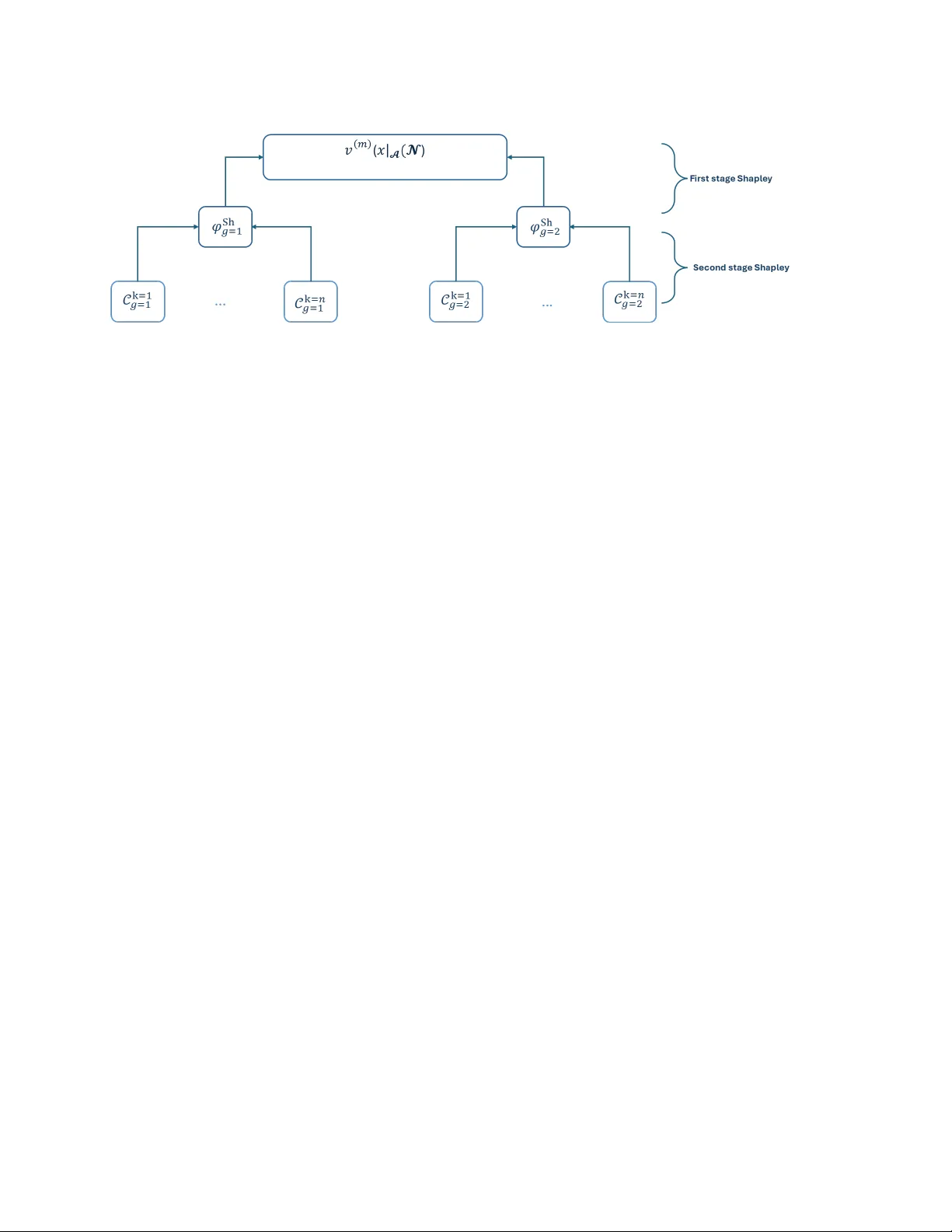

본론의 핵심은 3장과 4장에 있습니다. 3장에서는 주요 정리(Theorem 3.1)를 통해, 민감 속성(예: 성별)에 따른 그룹 간 성과 지표(예: 선택률)의 차이로 정의되는 모든 공정성 위반 사항이, 해당 그룹에 할당된 '그룹-샤플리' 값의 차이와 동일하게 표현될 수 있음을 증명합니다. 이를 기반으로 '2단계 샤플리' 프레임워크를 구축합니다. 1단계에서는 민감 속성의 각 카테고리를 하나의 플레이어로 간주한 협력 게임을 설정해 그룹별 샤플리 값을 계산함으로써 불공정성의 존재와 크기를 측정합니다. 2단계에서는 각 그룹 내에서 다시 특징 변수들을 플레이어로 하는 새로운 게임을 구성하여, 각 특징이 해당 그룹의 성과에 기여한 정도(즉, 1단계에서 계산된 그룹 샤플리 값에 대한 기여도)를 측정합니다. 이 접근법은 불공정성의 원인을 정량적으로 추적할 수 있게 하며, 특징의 기여도가 통계적으로 유의미한지에 대한 점검(추론)도 가능하게 합니다.

4장에서는 이 프레임워크를 샤플리 가치보다 더 일반적인 '효율-대칭-선형(ESL)' 값 계열로 확장합니다. ESL 값은 샤플리 가치를 포함하며, Equal Surplus 값과 같이 계산 효율성이 뛰어난 대안들을 제공합니다. 저자들은 여러 ESL 값을 병행 실행한 후 다수결 방식을 통해 특징 기여도에 대한 보다 견고한 결론을 도출하는 방법을 소개합니다.

5장에서는 UCI 머신러닝 저장소의 센서스 소득 데이터셋을 활용한 실증 분석을 수행합니다. 목표 변수는 개인의 소득이 5만 달러 이상인지 예측하는 것이며, 민감 속성은 성별입니다. 적용 결과, 모든 ESL 값이 성별에 따른 불공정성이 존재함을 확인했습니다. 설명 단계에서는 '연령', '근무 시간', '혼인 상태'가 불공정성 격차에 주요하게 기여하며, 특히 '혼인 상태'는 남성에게는 긍정적, 여성에게는 부정적 영향을 미쳐 격차를 벌리는 주요 원인으로 나타났습니다. 또한 본 논문의 점근적 정규성에 기반한 추론 방법이 기존 부트스트랩 검정과 일관된 결과를 제공하면서도 계산 시간을 단축시킬 수 있음을 보여주었습니다. 6장은 통합 프레임워크의 이론적 우아함과 실용적 유용성을 강조하며 논문을 마무리합니다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기