GaussFusion 기하 정보 기반 비디오 생성으로 야생 3D 재구성 향상

초록

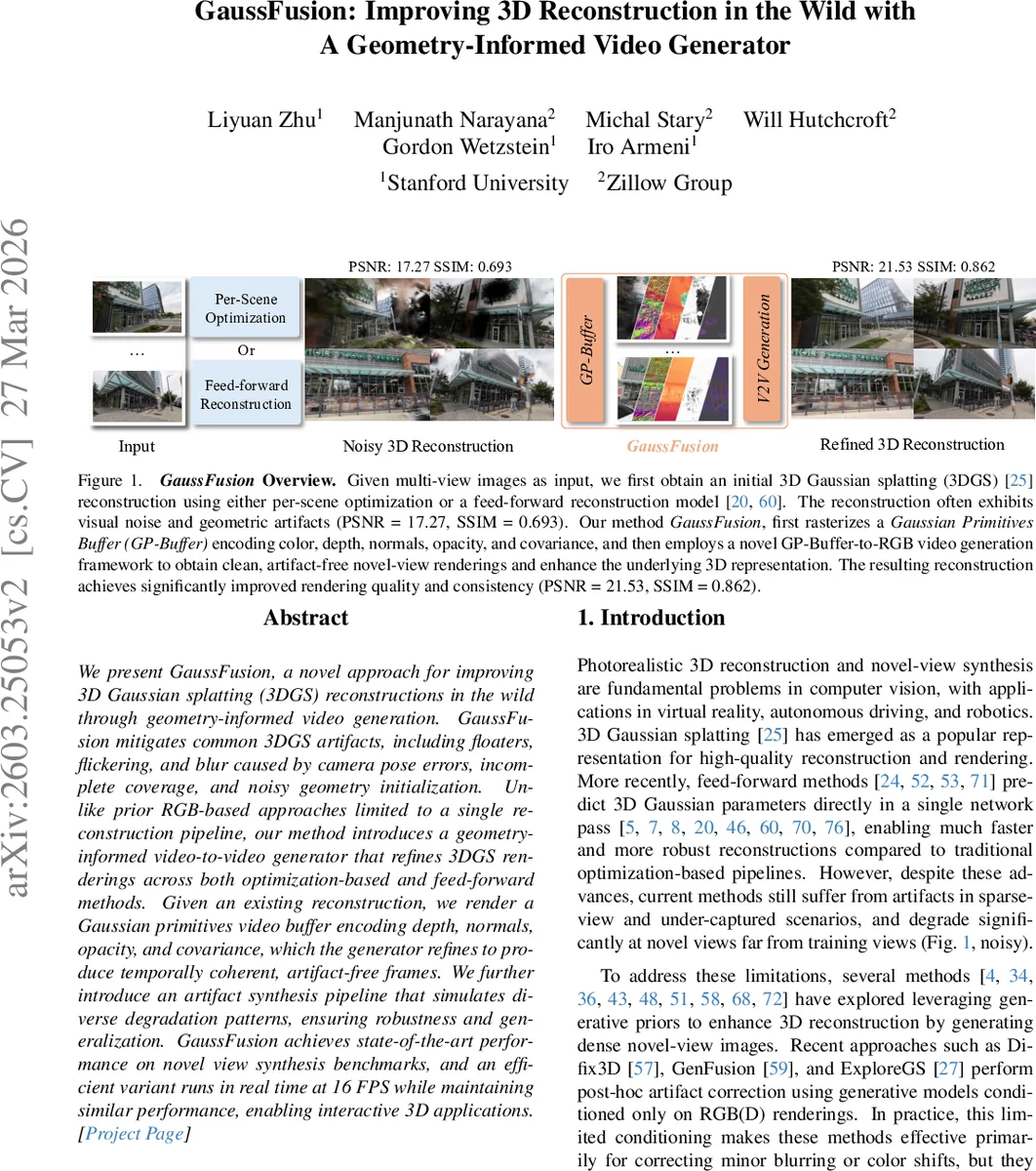

GaussFusion은 3D Gaussian splatting(3DGS) 결과물에 깊이·법선·불투명도·공분산 정보를 포함한 GP‑Buffer를 만든 뒤, 이를 조건으로 하는 비디오‑투‑비디오 생성 모델을 학습한다. 인공적인 아티팩트 합성 파이프라인으로 다양한 손상 패턴을 시뮬레이션해 일반화 능력을 높였으며, 최적화 기반과 피드‑포워드 기반 두 종류의 3DGS 파이프라인 모두에서 품질을 크게 개선한다. 실험에서 PSNR·SSIM 모두 기존 방법을 크게 앞섰고, 15~16 FPS 실시간 변형도 제공한다.

상세 분석

본 논문은 3D Gaussian splatting(3DGS)에서 발생하는 ‘플로터’, ‘깜빡임’, ‘블러’ 등 시각적 아티팩트를 해결하기 위해 두 단계 접근을 제안한다. 첫 번째 단계는 기존 3DGS 결과를 이용해 색, 깊이, 법선, 불투명도, 역공분산을 픽셀 정렬 형태로 저장하는 Gaussian Primitives Buffer(GP‑Buffer)를 생성한다. 이 버퍼는 전통적인 G‑Buffer와 유사하지만, 3D 가우시안의 공분산 정보를 추가함으로써 각 스플랫의 공간적 불확실성을 명시한다. 두 번째 단계는 이 다중모달 정보를 조건으로 하는 비디오‑투‑비디오 생성 모델이다. 모델은 VAE 기반 인코더‑디코더 구조에 흐름 매칭(flow‑matching) 기반 디퓨전 트랜스포머(DiT)를 사용하고, Geometry Adapter(GA) 블록을 통해 GP‑Buffer의 특징을 DiT 레이어에 주입한다. GA 블록은 3D 컨볼루션으로 공간·채널 정렬을 맞춘 뒤, 자체‑어텐션과 텍스트 어텐션을 결합해 기하학적·언어적 컨텍스트를 동시에 반영한다. 이렇게 얻어진 geometry‑aware latent는 흐름 네트워크가 예측한 속도 필드를 통해 노이즈 비디오를 점진적으로 정제하고, 최종적으로 깨끗한 RGB 비디오를 복원한다.

핵심 혁신은 (1) 색 정보만을 이용하는 기존 RGB‑조건 방식과 달리, 깊이·법선·불투명도·공분산이라는 풍부한 기하학적 신호를 활용해 아티팩트의 원인을 직접 파악하고 보정한다는 점이다. (2) 다양한 3DGS 파이프라인(최적화 기반, 피드‑포워드 기반)에서 나타나는 손상 유형을 모방한 대규모 아티팩트 합성 파이프라인을 구축해 75K+ 비디오를 생성, 모델이 광범위한 노이즈 패턴에 노출되도록 함으로써 일반화 능력을 크게 향상시켰다. (3) 흐름 매칭 기반 디퓨전 모델을 사용해 전통적인 확산 모델보다 연산 효율성을 높였으며, 몇 단계만 fine‑tuning 하면 실시간(≈15 FPS) 변형을 구현할 수 있다.

실험에서는 기존 3DGS 기반 방법들에 비해 PSNR이 4 dB 이상, SSIM이 0.17 이상 상승했으며, 특히 최적화 기반 파이프라인에서 ‘플로터’와 ‘깜빡임’이 거의 사라졌다. 또한, 피드‑포워드 모델에 적용했을 때도 성능 저하 없이 동일한 개선 효과를 보였다. Ablation study에서는 GP‑Buffer에 포함된 각 모달리티(깊이, 법선, 불투명도, 역공분산)의 기여도를 분석했으며, 특히 역공분산(불확실성) 맵이 고주파 영역에서의 아티팩트 제거에 큰 영향을 미침을 확인했다. 한계점으로는 매우 희박한 뷰포인트에서의 완전한 재구성 실패와, 텍스처가 전혀 없는 영역에서의 색 재생 정확도가 다소 낮은 점을 들 수 있다. 향후 연구에서는 멀티스케일 GP‑Buffer 설계와 텍스처‑전용 보강 모듈을 도입해 이러한 약점을 보완할 수 있을 것으로 기대한다.

댓글 및 학술 토론

Loading comments...

의견 남기기