행성 탐사 로버를 위한 딥러닝 기반 실시간·오프라인 비전 시스템

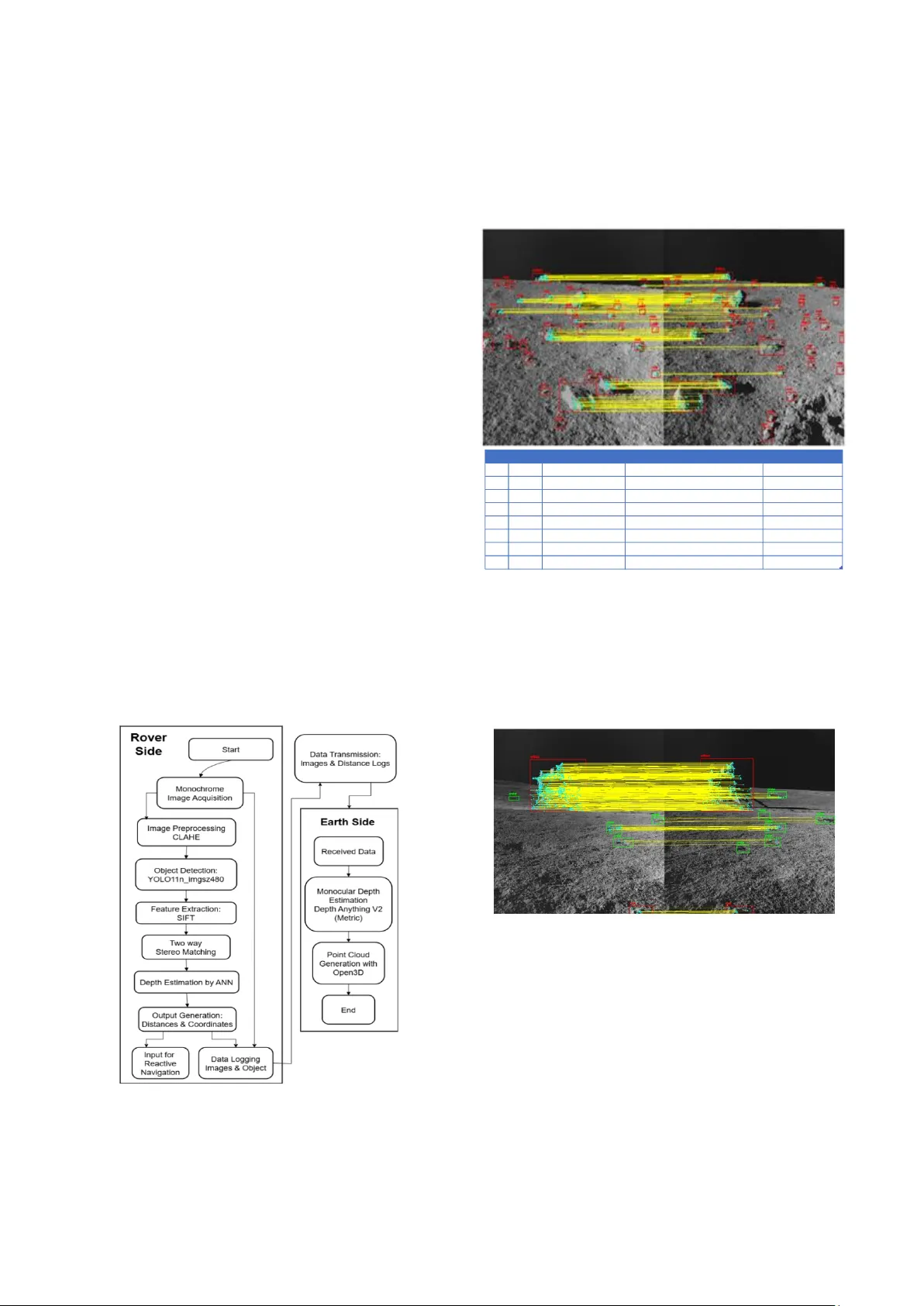

본 논문은 달 탐사 로버의 제한된 연산 자원을 고려하여, 실시간 물체 검출·거리 추정과 오프라인 고해상도 지형 재구성을 결합한 이중 파이프라인 비전 시스템을 제안한다. 실시간 모듈은 CLAHE 전처리된 스테레오 이미지에 경량 YOLOv11n을 적용하고, ROI 내부 SIFT 키포인트를 매칭한 뒤 4입력(좌·우 이미지 좌표) ANN으로 거리(깊이)를 추정한다. 오프라인 모듈은 Depth Anything V2 메트릭 모델로 단일 이미지에서 밀집 깊…

저자: Lomash Relia, Jai G Singla, Amitabh

이 논문은 행성 탐사 로버가 직면하는 제한된 연산 자원, 통신 지연, 그리고 복잡하고 텍스처가 부족한 외계 지형이라는 두 가지 핵심 도전을 동시에 해결하기 위해, 실시간 인지와 오프라인 고해상도 재구성을 결합한 이중 파이프라인 비전 시스템을 제안한다. 시스템은 크게 두 모듈로 나뉜다. 첫 번째는 로버에 탑재된 실시간 모듈로, CLAHE(Contrast Limited Adaptive Histogram Equalization) 전처리를 통해 스테레오 이미지의 국부 대비를 향상시킨 뒤, 경량 YOLOv11n(‘nano’) 모델을 적용해 회색조 달 이미지에서 크레이터, 바위, 인공물 등 세 가지 클래스를 검출한다. 검출된 객체의 바운딩 박스 내부를 ROI(Region of Interest)로 설정하고, 해당 영역에서만 SIFT(Scale‑Invariant Feature Transform) 키포인트를 추출한다. 이렇게 제한된 영역에서만 키포인트를 매칭함으로써 연산량을 크게 절감하고, 저텍스처 환경에서도 매칭 성공률을 높인다.

양쪽 이미지에서 매칭된 키포인트 쌍은 (x₁, y₁, x₂, y₂) 형태의 4차원 입력으로 변환되어, 인공신경망(ANN)에 전달된다. ANN은 3개의 은닉층(128, 64, 16 뉴런)과 Leaky ReLU 활성화를 사용하며, 손실 함수는 평균 절대 오차(MAE), 최적화는 NAdam을 적용한다. 학습 데이터는 ISRO가 제공한 CAHV 기반 삼각측량 유틸리티를 이용해 실제 스테레오 쌍에서 얻은 거리값을 라벨링한 것으로, 약 3,800개의 샘플을 포함한다. 학습 결과 ANN은 평균 0.15 cm 수준의 훈련 오차를 보였으며, 테스트에서는 1‑10 m 구간에서 중앙값 절대 오차 2.26 cm, 사분위 범위 0.91‑5.58 cm를 기록한다. 이는 전통적인 CAHV 삼각측량과 비교해 동일하거나 더 높은 정확도를 유지하면서도, 배치 추론을 통한 연산 효율성에서 큰 이점을 제공한다.

실시간 모듈은 객체별 거리 추정값을 로버의 온보드 메모리와 통신 시스템에 기록·전송한다. 이때 객체의 2D 위치는 바운딩 박스 좌표로 이미 확보되어 있으므로, ANN은 거리(깊이)만을 출력한다. 이렇게 얻어진 절대 거리 정보는 로버의 장애물 회피 및 경로 계획에 직접 활용될 수 있다.

두 번째는 오프라인 모듈로, 로버가 수집한 좌측 이미지에 대해 Depth Anything V2 메트릭 모델을 적용해 단일 이미지 기반 밀집 깊이 맵을 생성한다. Depth Anything V2는 대규모 멀티모달 데이터로 사전 학습된 최신 단일 이미지 깊이 추정 모델로, 회색조 달 이미지에서도 의미 있는 상대 깊이 정보를 제공한다. 생성된 깊이 맵은 Open3D 라이브러리를 이용해 포인트 클라우드로 변환되며, 실시간 모듈에서 얻은 객체별 절대 거리와 결합한다. 이 융합 과정은 객체 주변의 정밀한 거리 정보를 전역적인 지형 모델에 삽입함으로써, 시각적으로 일관되면서도 메트릭(절대 거리) 정확성을 유지하는 고해상도 3D 재구성을 가능하게 한다.

시스템 전체는 Chandrayaan‑3 Pragyan 로버의 NavCam 스테레오 이미지(베이스라인 0.24 m, 39° 시야각)를 대상으로 평가되었다. 실시간 모듈은 480×480 입력 해상도에서 약 12 fps의 추론 속도를 달성했으며, 전력 소모와 메모리 사용량이 로버의 제한된 하드웨어 사양(예: 저전력 GPU 또는 FPGA) 내에서 충분히 실행 가능함을 보였다. YOLOv11n은 회색조 달 이미지에 대해 높은 정밀도와 적당한 재현율을 유지했으며, 특히 false‑positive를 최소화해야 하는 위험 회피 시나리오에 적합하였다.

오프라인 모듈은 생성된 포인트 클라우드가 시각적으로 풍부하면서도, 실시간 모듈에서 추정한 객체 거리와 일관된 메트릭 정보를 포함함을 확인하였다. 이는 과학적 분석(예: 지형 특성 조사, 샘플 위치 기록)과 동시에, 로버의 자율 주행에 필요한 정확한 거리 정보를 제공한다는 점에서 큰 의미가 있다.

논문은 또한 현재 시스템의 한계와 향후 연구 방향을 제시한다. ANN 기반 삼각측량은 데이터‑드리븐 방식으로, 물리‑인포메드 뉴럴 네트워크를 도입해 기하학적 제약을 명시적으로 모델에 통합하면 일반화 능력이 향상될 수 있다. 또한, 현재 파이프라인은 인지와 재구성에 초점을 맞추고 있으나, 자율 제어와 의사결정 로직이 결합되지 않았다. 향후 경량 강화학습(RL) 정책을 통합해 로버가 실시간으로 탐색‑회피‑경로 계획을 수행하도록 확장하는 것이 제안된다. 마지막으로, 시각적 오도메트리와 SLAM(동시 위치추정 및 지도작성) 프레임워크와의 연계가 이루어지면, 전역적인 위치 추정과 지형 매핑이 더욱 견고해질 것이다.

결론적으로, 이 연구는 제한된 연산 자원을 가진 행성 로버가 실시간으로 장애물을 감지하고 거리 정보를 제공함과 동시에, 고해상도 3D 지형 재구성을 수행할 수 있는 효율적이고 확장 가능한 비전 시스템을 제시한다. 이는 향후 달·화성 등 다양한 행성 탐사 임무에서 자율 주행 및 과학 데이터 수집을 동시에 지원하는 핵심 기술로 활용될 가능성을 보여준다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기