컨텍스트 관계를 위한 변환기 표현력: 측정론적 관점과 Sinkhorn 변환기

초록

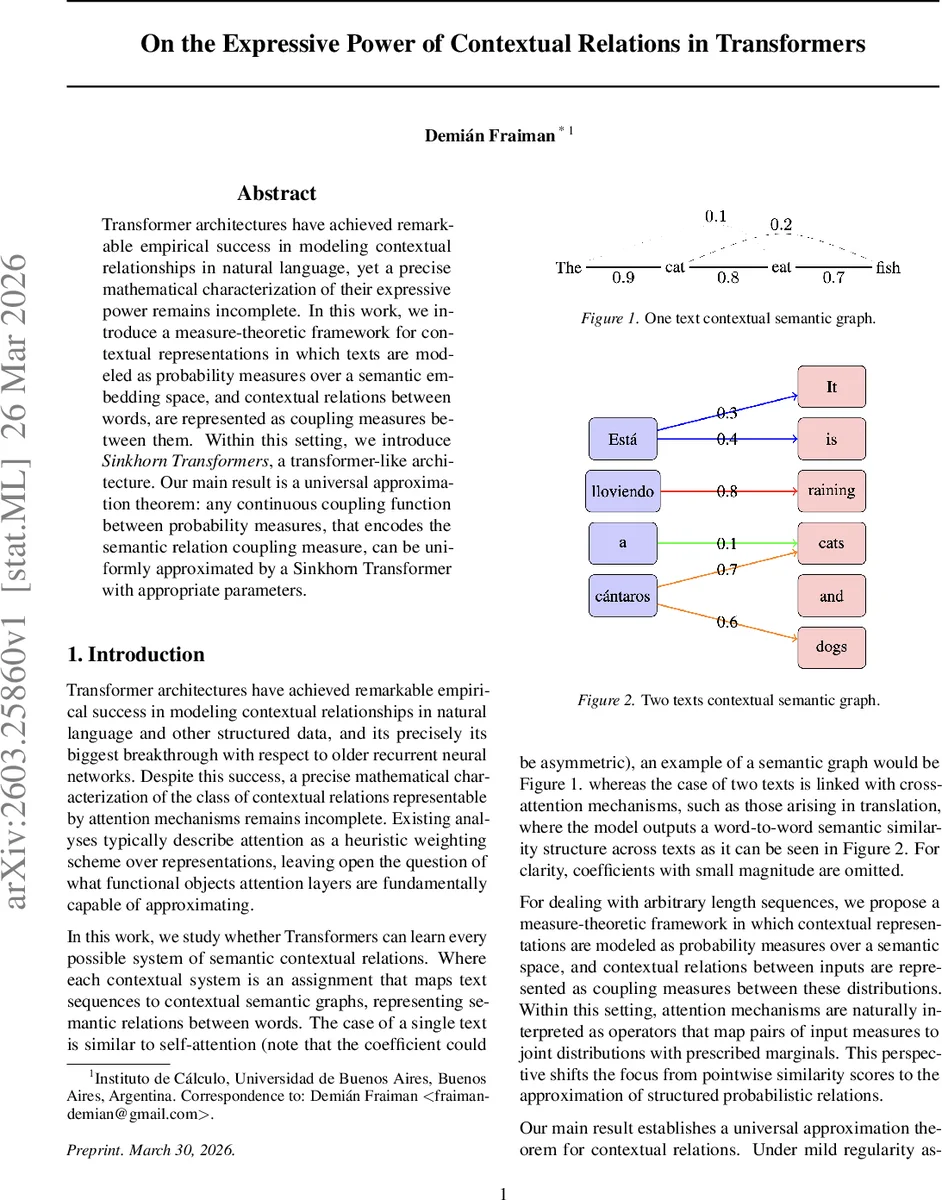

본 논문은 텍스트를 의미 임베딩 공간 위의 확률 측도로 모델링하고, 단어 간 컨텍스트 관계를 두 측도 사이의 커플링(결합) 측도로 정의한다. 이를 기반으로 Sinkhorn 연산을 최종 레이어에 적용한 새로운 변형인 “Sinkhorn Transformer”를 제안하고, 연속적인 커플링 함수를 임의의 정밀도로 근사할 수 있음을 보이는 보편 근사 정리를 증명한다.

상세 분석

이 연구는 기존 트랜스포머의 표현력을 “점wise 벡터 매핑”이 아니라 “확률 측도 사이의 결합 매핑”이라는 함수적 관점에서 재정의한다. 텍스트를 ( \mu = \frac{1}{n}\sum_{i=1}^{n}\delta_{x_i} \in \mathcal{P}(X) ) 로 표현함으로써 가변 길이 시퀀스를 고정 차원의 공간에 자연스럽게 매핑한다는 점이 핵심이다. 여기서 (X\subset\mathbb{R}^d)는 의미 임베딩의 컴팩트 집합이며, 두 텍스트 (\mu,\nu) 사이의 의미 관계는 (\Pi(\mu,\nu))에 속하는 커플링 (\pi) 로 정의된다. 논문은 이러한 커플링을 연속적인 매핑 (F:\mathcal{P}(X)\times\mathcal{P}(Y)\to\mathcal{P}(X\times Y)) 로 보는 “커플링 시스템”을 도입하고, 이를 위상적으로는 약한 위상(weak topology)에서 연속함을 요구한다.

다음으로 저자는 기존 멀티헤드 어텐션을 측도‑값 함수 (\Gamma_\theta) 로 일반화한다. (\Gamma_\theta(\mu,x)=x+\sum_{h=1}^H W_h\int_X\text{softmax}\theta^h(\mu;x,y),V_h y,d\mu(y)) 형태는 연속적인 확률 측도에 대해 적분 형태로 정의되며, 이때 (\text{softmax}\theta^h)는 (Q,K) 매트릭스를 이용한 정규화된 커널이다. 이러한 정의는 이산적인 경우와 완전히 일치함을 보이며, 측도‑값 어텐션이 기존 어텐션의 자연스러운 확장임을 증명한다.

핵심 이론적 기여는 두 단계에 있다. 첫째, 커플링 시스템 공간 (\mathcal{A}\mathcal{P})를 연속 함수 공간 (C(\mathcal{P}(X)\times\mathcal{P}(Y),\mathcal{M}(X\times Y))) 안의 폐합된 볼록 집합으로 정의하고, 이 공간이 위상적으로 완비임을 보인다. 둘째, 엔트로피 정규화된 최적 수송(Sinkhorn) 연산자를 (\mathcal{S}{c,\varepsilon}) 로 도입하여, 비용 함수 (c) 가 연속이면 (\mathcal{S}_{c,\varepsilon}) 가 Lipschitz 연속이며, 비용을 미세하게 변형해도 최적 플랜이 약한 위상에서 연속적으로 변한다는 기존 결과(Nutz & Wiesel, 2022)를 활용한다.

Lemma 5.4와 Theorem 5.5는 “임의의 커플링 (\pi)는 연속적인 비용을 갖는 엔트로피 정규화 최적 수송 플랜으로 근사될 수 있다”는 사실을 증명한다. 여기서 근사는 약한 위상에서의 수렴을 의미하며, Approximate Selection Theorem을 이용해 연속적인 비용 함수의 선택자를 구성한다. 결과적으로, 비용 함수를 (-\log s) 로 설정하면 Sinkhorn 연산자가 원하는 커플링에 arbitrarily 가까워질 수 있다.

이론적 결과를 실제 모델에 적용하기 위해 저자는 “Sinkhorn Transformer”를 설계한다. 기존 트랜스포머 레이어를 그대로 사용하면서, 최종 레이어에 Sinkhorn 연산자를 삽입한다. 이렇게 하면 중간 표현은 기존과 동일하게 학습되지만, 출력은 명시적으로 두 텍스트 간의 결합 측도로 해석될 수 있다. 실험적 검증은 논문에 포함되지 않았지만, 제안된 구조는 교차‑어텐션, 문서‑문서 매칭, 그리고 의미 그래프 생성 등 다양한 NLP 태스크에 직접 적용 가능하다.

전체적으로 이 논문은 트랜스포머의 표현력을 “확률적 관계(커플링) 근사”라는 새로운 수학적 틀로 확장함으로써, 기존의 벡터‑값 함수 근사 한계를 넘어서는 보편성 결과를 제공한다. 이는 특히 의미론적 관계를 정량화하고, 최적 수송 이론과 연결시켜 모델 해석성을 높이고자 하는 연구자들에게 중요한 이정표가 될 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기