다중언어 표현형 음성합성, Voxtral TTS

Voxtral TTS는 3초 수준의 짧은 음성 샘플만으로도 자연스럽고 감정이 풍부한 다국어 음성을 생성하는 모델이다. 자동회귀 방식으로 의미 토큰을 생성하고, 흐름 매칭(Flow‑Matching)으로 음향 토큰을 예측하는 하이브리드 구조를 사용한다. Voxtral Codec이라는 새로운 코덱은 VQ와 FSQ를 결합한 하이브리드 양자화 방식을 적용해 2.14 kbps의 초저비트 레이트로 의미·음향 토큰을 압축한다. 인간 청취자 평가에서 Eleve…

저자: Alex, er H. Liu, Alexis Tacnet

본 논문은 “Voxtral TTS”라는 새로운 다국어 제로샷 텍스트‑투‑스피치(TTS) 시스템을 제안한다. 핵심 아이디어는 음성 입력을 의미 토큰과 음향 토큰으로 명시적으로 분리하고, 각각을 최적화된 방법으로 생성·복원하는 하이브리드 아키텍처를 구축하는 것이다.

1. **Voxtral Codec**

- 24 kHz 단일채널 파형을 240 샘플(10 ms) 패치 단위로 나누어 100 Hz 입력으로 변환한다.

- 4개의 인코더 블록은 슬라이딩 윈도우 어텐션(ALiBi, QK‑norm, LayerScale)과 인과적 CNN 다운샘플링을 결합해 12.5 Hz(80 ms) 프레임으로 압축한다.

- 292 차원 라티스는 256 차원 의미 부분과 36 차원 음향 부분으로 분리된다.

- 의미 부분은 8192 크기의 VQ 코드북으로 양자화하고, 50 % 확률로 양자화 없이 통과시켜 학습 안정성을 높인다.

- 음향 부분은 각 차원을 21 레벨의 FSQ(Finite Scalar Quantization)로 양자화한다. 훈련 시 50 %는 FSQ, 25 %는 dither, 25 %는 무양자화 방식으로 섞어 사용한다.

- 전체 비트레이트는 약 2.14 kbps이며, 의미·음향 토큰을 37개(1 semantic + 36 acoustic)로 구성한다.

2. **ASR 디스틸레이션 손실**

- 사전 학습된 Whisper 모델을 이용해 음성의 텍스트 정렬 정보를 추출한다.

- 의미 토큰의 VQ 임베딩을 Whisper의 마지막 레이어 히든 상태와 코사인 유사도로 정렬한다.

- 교차 주의 가중치를 소프트 정렬 행렬(A)로 변환해, 의미 토큰이 텍스트와 정확히 매핑되도록 유도한다.

3. **디코더 백본**

- Ministral 3B와 유사한 자동회귀 디코더‑전용 트랜스포머를 사용한다.

- 입력은 음성 프롬프트 토큰(의미 + 음향) 뒤에 텍스트 토큰을 이어 붙인 시퀀스이며, 출력은 의미 토큰 시퀀스이다.

- 의미 토큰은 8192‑크기 코드북에 대한 소프트맥스 로짓을 예측하고, 교차 엔트로피 손실로 학습한다.

4. **Flow‑Matching 트랜스포머**

- 의미 토큰이 생성될 때마다 해당 프레임의 음향 토큰을 연속적인 공간에서 예측한다.

- Gaussian noise를 시작점으로 하여 0 ~ 1 구간을 8 단계(Euler)로 적분하는 흐름 매칭 방식을 채택한다.

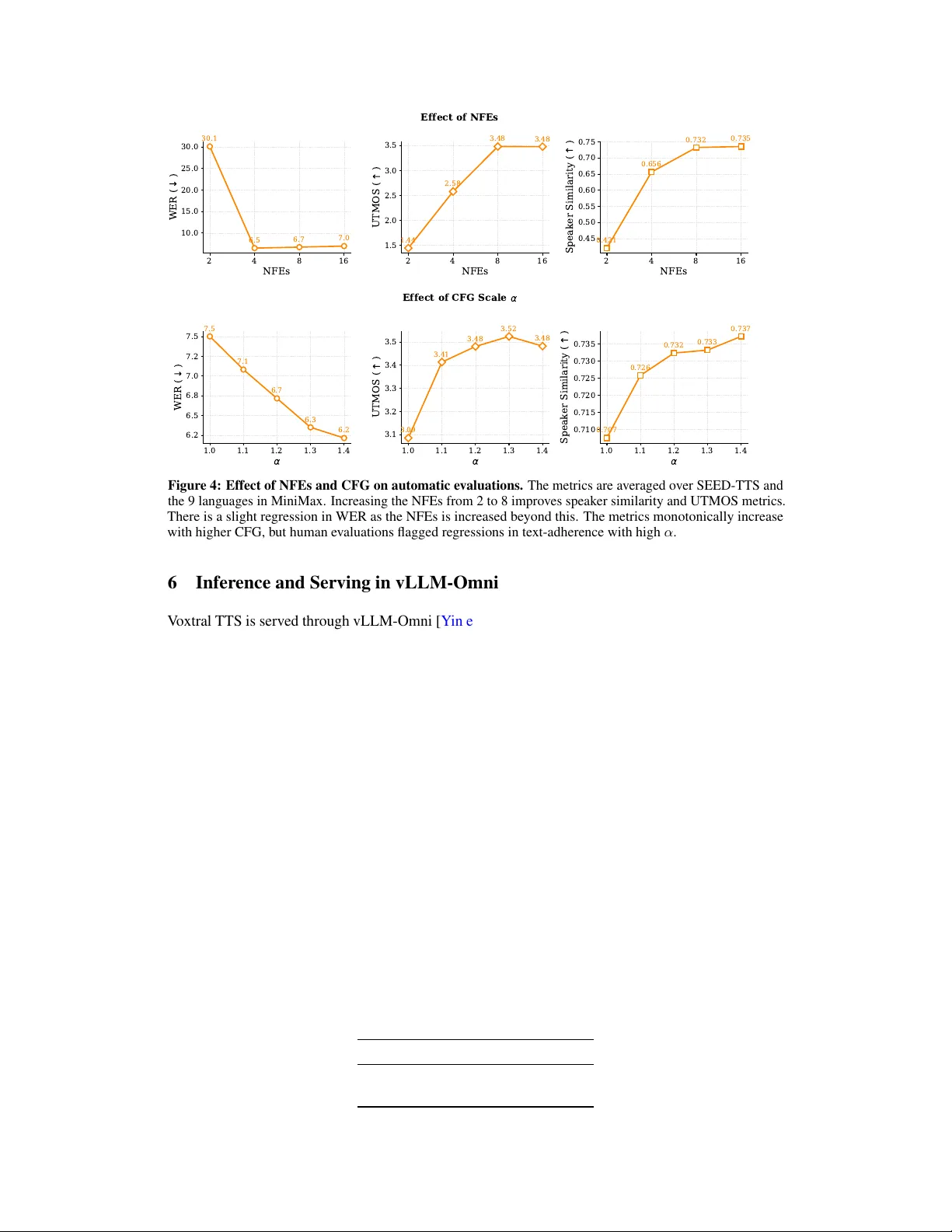

- 조건부(디코더 히든 상태 h)와 무조건부(벡터 0) 두 모델을 혼합해 classifier‑free guidance(CFG)를 적용한다.

- 최종 연속값을 21 레벨 FSQ로 양자화해 이산 음향 토큰을 얻고, 다음 자동회귀 단계에 피드한다.

5. **학습 전략**

- Voxtral Mini Transcribe를 이용해 자동 라벨링된 다국어 음성‑텍스트 쌍을 구축한다.

- 각 샘플은 (음성 프롬프트 A₁, 텍스트 T₂, 목표 음성 A₂) 형태이며, A₁과 A₂는 동일 화자이지만 시간적으로는 독립적이다.

- 손실은 의미 토큰에 대한 교차 엔트로피와 음향 토큰에 대한 흐름 매칭 손실을 결합한다.

- 코덱은 멀티스케일 STFT, L1 재구성 손실, 그리고 8개의 판별기를 활용한 적대적 손실을 동시에 최적화한다.

6. **실험 및 평가**

- 자동 평가(SEED‑TTS, MiniMax‑TTS)에서 기존 상용 모델을 앞선 인식률과 자연스러움을 기록한다.

- 인간 청취자 평가에서는 두 가지 시나리오(플래그십 보이스, 제로샷 보이스 클로닝)에서 ElevenLabs Flash v2.5 대비 각각 58.3 %와 68.4 %의 승률을 얻었다.

- 9개 언어를 지원하며, 3 초 길이의 짧은 음성 프롬프트만으로도 충분히 고품질 음성을 생성한다.

- 모델 파라미터는 약 300 M이며, 스트리밍 추론을 위한 저지연 설계가 적용되었다.

7. **기여 및 의의**

- 의미‑음향 토큰을 명확히 분리하고, 각각에 최적화된 양자화·생성 방식을 적용함으로써 기존의 전통적인 전체 자동회귀 혹은 전부 연속 흐름 모델의 한계를 극복한다.

- FSQ와 VQ를 결합한 하이브리드 양자화는 초저비트 레이트에서도 풍부한 음향 디테일을 유지한다.

- 흐름 매칭을 통한 연속 음향 예측은 계산 효율성을 높이며, CFG 적용 비용이 디코더 백본에 비해 매우 낮다.

- ASR 디스틸레이션을 활용한 의미 토큰 학습은 텍스트와의 정렬성을 강화해 제로샷 보이스 클로닝 성능을 크게 향상시킨다.

결론적으로 Voxtral TTS는 짧은 음성 프롬프트 기반 다국어 고품질 TTS를 실시간 스트리밍 수준으로 구현한 최초의 시스템 중 하나이며, 모델 가중치를 CC BY‑NC 라이선스로 공개함으로써 연구 커뮤니티와 산업계 모두에게 중요한 자원을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기