신경진화 기반 적대적 견고성 설계 NERO‑Net

NERO‑Net은 표준 학습만으로도 내재된 적대적 견고성을 가진 CNN 구조를 자동 탐색한다. 진화 과정에서 FGSM 기반 적대적 정확도를 포함한 복합 적합도 Fβ를 사용해 청정 정확도와 공격 저항성을 동시에 최적화한다. CIFAR‑10 실험에서 33 % FGSM 정확도와 87 % 청정 정확도를 보인 최적 구조가 표준 학습 후 47 %/93 %까지 향상되었으며, 추가적인 적대적 훈련으로 AutoAttack에 대해 약 40 %의 견고성을 달성했다…

저자: Inês Valentim, Nuno Antunes, Nuno Lourenço

본 논문은 안전‑중요 분야에서 신경망의 적대적 취약성을 극복하기 위해, 진화적 설계 단계에서부터 견고성을 내재화하는 새로운 프레임워크 NERO‑Net을 제시한다. 기존의 신경진화(Neuroevolution)와 신경망 구조 탐색(NAS) 연구는 주로 예측 성능을 최우선 목표로 삼아 왔으며, 견고성을 확보하려면 별도의 적대적 훈련(adversarial training) 과정을 도입해야 했다. 그러나 이러한 접근은 아키텍처 자체가 견고성에 기여하는 정도를 분리하기 어렵게 만든다. NERO‑Net은 이러한 한계를 인식하고, 진화 과정에서 적대적 공격에 대한 저항성을 직접 평가·최적화한다.

### 1. 연구 배경 및 동기

- 적대적 예제(Adversarial Examples)는 작은 Lp‑norm 교란으로 모델을 오분류하게 만들며, 특히 이미지 분류에서 큰 위협이 된다.

- 현재 가장 효과적인 방어는 적대적 훈련이지만, 이는 데이터와 연산 비용을 크게 늘린다.

- 일부 연구는 아키텍처와 견고성의 관계를 탐구했지만, 대부분은 적대적 훈련된 모델을 대상으로 했으며, 탐색 공간이 셀 기반으로 제한적이었다.

### 2. NERO‑Net 설계 원칙

- **아키텍처 중심 견고성**: 적대적 훈련 없이도 구조 자체가 견고성을 제공하도록 설계한다.

- **복합 적합도 Fβ**: 청정 정확도 C와 적대적 정확도 A를 조화 평균 형태로 결합한 Fβ를 사용한다. β 파라미터를 통해 청정 성능과 견고성 간의 가중치를 조절한다.

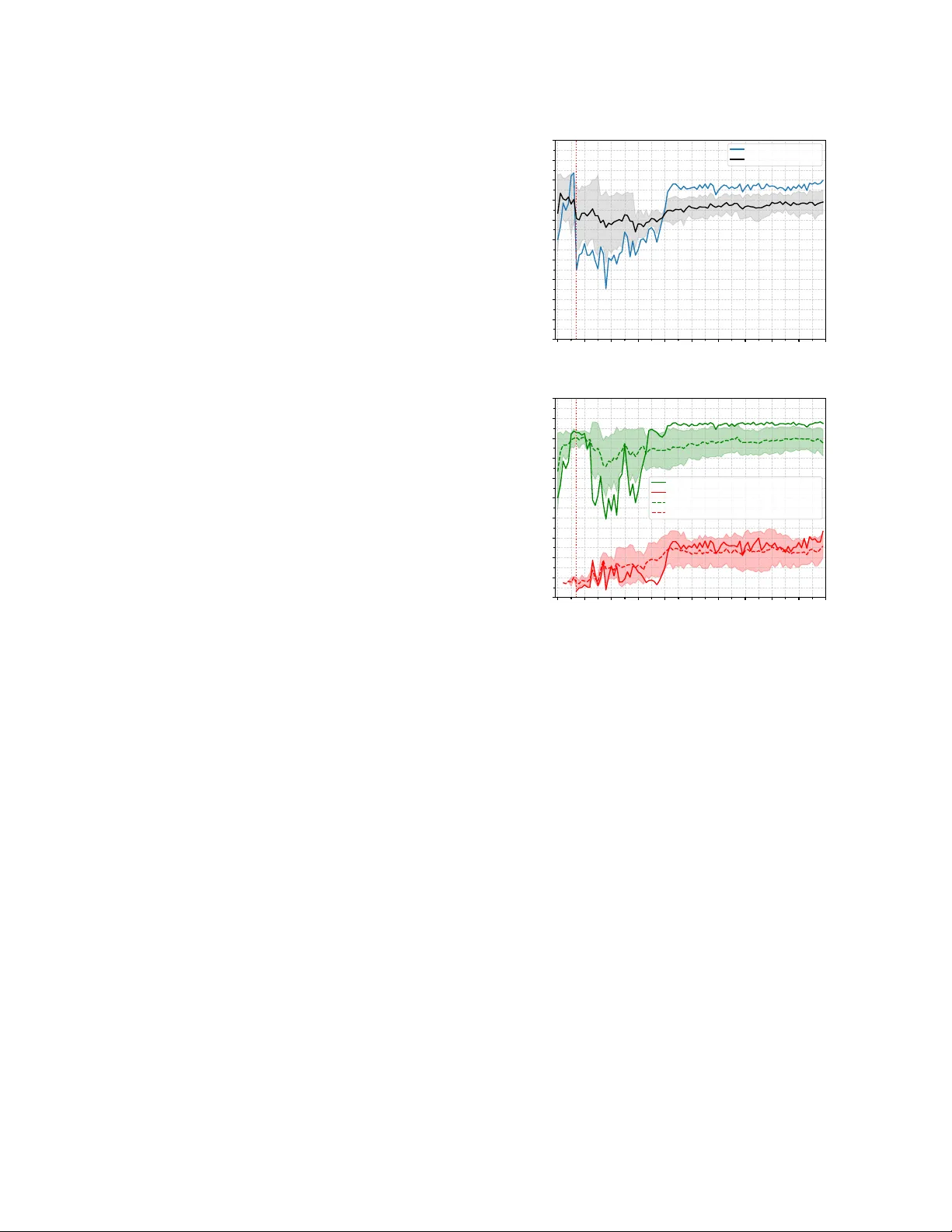

- **워밍업 단계**: 초기에는 β를 무시하고 순수 청정 정확도만을 최적화해 기본적인 표현력을 확보한다. 평균 적합도가 사전 정의된 τ를 초과하면 Fβ로 전환한다.

- **효율적 적대적 평가**: FGSM을 사용해 빠르게 적대적 정확도를 추정한다. FGSM은 계산 비용이 낮아 대규모 진화에 적합하지만, 과도히 낙관적인 추정 위험이 있다. 저자는 강력한 공격을 적용하면 대부분의 개체가 0에 가까운 적대적 정확도를 보이게 되어 선택 압력이 사라진다고 설명한다.

### 3. 진화 알고리즘 및 표현

- **Fast‑DENSER 기반**: 두 단계 유전자를 사용해 매크로 구조(외부 레벨)와 파라미터(내부 레벨)를 동시에 진화한다.

- **블록 기반 문법 확장**: conv‑block·pool‑block 같은 복합 블록을 문법에 직접 포함시켜, 실제 최신 CNN이 사용하는 연산 순서를 자연스럽게 모델링한다. 이는 탐색 공간을 과도하게 확장하지 않으면서도 풍부한 구조적 다양성을 제공한다.

- **변이 연산**: 레이어 추가·삭제·복제, 연결 구조 변형, 실수 파라미터 변이 등을 포함한다.

- **Ill‑fitted 개체 탐지**: 손실이 NaN/∞이 되거나 특정 클래스에 대한 예측 비율이 비정상적으로 높을 경우 해당 개체를 불량으로 간주하고, 적대적 평가를 건너뛰어 페널티를 부여한다. 이는 “robustness trap”을 방지한다.

### 4. 실험 설정

- **데이터셋**: CIFAR‑10, 10 클래스, 32×32 컬러 이미지.

- **공격**: L∞‑norm(ε = 8/255) 기준 FGFG, PGD, APGD, AutoAttack 등 다양한 공격을 사용해 평가한다.

- **진화 예산**: 약 50 세대, 각 세대당 10 개체, 각 개체는 표준 SGD(또는 Adam)로 10 epoch 정도 학습 후 적합도 평가.

- **베이스라인**: 기존 NAS·NE 기반 견고성 탐색 모델, 표준 CNN, 그리고 동일 구조에 대한 적대적 훈련 모델을 비교한다.

### 5. 주요 결과

- **진화 단계**: 최적 개체는 FGSM 정확도 33 %와 청정 정확도 87 %를 동시에 달성했다. 이는 진화 단계에서만 얻은 결과이며, 아직 강력한 공격에 대한 견고성은 낮다.

- **표준 재학습**: 동일 구조를 200 epoch 표준 학습하면 FGSM 정확도 47 %·청정 정확도 93 %로 크게 향상된다. 이는 구조 자체가 일정 수준의 내재적 견고성을 제공함을 의미한다.

- **적대적 훈련**: 추가적인 FGSM 기반 적대적 훈련을 적용하면 AutoAttack에 대해 약 40 %의 견고성을 얻는다. 이는 기존 적대적 훈련 모델 대비 연산 비용이 절감된 상태에서 비슷한 수준의 견고성을 달성한 것으로 해석될 수 있다.

- **다중 위협**: L2‑norm 공격에 대해서도 일정 수준의 저항성을 보였으며, 이는 구조가 특정 노름에 국한되지 않은 일반화된 방어 메커니즘을 내포하고 있음을 시사한다.

### 6. 논의 및 한계

- **FGSM 프록시의 한계**: FGSM은 단일 스텝 공격이므로 실제 견고성을 과대평가할 수 있다. 그러나 진화 단계에서 강력한 공격을 적용하면 선택 압력이 사라지는 문제를 고려해 선택된 전략이다.

- **진화 비용**: 여전히 개별 모델 학습과 FGSM 평가가 필요하므로, 대규모 데이터셋(예: ImageNet)에서는 비용이 크게 증가한다.

- **β 파라미터 선택**: 현재 실험에서는 β = 1을 사용했으며, β에 따른 청정‑견고성 트레이드오프 분석이 부족하다. 자동 β 튜닝이 향후 연구 과제로 남는다.

- **확장성**: 현재는 CIFAR‑10에 국한되었으며, 다른 도메인(예: 자연어 처리, 시계열)에서의 적용 가능성은 미확인이다.

### 7. 결론 및 향후 연구

NERO‑Net은 신경진화 과정에서 적대적 견고성을 직접 최적화함으로써, 기존 적대적 훈련 의존형 방어와 차별화된 접근을 제시한다. 블록 기반 문법 확장과 복합 적합도 Fβ는 탐색 효율성과 선택 압력 유지에 기여한다. 향후 연구에서는 (1) 더 큰 데이터셋·다중 도메인 적용, (2) β 자동 조정 메커니즘, (3) FGSM 외 경량 공격 프록시를 결합한 다중 적합도 설계, (4) 연산 비용을 줄이기 위한 메타러닝 기반 적합도 예측 모델 등을 탐색할 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기