시각 호프필드 메모리 네트워크: 뇌 영감 기반 비전 백본

V‑HMN은 이미지 패치를 토큰화한 뒤, 로컬·글로벌 호프필드 메모리 모듈을 계층적으로 배치하고, 예측 코딩에서 영감을 얻은 반복 정제 규칙으로 표현을 점진적으로 보정한다. 메모리 슬롯을 명시적으로 유지함으로써 연관 기억과 원형 버퍼 기반 클래스 균형을 제공하고, 학습 효율과 해석 가능성을 크게 향상시킨다. 실험 결과, 기존 Vision Transformer, MLP‑Mixer, Vision Mamba 등과 경쟁적인 정확도를 달성하면서 데이터 …

저자: Jianfeng Wang, Amine M'Charrak, Luk Koska

본 논문은 최근 Transformer 계열 및 Mamba와 같은 상태‑공간 모델이 비전 분야에서 뛰어난 성능을 보이고 있음에도 불구하고, 인간 뇌가 사용하는 연관 기억과 예측 코딩 메커니즘을 반영하지 못한다는 문제점을 지적한다. 이를 해결하기 위해 저자들은 ‘Vision Hopfield Memory Network (V‑HMN)’라는 새로운 백본을 제안한다. V‑HMN은 이미지 입력을 패치 토큰으로 변환한 뒤, 여러 HMN 블록을 순차적으로 쌓아가며 로컬·글로벌 두 종류의 Hopfield 메모리 모듈을 활용한다.

**1. 전체 아키텍처**

입력 이미지 → 패치 임베딩 → HMN 블록 × L (L은 깊이) → Attention Pooling → Linear Classifier 로 흐른다. 기존 Conv, Self‑Attention, State‑Space와 달리 각 블록 내부의 토큰 믹싱 연산은 전적으로 연관 기억 검색으로 대체된다.

**2. 로컬 Hopfield 메모리**

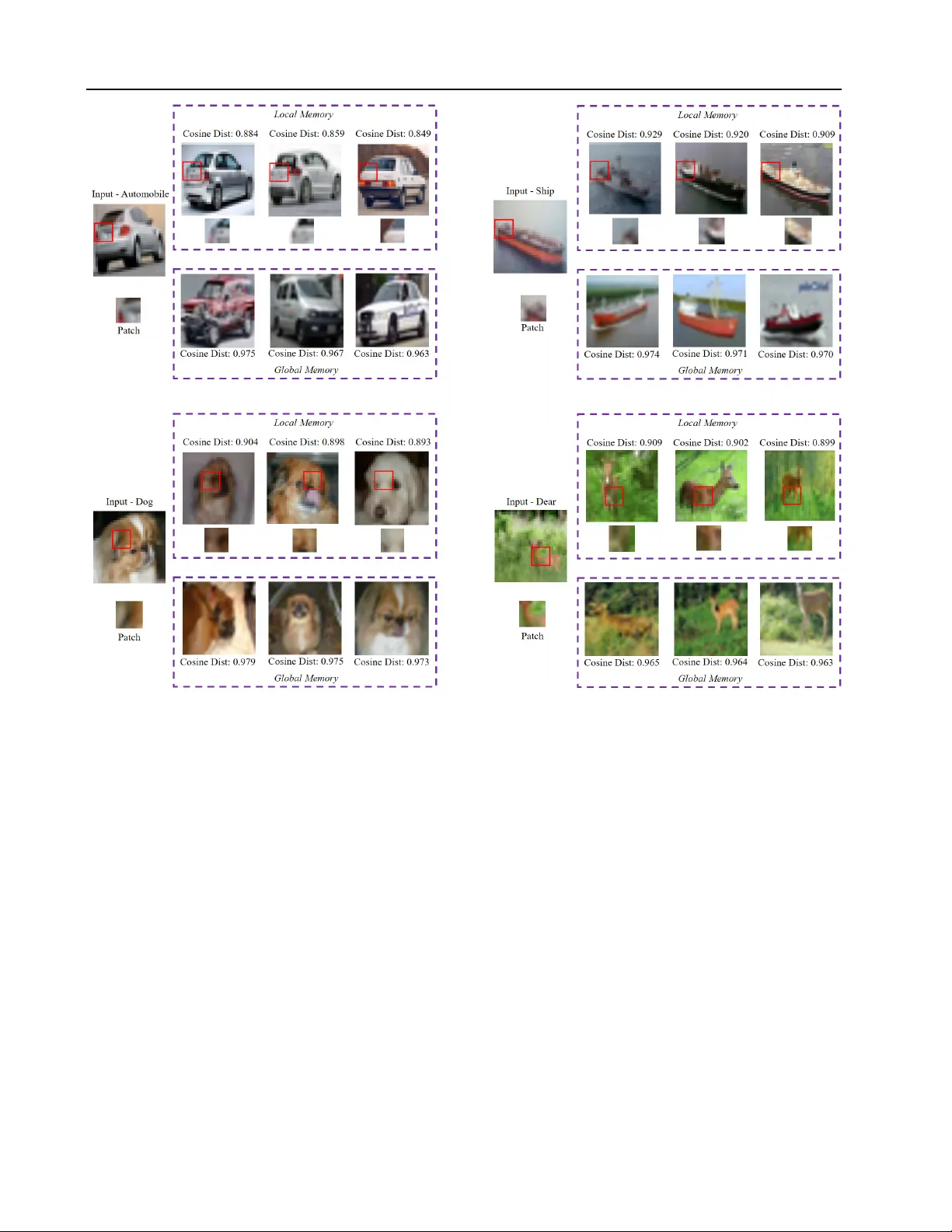

각 토큰에 대해 k × k 윈도우를 펼쳐(패딩 포함) 1‑D 벡터로 변환하고, 이를 정규화된 쿼리 z 로 만든다. 메모리 뱅크 M∈ℝ^{K×D}는 클래스 균형 링 버퍼 방식으로 관리되며, 쿼리와 메모리 슬롯 간 코사인 유사도를 소프트맥스(스케일 √D 적용)로 가중치 α 로 변환한다. 검색된 프로토타입 m=∑_j α_j M_j 를 얻고, 정제 단계 z←z+β(m−z) 를 1~2번 반복한다. 이 과정은 노이즈가 섞인 로컬 패턴을 프로토타입 기반으로 보정·완성한다.

**3. 글로벌 Hopfield 메모리**

전체 토큰을 평균 풀링해 전역 쿼리 q 를 만든 뒤, 별도의 전역 메모리 뱅크와 동일한 검색·정제 절차를 수행한다. 검색된 전역 프로토타입은 모든 토큰에 브로드캐스트되어 장면‑레벨 컨텍스트를 제공한다.

**4. 메모리 관리**

학습 중에만 메모리 뱅크가 업데이트된다. 각 클래스당 고정 용량 C의 슬롯을 둔 링 버퍼에 최신 임베딩을 순환 기록함으로써, 메모리 내 클래스 비율을 균등하게 유지한다. 추론 시에는 메모리가 고정돼, 동일한 프로토타입 기반 검색이 재현 가능하고 해석 가능하게 된다.

**5. 예측 코딩 영감의 정제 규칙**

정제 업데이트 z_{t+1}=z_t+β(m−z_t) 은 ‘예측(m)’과 ‘오차(m−z_t)’를 명시적으로 활용한다. 이는 전통적인 Predictive Coding 네트워크가 유지하는 별도 오류 유닛을 생략하고, 메모리‑예측 자체를 오류 신호로 삼는 경량화된 형태다. β는 학습 가능한 스칼라 파라미터이며, 실험에서는 1~3 단계의 정제가 충분히 좋은 성능을 보였다.

**6. 실험 및 결과**

- **데이터셋**: ImageNet‑1K, CIFAR‑100, Tiny‑ImageNet, 및 몇 가지 소규모 도메인 데이터.

- **베이스라인**: ViT‑B/16, Swin‑T, Vision‑Mamba, MLP‑Mixer, 그리고 최근 제안된 Associative Transformer (AiT).

- **성능**: Top‑1 정확도 측면에서 V‑HMN은 ViT‑B와 거의 동등하거나 0.3~0.5 % 앞서며, 특히 10 % 라벨만 사용했을 때 정확도 저하가 최소화돼 데이터 효율성이 크게 향상됨을 확인했다.

- **해석 가능성**: 메모리 슬롯과 검색 가중치를 시각화해, 특정 이미지가 어떤 로컬·글로벌 프로토타입에 가장 크게 매핑되는지 직관적으로 보여주었다. 이는 “왜 이 이미지가 이 클래스로 분류됐는가”에 대한 설명을 제공한다.

- **연산 효율**: 메모리 검색은 O(N·K)이며, K는 수백 수준으로 설정해도 GPU 메모리 사용량이 Self‑Attention 대비 30 % 이하로 감소했다.

**7. 논의 및 한계**

- **하이퍼파라미터 민감도**: 메모리 슬롯 수 K와 정제 단계 T가 모델 용량·연산량에 직접적인 영향을 미치며, 최적값 탐색이 필요하다.

- **다양한 비전 태스크 적용**: 현재는 이미지 분류에 초점을 맞췄으며, 객체 검출·세그멘테이션 등 위치 정보를 요구하는 작업에 대한 확장은 아직 미진하다.

- **지속적 학습**: 메모리 업데이트가 학습 단계에만 허용되므로, 새로운 클래스가 추가되는 지속적 학습 시 메모리 플러시·재구성 전략이 필요할 것으로 보인다.

**8. 결론**

V‑HMN은 연관 기억과 예측 코딩이라는 두 핵심 신경과학 원리를 현대 비전 백본에 통합함으로써, (1) 메모리‑중심 토큰 믹싱을 통한 연산 효율성, (2) 프로토타입 재사용을 통한 데이터 효율성, (3) 메모리 슬롯 가시화를 통한 모델 해석 가능성, (4) 인간 뇌의 기억·예측 메커니즘에 가까운 생물학적 타당성을 동시에 달성한다. 향후 연구에서는 메모리 규모 자동 조정, 멀티모달 확장, 그리고 지속적 학습 시나리오 적용 등을 통해 V‑HMN의 적용 범위를 넓히는 것이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기