스마트폰 하나로 3D 인간 움직임과 근골격 역학을 측정하는 OpenCap Monocular

OpenCap Monocular는 단일 스마트폰 영상만으로 3차원 골격 자세와 근골격 동역학을 추정한다. WHAM 기반 3D 포즈를 최적화해 물리적 일관성을 확보하고, 역운동학·물리 시뮬레이션·머신러닝을 결합해 지면 반력·관절 모멘트·근력까지 추정한다. 실험 결과, 기존 마커 기반 시스템에 근접한 정확도를 보이며, 두 카메라 기반 OpenCap 대비도 경쟁력을 갖는다.

저자: Selim Gilon, Emily Y. Miller, Scott D. Uhlrich

본 연구는 인간 움직임과 근골격 역학을 대규모로 정량화하기 위한 저비용·고접근성 솔루션으로서, ‘OpenCap Monocular’이라는 단일 스마트폰 영상 기반 시스템을 개발하고 검증하였다. 기존의 골격 마커 기반 모션 캡처는 장비 비용이 150 k달러를 초과하고, 실험실 공간·전문 인력·시간이 많이 소요돼 임상 현장이나 가정에서 활용하기 어렵다. 반면, 스마트폰은 전 세계에 보급된 장치이며, 영상 촬영만으로도 충분히 풍부한 시각 정보를 제공한다. 이에 연구팀은 최신 컴퓨터 비전 모델인 WHAM과 ViTPose를 활용해 초기 3‑D 포즈를 추정하고, 이를 물리적 제약을 포함한 두 단계 최적화 과정을 통해 정제하였다.

첫 단계 최적화에서는 카메라 외부 파라미터와 신체 형태 파라미터(β)를 동시에 추정한다. 여기서는 2‑D 키포인트 재투영 오차, 사용자가 입력한 신장 정보, 초기 형태와의 차이를 최소화하는 정규화 항을 결합한다. 두 번째 단계에서는 이미 고정된 형태를 바탕으로 전역 포즈(θ, τ, Γ)와 카메라 외부 파라미터를 미세 조정한다. 이때 발 접촉 확률을 이용해 발 슬라이드·속도·평탄성 제약을 추가함으로써, 보행 중 발이 미끄러지거나 비현실적인 움직임을 보이는 현상을 크게 억제한다. 최적화는 PyTorch 기반 자동 미분과 GPU 가속을 활용해 전체 영상 시퀀스를 한 번에 처리한다.

정제된 SMPL 메쉬에서 38개의 가상 표면 마커를 추출하고, OpEnSim의 역운동학(IK) 모듈에 입력한다. OpEnSim은 33 자유도를 갖는 근골격 모델로, SMPL과 달리 관절 가동 범위가 해부학적 제약을 받는다. 예를 들어 무릎은 실제 인체와 같이 굴곡‑신전 하나만 자유롭게 움직이며, 나머지 회전 자유도는 굴곡 각도의 스플라인 함수로 제한된다. 이렇게 얻어진 관절 각도와 골반 위치는 물리적으로 타당한 궤적을 제공한다.

동역학 추정은 두 가지 경로를 제공한다. 첫 번째는 물리 기반 시뮬레이션으로, 토크‑구동 혹은 근육‑구동 모델을 사용해 지면 반력(GRF), 관절 모멘트, 근활성도를 역추정한다. 두 번째는 대규모 실험 데이터로 학습된 머신러닝 모델을 이용해 GRF를 직접 예측한다. 특히 보행 데이터에 대해 머신러닝 모델은 기존 두 카메라 기반 OpenCap 시스템과 동등하거나 더 나은 정확도를 보였다.

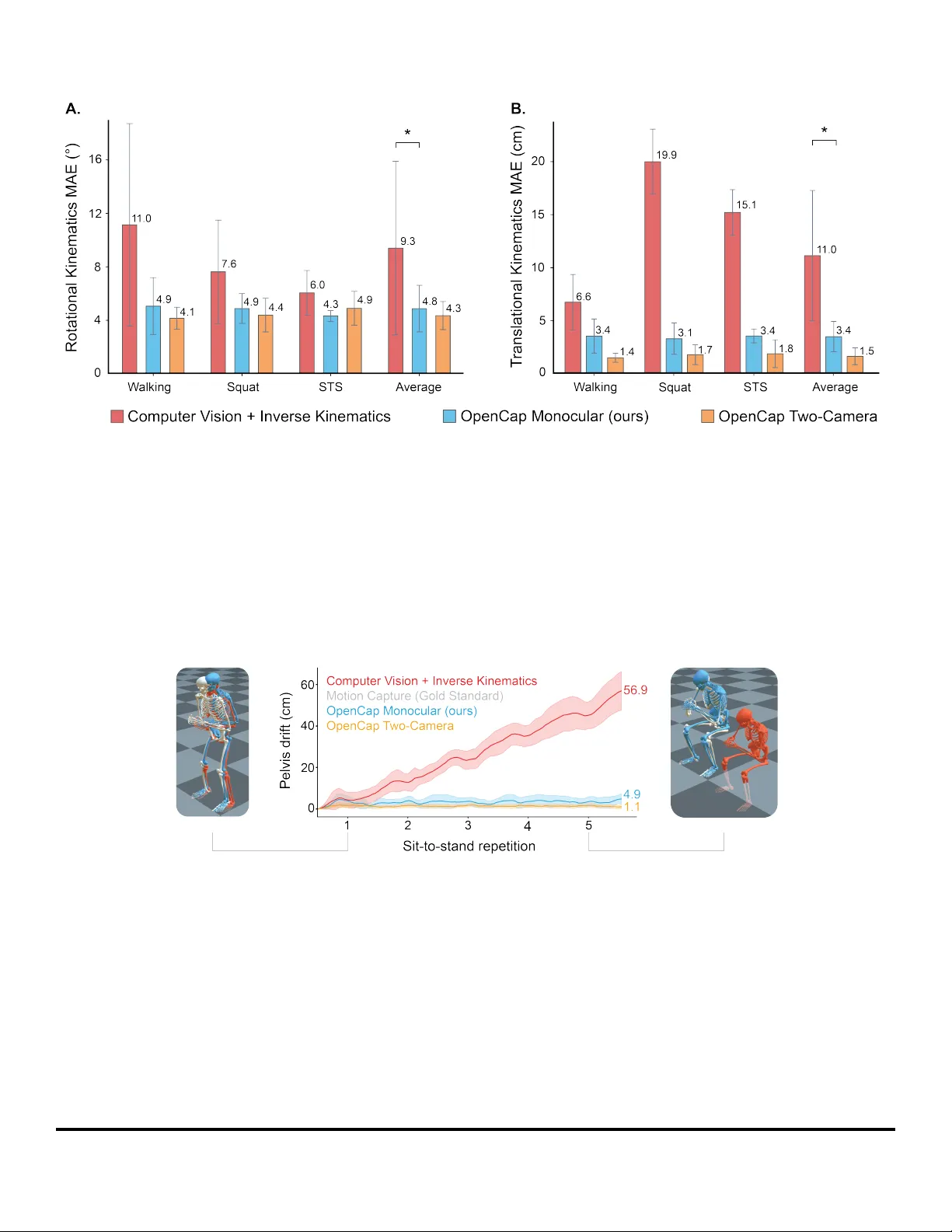

실험은 10명의 피험자를 대상으로 마커 기반 모션 캡처와 포스 플레이트를 이용해 보행, 스쿼트, 앉았다 일어서기(STS) 세 가지 동작을 수행하였다. OpenCap Monocular는 회전 자유도에 대해 평균 절대 오차(MAE) 4.8°, 골반 평행 이동에 대해 3.4 cm의 오차를 기록했으며, 이는 순수 컴퓨터 비전 모델(CV+IK) 대비 회전 정확도 48%, 이동 정확도 69% 향상된 결과다(p = 0.036, p < 0.001). 지면 반력 추정에서는 보행 중 평균 RMSE가 7–10 % BW 수준으로, 두 카메라 OpenCap과 비교해 차이가 없었다.

임상 적용 가능성을 검증하기 위해 두 가지 케이스 스터디를 수행했다. 첫 번째는 STS 동작에서 무릎 신전 모멘트를 추정해, 11 Nm 이하의 오차가 임상적으로 의미 있는 차이(프레일티와 비프레일티 구분)보다 작음을 확인했다. 두 번째는 보행 중 무릎 내전 모멘트를 추정해, 0.5 % BW·ht 이하의 오차가 무릎 골관절염 진행 예측에 사용되는 임계값보다 낮았다.

시스템 구현 측면에서, iOS 앱·웹 인터페이스·HIPAA‑준수 클라우드 백엔드가 제공된다. 사용자는 스마트폰을 삼각대에 고정하고 10 초 정도 촬영하면, 영상은 자동으로 클라우드에 업로드되고 2분 이내에 3‑D 자세와 동역학 결과가 반환된다. 결과는 웹 대시보드에서 시각화하거나 API를 통해 다운로드할 수 있다. 코드와 모델은 GitHub(https://github.com/utahmobl/opencap-monocular)에서 오픈소스로 제공돼 재현성과 확장성을 보장한다.

결론적으로, OpenCap Monocular는 (1) 단일 카메라 기반이면서 물리적 일관성을 유지하는 포즈 정제 알고리즘, (2) 해부학적 제약을 적용한 역운동학 파이프라인, (3) 물리 시뮬레이션과 머신러닝을 결합한 하이브리드 동역학 추정이라는 세 가지 기술적 혁신을 통해, 기존 고가·고복잡한 실험실 시스템에 필적하는 정확도를 달성했다. 이는 대규모 원격 연구, 재활 클리닉, 가정 기반 모니터링 등 다양한 현장에서 정밀한 움직임·힘 분석을 가능하게 하여, 인간 움직임 과학과 임상 치료에 새로운 패러다임을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기