다중 레벨 오일러 마루야마로 확산 모델 가속

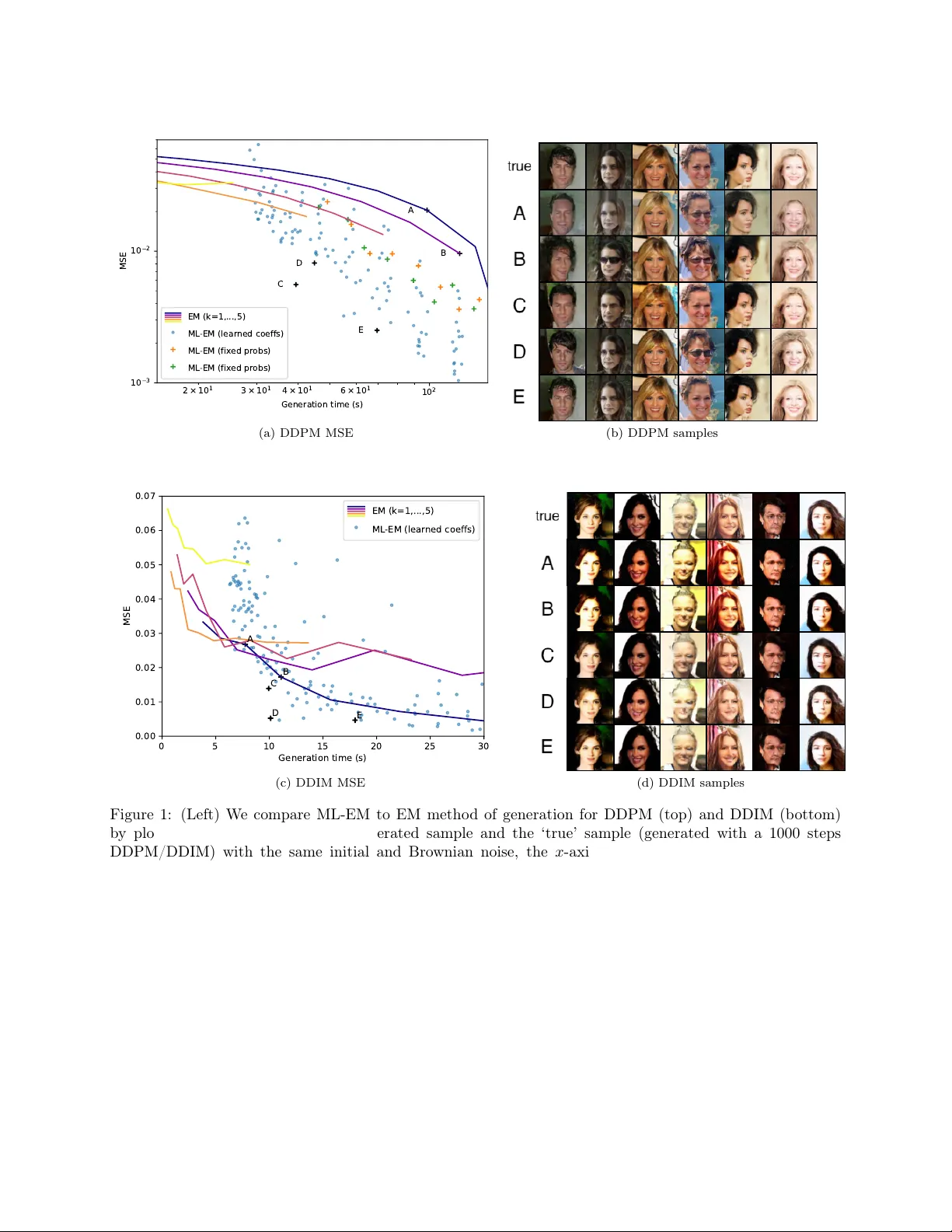

본 논문은 다중 레벨 오일러-마루야마(ML‑EM) 방법을 제안한다. 여러 크기의 UNet을 단계별로 확률적으로 선택해 drift를 근사함으로써, Harder‑than‑Monte‑Carlo(HTMC) 구간(γ>2)에서 전통적인 EM보다 한 차원 높은 ε⁻ᵞ 복잡도로 SDE/ODE 해를 얻는다. CelebA‑64 실험에서 최대 4배의 속도 향상을 확인했으며, 네트워크 규모가 커질수록 더 큰 다항식 가속이 기대된다.

저자: Arthur Jacot

본 논문은 확산 모델(Denoising Diffusion Probabilistic Models, DDPM)과 그 변형인 DDIM의 핵심 연산인 drift f (또는 score s) 를 여러 정확도‑비용 단계로 분해하고, 이를 다중 레벨 Euler‑Maruyama(ML‑EM) 프레임워크에 적용함으로써 연산 효율을 크게 개선하는 방법을 제시한다.

1. **배경 및 문제 정의**

- 확산 모델은 고차원 Gaussian 잡음에서 시작해 SDE dx_t = f_t(x_t)dt + σ_t dW_t 혹은 ODE dx_t = f_t(x_t)dt 로 데이터를 복원한다.

- drift f_t는 대규모 UNet으로 학습되며, 모델 크기 P가 커질수록 근사 오차 εₐₚₚᵣₒₓ≈c P⁻¹ᵞ 로 감소한다는 경험적 스케일링 법칙이 존재한다.

- 전통적인 Euler‑Maruyama(EM) 방법은 시간 단계 수 n≈ε⁻ᵠ와 drift f 의 비용 P≈ε⁻ᵞ 를 곱해 전체 복잡도가 ε⁻(γ+1) 가 된다. 이는 γ>2인 경우에도 여전히 “Monte‑Carlo보다 더 어려운” 영역에 머물러, 비용이 급격히 증가한다.

2. **핵심 가정: HTMC Regime**

- 논문은 drift f 가 Harder‑than‑Monte‑Carlo(HTMC) 구간에 있다고 가정한다. 즉, γ>2 로, drift f 를 ε‑정밀도로 근사하는 데 필요한 연산량이 ε⁻ᵞ 로 성장한다.

- 이 가정은 최근 DNN 스케일링 연구(예: Kaplan et al.)와 일치하며, 이미지 해상도가 커질수록 γ가 크게 증가한다는 실험적 증거가 있다.

3. **Multilevel Euler‑Maruyama (ML‑EM) 설계**

- 여러 수준 k=1,…,K 에 대해 drift 근사 f_k 을 정의한다. 각 f_k 는 정확도 2^{-k} 와 비용 C(f_k)≤c γ 2^{γk} 를 만족한다.

- 각 시간 단계에서 Bernoulli 변수 B_k∼Bernoulli(p_k) 를 샘플링해, 선택된 수준 k 에 대해 차분 f_k−f_{k-1} 을 적용한다.

- 확률 p_k는 지수적으로 감소하도록 설계(p_k≈C 2^{-(1+γ/2)k})하여, 대부분의 단계에서는 저비용 f_1 ~ f_{K-1} 을 사용하고, 고비용 f_K 는 매우 드물게 사용한다.

- 기대 연산량은

E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기