언어 기반 구조 인식 네트워크로 위장 객체 탐지 혁신

본 논문은 텍스트 프롬프트와 CLIP을 활용해 시각적 특징에 의미적 가이드를 제공하고, 고주파 에지 정보를 Fourier 변환으로 보강하는 FEEM, 구조‑경계 강조 SAAM, 그리고 전역‑국부 정제 CGLRM을 결합한 LGSAN을 제안한다. 다중 데이터셋 실험에서 기존 최첨단 방법들을 능가하며, 위장 객체 탐지에서 텍스트‑시각 융합과 주파수 도메인 활용의 효과를 입증한다.

저자: Min Zhang

Camouflaged Object Detection(COD)은 객체가 배경과 색·질감·구조적으로 거의 구분되지 않아 기존 객체 탐지나 Salient Object Detection보다 훨씬 어려운 문제이다. 기존 연구들은 다중 스케일 컨텍스트, 바이오‑인스파이어드 메커니즘, 다중 소스 융합, 멀티‑태스크 학습 등 네 가지 전략으로 성능을 끌어올렸지만, 텍스트 기반 의미 프라이어를 활용한 접근은 거의 없었다. 본 논문은 이러한 공백을 메우기 위해 Language‑Guided Structure‑Aware Network(LGSAN)를 제안한다.

LGSAN의 핵심은 다섯 개 모듈로 구성된다. 첫 번째는 PVT‑v2‑b3 백본으로 이미지에서 4단계 피처 {Fᵢ}를 추출한다. 두 번째는 사전 학습된 CLIP 모델을 이용해 텍스트 프롬프트(예: “a photo of a camouflaged owl”)와 이미지 자체를 동시에 인코딩한다. 텍스트 인코더는 의미 임베딩을, 비주얼 인코더는 8, 16, 24번째 레이어의 피처를 추출한다. 이 두 정보를 FPN을 통해 정렬·융합한 뒤, 텍스트‑가이드 디코더에 입력해 초기 마스크 M₁을 만든다. M₁은 MGFA 연산을 통해 PVT‑v2 피처와 CLIP 비주얼 피처 Attₙ에 곱해져, 모델이 잠재적인 위장 영역에 집중하도록 만든다.

세 번째 모듈인 Fourier Edge Enhancement Module(FEEM)은 고주파 에지 정보를 보강한다. 최고 레벨 피처 f₄와 Attₙ을 채널 압축 후, 단계별 업샘플·컨케이션을 거쳐 EdgeEnhancer에 전달한다. EdgeEnhancer는 평균 풀링 차이를 이용해 에지 가중 맵을 생성하고, 이를 residual 방식으로 원본 피처에 더한다. 이어서 FFT를 적용해 고주파 성분을 추출하고 ReLU로 활성화해 최종 에지 강화 피처 E를 만든다. 이 과정은 공간 도메인과 주파수 도메인을 동시에 활용해 경계 대비를 크게 향상시킨다.

네 번째 모듈인 Structure‑Aware Attention Module(SAAM)은 어텐션 메커니즘에 의미와 에지 정보를 주입한다. 입력 피처 x에 대해 Q, K, V를 추출하고, Q에 의미 마스크 M을, K에 에지 피처 E를 element‑wise 곱한다. 이렇게 가공된 Q·K·V는 소프트맥스 기반 근사 어텐션으로 연산돼, 구조와 경계 정보를 동시에 강조하는 출력 피처를 만든다. 어텐션 연산을 토큰 형태로 변환하고 전치함으로써 메모리 사용을 최소화한다.

다섯 번째 모듈인 Coarse‑Guided Local Refinement Module(CGLRM)은 전역‑국부 정합을 담당한다. 입력 피처에 채널 어텐션과 공간 어텐션을 적용해 전역 가이드 g를 만든 뒤, 피처를 4개의 비중첩 서브‑리전으로 분할한다. 각 서브‑리전은 g에 의해 가중된 채로 로컬 컨볼루션을 거쳐 정제되며, 이렇게 얻어진 로컬 피처는 다시 전역 피처와 결합돼 최종 camᵢ를 생성한다. 이 구조는 전체적인 일관성을 유지하면서도 미세한 경계와 구조를 복원한다.

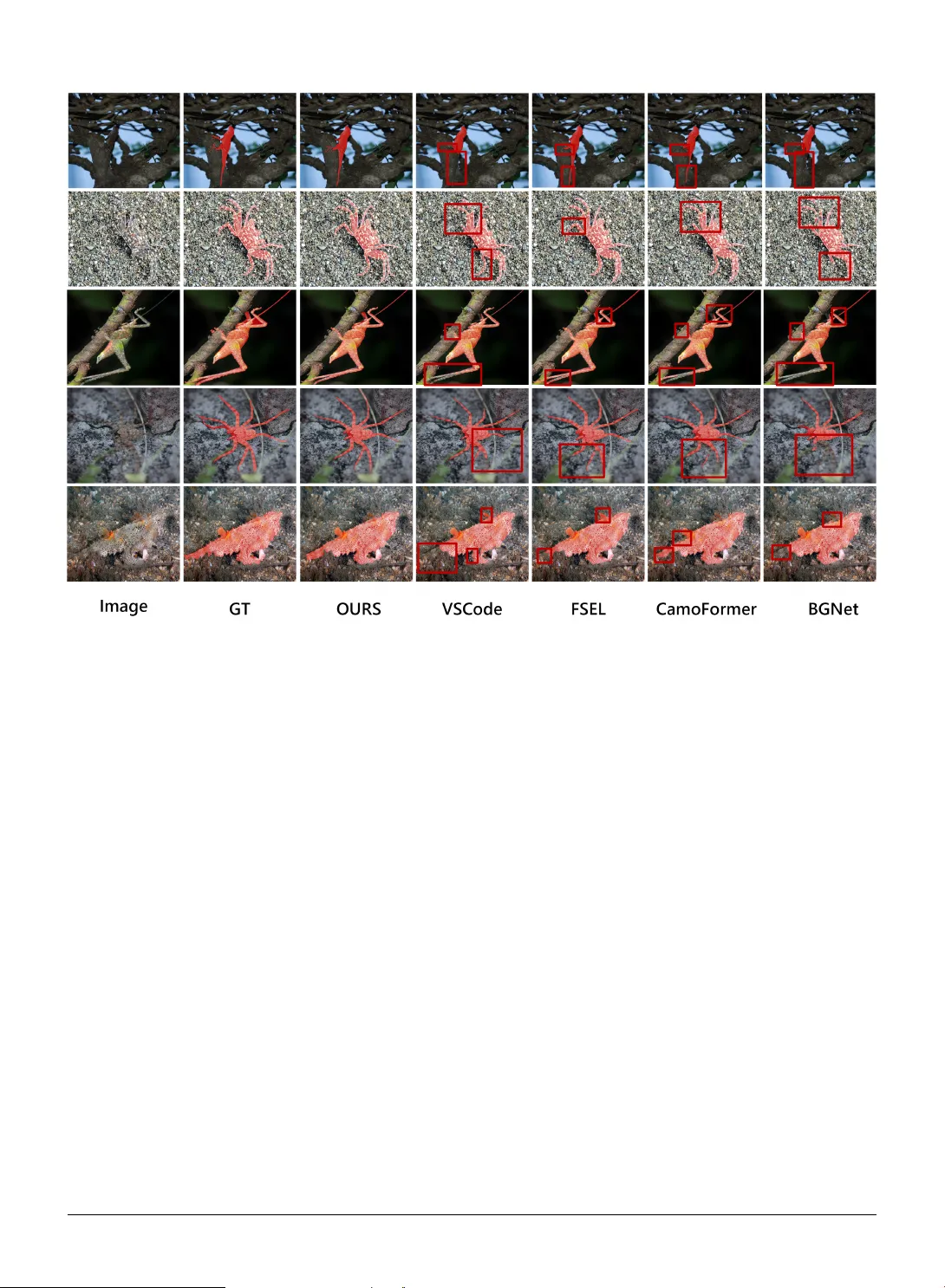

전체 파이프라인은 최종적으로 다중 스케일 예측 맵 O₁~O₄, 에지 예측 Oₑ, 텍스트‑가이드 마스크 M₁을 출력한다. 실험에서는 COD10K, CAMO, CHAMELEON, COD10K‑Test, NC4K 등 5개 데이터셋에서 F‑measure, MAE, E‑measure 등 다양한 지표로 평가했으며, 기존 SOTA 모델(HCM, CamoFormer, FEMNet 등)을 모두 능가했다. 특히 CLIP 가이드가 없는 베이스라인 대비 평균 3~5%의 성능 향상이 확인되었다. Ablation study는 각 모듈(텍스트‑가이드, FEEM, SAAM, CGLRM)의 독립적인 기여도를 입증한다.

한계점으로는 CLIP 모델을 고정(frozen) 상태로 사용해 도메인‑특화 텍스트 프롬프트에 대한 적응력이 제한적이며, 고해상도 이미지에서 FFT 연산이 메모리와 연산량을 증가시킬 수 있다는 점을 언급한다. 향후 연구에서는 경량화된 주파수 변환 모듈과 프롬프트 자동 생성 기법을 도입해 실시간 적용 가능성을 탐색할 수 있다.

결론적으로 LGSAN은 텍스트‑시각 융합, 주파수 기반 에지 강화, 구조‑경계 지향 어텐션, 전역‑국부 정제라는 네 가지 혁신적 요소를 결합해 위장 객체 탐지 분야에 새로운 패러다임을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기