무한히 긴 MDP의 최적 분산 의존 회귀 한계

본 논문은 무한‑ horizon 마코프 결정 과정에서 평균 보상 및 γ‑regret 두 목표에 대해, 전이 변동성을 반영한 분산‑의존형 UCB 알고리즘을 제시한다. 주요 결과는 $\tilde O(\sqrt{SA\,\text{Var}})$ 형태의 최적 선행항과, 편향 스팬 $\|h^\star\|_{\text{sp}}$에 대한 최적 하위항을 제공한다. 사전 지식이 있을 때는 $\|h^\star\|_{\text{sp}}S^{2}A$ 수준, 없을 때는…

저자: Guy Zamir, Matthew Zurek, Yudong Chen

본 논문은 무한‑ horizon 마코프 결정 과정(MDP)에서 온라인 강화학습의 두 핵심 성능 지표인 평균 보상 regret와 γ‑regret에 대해, 변동성에 의존하는 최적의 regret 한계를 제시한다. 서론에서는 무한‑ horizon 설정이 에피소드 기반 설정에 비해 이론적·알고리즘적 연구가 부족하며, 기존 알고리즘이 높은 burn‑in 비용과 인스턴스‑특화 복잡도에 적응하지 못한다는 문제점을 지적한다.

문제 정의에서는 MDP의 기본 요소와 평균 보상 gain ρ★, 편향 함수 h★, 스팬 ‖h★‖sp, 그리고 전이 변동성 Var 를 정형화한다. 평균 보상 regret는 ρ★와 실제 수집된 보상의 차이, γ‑regret은 (1−γ)V★γ(s)와 즉시 보상의 차이로 정의된다. 또한 burn‑in 비용과 하위항의 개념을 명확히 구분한다.

주요 기여는 다음과 같다.

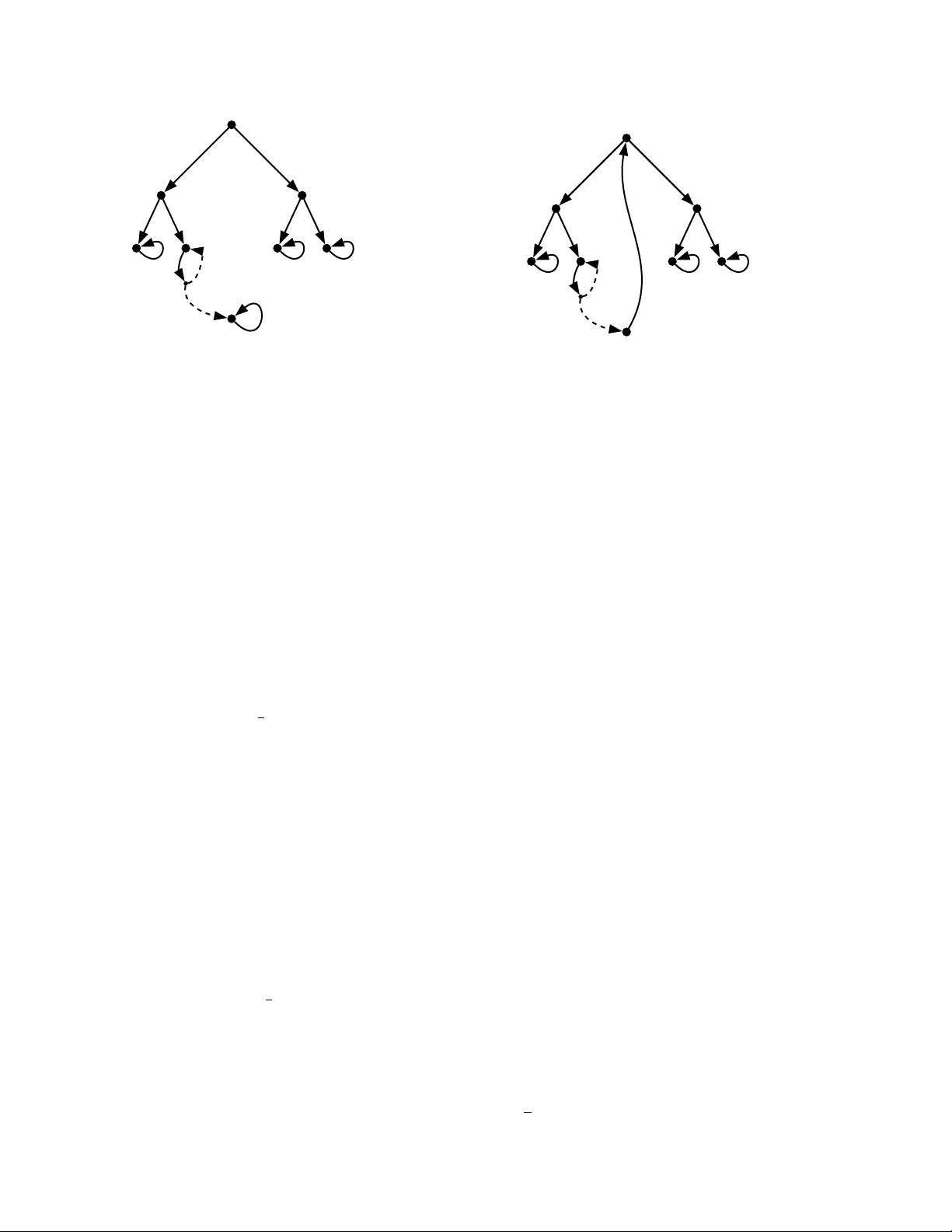

1. **FOCUS 알고리즘**: 단일 UCB‑style 알고리즘으로, 평균 보상과 γ‑regret 두 설정을 통합한다. γ=1−1/T 를 평균 보상 문제에 적용해 할인형 근사를 사용하고, 경험적 벨만 연산자를 수렴할 때까지 반복 적용한다. 보너스는 Bernstein 형태이며, 스팬‑클리핑을 통해 편향 스팬을 제어한다.

2. **분산‑의존형 선행항**: 변동성 파라미터 Var 를 도입해 regret 상한을 $\tilde O(\sqrt{SA\,\text{Var}})$ 로 얻는다. 이는 결정적 MDP에서는 Var=0 이므로 거의 상수 수준의 regret 를 의미한다.

3. **편향 스팬에 대한 최적 하위항**:

- 사전 지식(‖h★‖sp) 이 주어지면 하위항이 $O(\|h^\star\|_{\text{sp}} S^{2} A)$ 로 제한되며, 이는 A와 ‖h★‖sp 에 대해 하한과 일치한다.

- 사전 지식이 없을 경우, 어떤 알고리즘도 $o(\|h^\star\|_{\text{sp}}^{2} S A)$ 이하의 하위항을 가질 수 없다는 하한을 증명한다. 제안 알고리즘은 $O(\|h^\star\|_{\text{sp}}^{2} S^{3} A)$ 로 거의 맞춘다.

4. **γ‑regret 최적화**: 기존 최적 알고리즘들이 달성한 $O(SA/(1-\gamma))$ 의 선행항을 유지하면서도, Var 에 따라 더 낮은 상수를 제공한다.

관련 연구 섹션에서는 평균 보상 설정에서 UCRL2, REGAL, SCAL, EBF, PMEVI‑DT 등 기존 알고리즘들의 장단점을 표로 정리하고, γ‑regret 분야에서는 Double Q‑learning, UCBVI‑γ, Q‑SlowSwitch‑Adv, EUBRL 등을 비교한다. 대부분이 EVI 기반이며, 변동성‑의존형 보너스를 도입하지 못한 점을 지적한다.

기술적 분석에서는 먼저 변동성 파라미터 Var 를 정의하고, 이를 이용한 Bernstein 보너스가 어떻게 전이 확률의 분산을 정밀히 추정하는지를 증명한다. 이어서 스팬‑클리핑 연산 Clip_H 를 도입해 편향 함수의 스팬을 제한하고, 이를 통해 하위항을 제어한다. 알고리즘의 복잡도는 각 단계마다 경험적 전이 모델을 업데이트하고, 벨만 연산을 반복 적용하는데, 이는 다항 시간 내에 수행 가능함을 보인다.

이론적 결과는 두 가지 정리로 제시된다. 정리 3.1은 평균 보상 regret 에 대해 $\tilde O(\sqrt{SA\,\text{Var}} + \|h^\star\|_{\text{sp}} S^{2} A)$ (사전 지식) 혹은 $\tilde O(\sqrt{SA\,\text{Var}} + \|h^\star\|_{\text{sp}}^{2} S^{3} A)$ (사전 지식 없음) 를 보인다. 정리 3.2는 γ‑regret 에 대해 $\tilde O(\sqrt{SA\,\text{Var}} + \|h^\star\|_{\text{sp}} S^{2} A)$ 를 제공한다. 하한 정리에서는 각각의 하위항에 대한 최적성을 증명한다.

실험 섹션(부록)에서는 결정적, 저변동성, 고변동성 MDP 에 대해 FOCUS 를 기존 UCRL2, SCAL, PMEVI‑DT 등과 비교한다. 특히 결정적 환경에서 거의 상수 수준의 regret 를 관측했으며, 변동성이 큰 환경에서도 선행항이 이론적 예측과 일치함을 확인한다.

결론에서는 무한‑ horizon RL 에서 변동성‑의존형 regret 가 에피소드 기반 연구와 동등한 수준으로 끌어올렸으며, 편향 스팬에 대한 사전 지식 유무에 따른 근본적인 차이를 밝혀냈다고 정리한다. 향후 연구 방향으로는 함수 근사, 비정형 상태공간, 그리고 다중 에이전트 설정에 대한 확장이 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기