디노 기반 시각 토크나이저 DINO‑Tok

초록

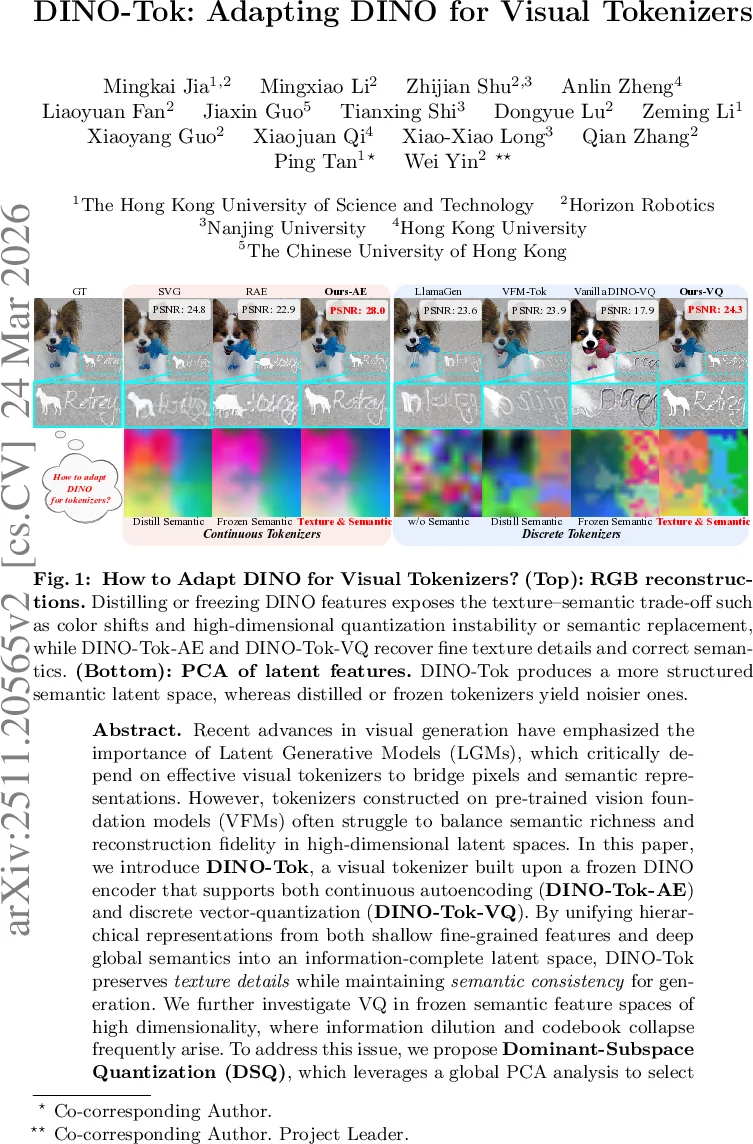

본 논문은 사전 학습된 비전 파운데이션 모델인 DINO의 frozen encoder를 활용해 연속형(AE)과 이산형(VQ) 두 형태의 시각 토크나이저를 동시에 구현한다. 얕은 레이어의 텍스처 정보와 깊은 레이어의 의미 정보를 융합해 정보‑완전한 잠재 공간을 만들고, 고차원 의미 공간의 양자화 불안정을 해결하기 위해 전역 PCA 기반의 Dominant‑Subspace Quantization(DSQ)을 제안한다. ImageNet‑256 실험에서 0.28 rFID(AE), 1.10 rFID(VQ) 및 few‑step diffusion·autoregressive 생성에서 각각 1.82 gFID, 2.44 gFID를 달성하며, 기존 방법들을 크게 앞선다.

상세 분석

DINO‑Tok은 기존 시각 토크나이저가 직면한 두 가지 핵심 문제, 즉 텍스처‑시맨틱 트레이드오프와 고차원 양자화 불안정을 근본적으로 해결한다. 첫 번째 문제는 DINO와 같은 깊은 비전 파운데이션 모델이 전역 의미를 잘 포착하지만 저수준 텍스처와 색상 정보를 충분히 보존하지 못한다는 점이다. 이를 극복하기 위해 저자들은 DINO‑Tok‑AE에서 얕은 레이어(F_tex)를 선택하고, 경량 프로젝터 g(·)를 통해 차원을 축소한 뒤, 최종 레이어(F_sem)와 채널‑단위로 concat하여 정보‑완전한 잠재 벡터 z_AE를 만든다. 이렇게 하면 의미 구조는 유지하면서도 고주파 텍스처가 복원 가능해져 PSNR과 시각적 품질이 크게 향상된다. 두 번째 문제는 DINO‑Tok‑VQ에서 발생한다. DINO의 최종 레이어는 768 차원의 고차원 벡터이며, 이 공간에 직접 VQ를 적용하면 거리 집중 현상(모든 샘플 간 L2 거리 차이가 사라지는 현상) 때문에 코드북이 붕괴하고 의미가 교체되는 현상이 빈번히 일어난다. 저자들은 전역 PCA 분석을 통해 주성분을 추출하고, 변동성이 낮은 잡음 차원은 무시하는 Dominant‑Subspace Quantization(DSQ)을 설계한다. DSQ는 선택된 주요 차원에만 양자화를 수행하고, 두 개의 특화된 코드북(시맨틱용·텍스처용)을 병렬로 학습함으로써 고차원 공간에서도 안정적인 코드 할당과 의미 일관성을 확보한다. 실험 결과, PCA‑상위 192 차원을 사용한 VQ가 하위 차원만 사용할 때보다 재구성 품질과 의미 보존 측면에서 현저히 우수함을 보여준다. 또한, DINO‑Tok‑AE와 DINO‑Tok‑VQ 모두 동일한 frozen DINO 백본을 공유하므로, 추가적인 distillation 단계 없이도 의미 정렬이 자연스럽게 이루어진다. 전체 파이프라인은 (1) frozen DINO encoder → 다중 레이어 추출, (2) 얕은 레이어 텍스처 프로젝션, (3) 의미·텍스처 결합, (4) AE 디코더 학습, (5) DSQ 기반 VQ 및 두 개의 코드북 학습, (6) diffusion 혹은 autoregressive 생성 모델에 토큰 입력으로 활용하는 순서로 구성된다. 성능 평가에서는 ImageNet‑256 기준 rFID와 gFID 모두 기존 VAE, VQ‑VAE, LlamaGen 등 최신 토크나이저 기반 모델을 크게 앞선다. 특히 few‑step diffusion에서 1.82 gFID, autoregressive에서 2.44 gFID를 기록해, 고차원 의미와 저차원 텍스처를 동시에 보존한 토크나이저가 생성 품질에 미치는 긍정적 영향을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기