긴 서브시퀀스를 위한 Manta: Mamba 기반 소수샷 행동 인식 강화

초록

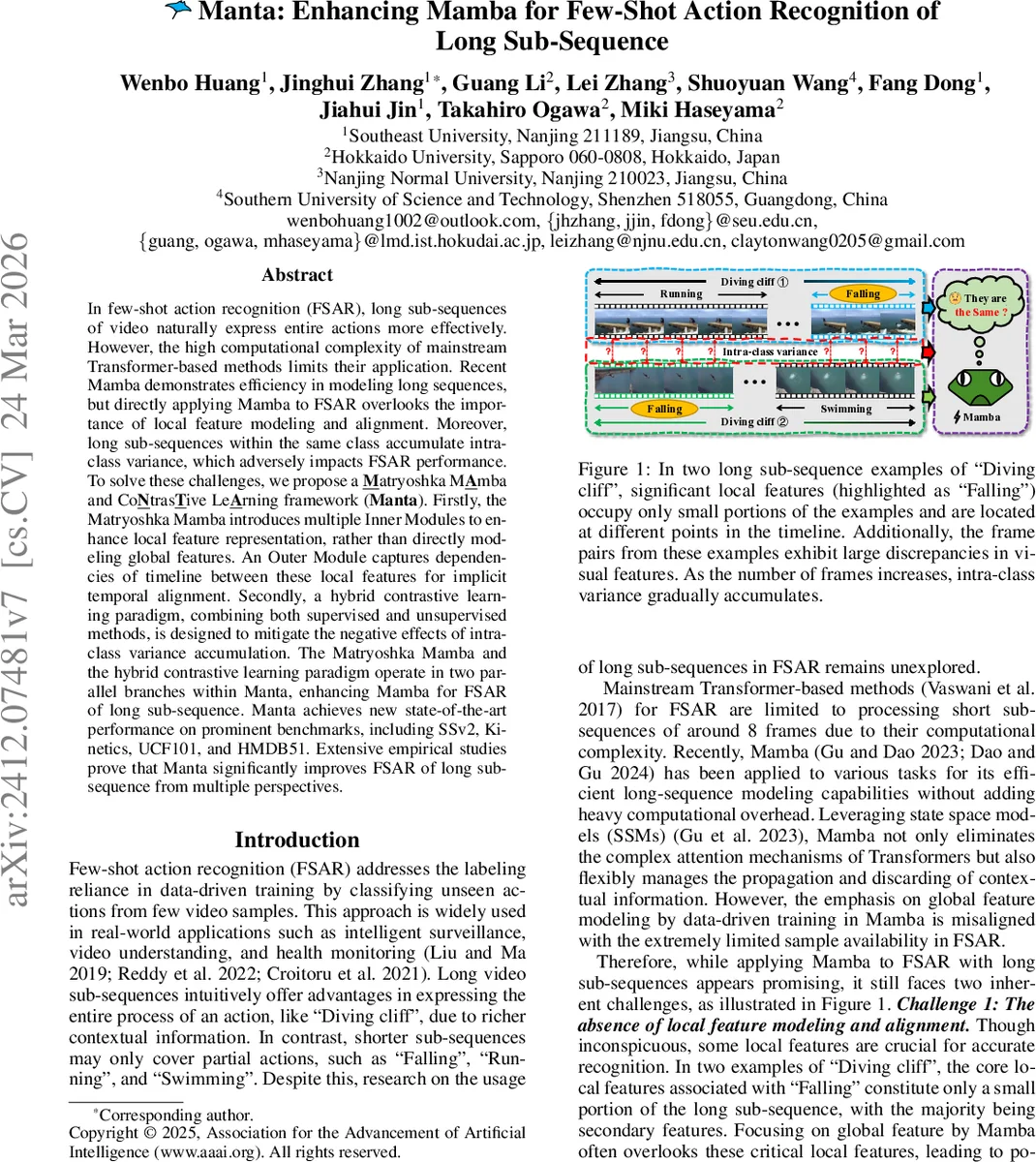

Manta는 긴 비디오 서브시퀀스를 효율적으로 처리하도록 설계된 Matryoshka Mamba와 하이브리드 대조 학습을 결합한 프레임워크이다. 다중 내부 모듈을 통해 지역 특징을 강화하고, 외부 모듈이 시간적 의존성을 포착해 암시적 정렬을 수행한다. 감독·비감독 대조 학습을 동시에 적용해 클래스 내 변동성을 완화함으로써 SSv2, Kinetics, UCF101, HMDB51 등에서 최첨단 성능을 달성한다.

상세 분석

본 논문은 소수샷 행동 인식(FSAR)에서 긴 서브시퀀스가 제공하는 풍부한 컨텍스트를 활용하면서도 계산 효율성을 유지하는 방법을 제시한다. 핵심 아이디어는 두 단계로 나뉜 Matryoshka Mamba 구조이다. 첫 번째 단계인 Inner Module은 입력 시퀀스를 비중첩 프래그먼트로 분할하고, 각 프래그먼트에 대해 Mamba‑2 기반의 전방·후방 SSM(상태공간 모델) 경로를 별도로 학습한다. 이를 통해 지역적인 움직임 패턴—예를 들어 ‘낙하’와 같은 짧은 핵심 동작—을 세밀하게 포착한다. 두 번째 단계인 Outer Module은 모든 프래그먼트에서 추출된 지역 특징을 다시 한 번 양방향 스캔하여 시간축 상의 의존성을 모델링한다. 외부 모듈은 Conv2D 블록과 시그모이드 가중치를 이용해 각 스케일별 출력을 가중 평균하고, 최종적으로 다중 스케일(프레임 수 o∈O) 결과를 평균해 전역 특징 ˆS와 ˆQ를 만든다.

시간 정렬 측면에서는 기존 Transformer 기반 방법이 DTW 등 명시적 정렬에 의존하는 반면, Manta는 Outer Module의 양방향 SSM이 암시적으로 정렬을 수행하도록 설계되었다. 이는 긴 시퀀스에서도 계산량을 O(F·D) 수준으로 유지하면서도, 지역 특징이 서로 다른 시점에 나타나는 문제를 완화한다.

두 번째 기여는 하이브리드 대조 학습이다. 지원 집합(S)에는 라벨이 있는 K‑shot 샘플이, 질의 집합(Q)에는 라벨이 없는 샘플이 존재한다. 논문은 감독 대조 손실(Lsup)과 비감독 대조 손실(Lunsup)을 동시에 최적화한다. 감독 대조는 동일 클래스 내 지원 샘플 간의 양성을 강화하고, 비감독 대조는 질의와 지원을 포함한 전체 배치를 이용해 전체적인 클러스터링을 촉진한다. 최종 손실 Ltotal = λ·Lce + (1‑λ)·Lhc 로, 여기서 Lce는 프로토타입 기반 교차 엔트로피, Lhc는 위의 하이브리드 대조 손실이다.

실험에서는 3‑way‑3‑shot 설정을 기준으로 SSv2‑FewShot, Kinetics‑FewShot, UCF101‑FewShot, HMDB51‑FewShot 네 가지 벤치마크에서 기존 최첨단 모델(OTAM, TRX, SloshNet 등)을 크게 앞선 정확도를 기록했다. 특히 프레임 수를 8→32로 늘렸을 때 성능 저하가 거의 없으며, 이는 Matryoshka Mamba가 긴 시퀀스에서도 지역·전역 정보를 균형 있게 유지한다는 증거이다. Ablation study에서는 Inner Module만, Outer Module만, 대조 학습만 적용했을 때 각각의 성능 감소를 확인함으로써 제안된 두 구성 요소가 상호 보완적임을 입증한다.

요약하면, Manta는 (1) 다중 스케일·양방향 SSM 기반의 지역·전역 특징 통합, (2) 암시적 시간 정렬, (3) 감독·비감독 대조 학습을 결합해 긴 서브시퀀스 기반 FSAR의 핵심 과제인 지역 특징 소실과 클래스 내 변동성 축적을 동시에 해결한다.

댓글 및 학술 토론

Loading comments...

의견 남기기