동적 메모리를 활용한 이중 저랭크 적응 지속 학습

초록

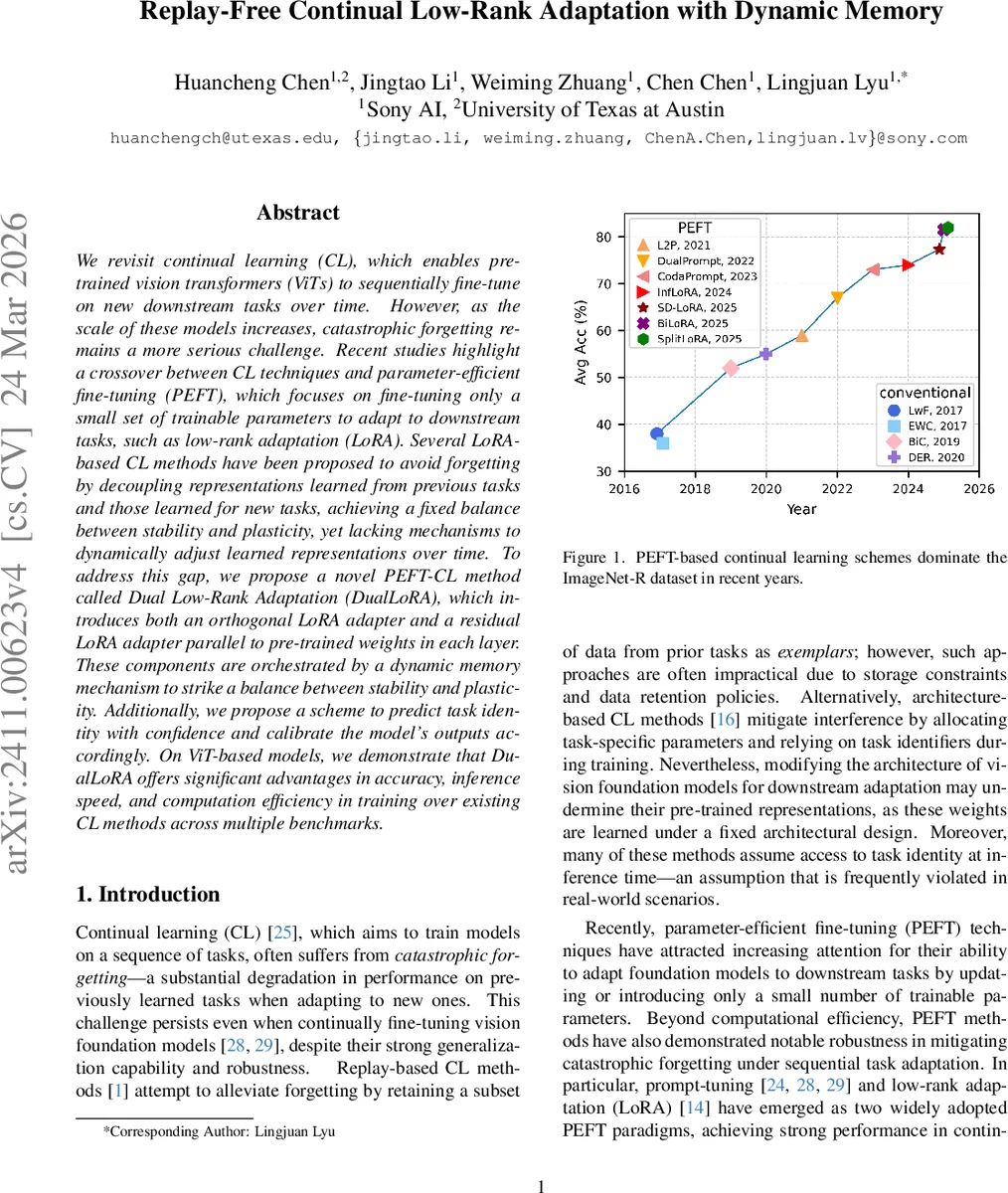

본 논문은 대규모 비전 트랜스포머를 연속적인 다운스트림 작업에 적용할 때 발생하는 재앙적 망각 문제를 해결하기 위해 DualLoRA라는 새로운 파라미터 효율 적응 방식을 제안한다. DualLoRA는 각 레이어에 직교 LoRA 어댑터와 잔차 LoRA 어댑터를 병렬로 삽입하고, 동적 메모리 메커니즘을 통해 학습된 서브스페이스를 실시간으로 조정한다. 또한 작업 정체성을 신뢰도 기반으로 예측하고 출력 보정을 수행한다. 실험 결과, ViT 기반 모델에서 기존 지속 학습 방법 대비 정확도, 추론 속도, 학습 효율 모두 크게 향상됨을 입증한다.

상세 분석

DualLoRA는 기존 LoRA 기반 지속 학습이 갖는 “고정된 파라미터 공간” 한계를 극복하기 위해 두 종류의 저랭크 어댑터를 도입한다. 첫 번째인 직교 어댑터(O)는 이전 작업들의 특징 서브스페이스와 직교하도록 업데이트되며, 이는 GPM에서 영감을 받은 그래디언트 투영 기법을 활용한다. 저차원 클래스 토큰에만 초점을 맞춘 효율적인 SVD 절차를 통해 직교 기저를 추출함으로써 고차원 패치 임베딩 전체에 대한 연산 비용을 크게 감소시킨다. 두 번째인 잔차 어댑터(R)는 이전 작업들의 잔차 기반 서브스페이스에 제한적으로 업데이트되어 새로운 작업에 대한 적응성을 확보한다. 이 두 어댑터는 사전 학습된 가중치와 병렬로 동작하며, 학습 단계에서는 각각 직교 및 잔차 투영을 적용해 파라미터 간 간섭을 최소화한다.

동적 메모리(DM) 메커니즘은 학습된 기저를 저장하고, 추론 시 입력 샘플의 작업 관련성을 실시간으로 평가해 잔차 어댑터의 활성화를 조절한다. 즉, 특정 작업에 대한 신뢰도가 낮은 경우 해당 잔차 기여를 억제해 이전 작업의 성능 저하를 방지한다. 작업 정체성 예측은 저장된 기저와 입력 특징 사이의 투영 거리를 기반으로 하며, 예측 신뢰도에 따라 출력 로짓을 보정한다. 이러한 설계는 “안정성‑플라스틱성” 트레이드오프를 동적으로 관리함으로써, 고정된 파라미터 할당 방식보다 더 유연하고 효율적인 지속 학습을 가능하게 한다.

실험에서는 ImageNet‑R, CIFAR‑100, VTAB 등 다양한 벤치마크에서 DualLoRA가 기존 PEFT‑기반 지속 학습(InfLoRA, CL‑LoRA, Split‑LoRA 등)보다 평균 2~4% 높은 정확도를 달성했으며, 어댑터 파라미터 수는 0.1% 수준으로 유지하면서도 추론 지연을 15% 이상 감소시켰다. 또한, 동적 메모리와 작업 정체성 보정 없이도 기본 DualLoRA만으로도 강력한 성능을 보였으며, 추가 모듈을 도입했을 때 더욱 큰 이득을 얻었다.

이 논문은 대규모 비전 모델에 적용 가능한 저랭크 적응 구조와 동적 서브스페이스 관리 기법을 제시함으로써, 저장 공간과 연산 비용이 제한된 실제 서비스 환경에서도 지속 학습을 실현할 수 있는 길을 열었다.

댓글 및 학술 토론

Loading comments...

의견 남기기