실시간 통화용 고품질 토킹헤드 비디오 데이터셋 공개

본 논문은 805명의 참여자와 446종의 소비자 웹캠으로 촬영한 847개의 15초 길이 토킹헤드 영상을 FFV1 무손실 코덱으로 저장한 ‘near‑raw’ 데이터셋을 공개한다. 각 영상은 MOS와 10가지 인지 품질 토큰으로 주관적 품질을 라벨링했으며, 원본·배경 흐림·배경 교체 3가지 조건으로 구성된 120클립 벤치마크 서브셋을 제공한다. 또한 H.264, H.265, H.266, AV1 네 코덱에 대한 VMAF 기반 BD‑rate 실험을 수…

저자: Babak Naderi, Ross Cutler

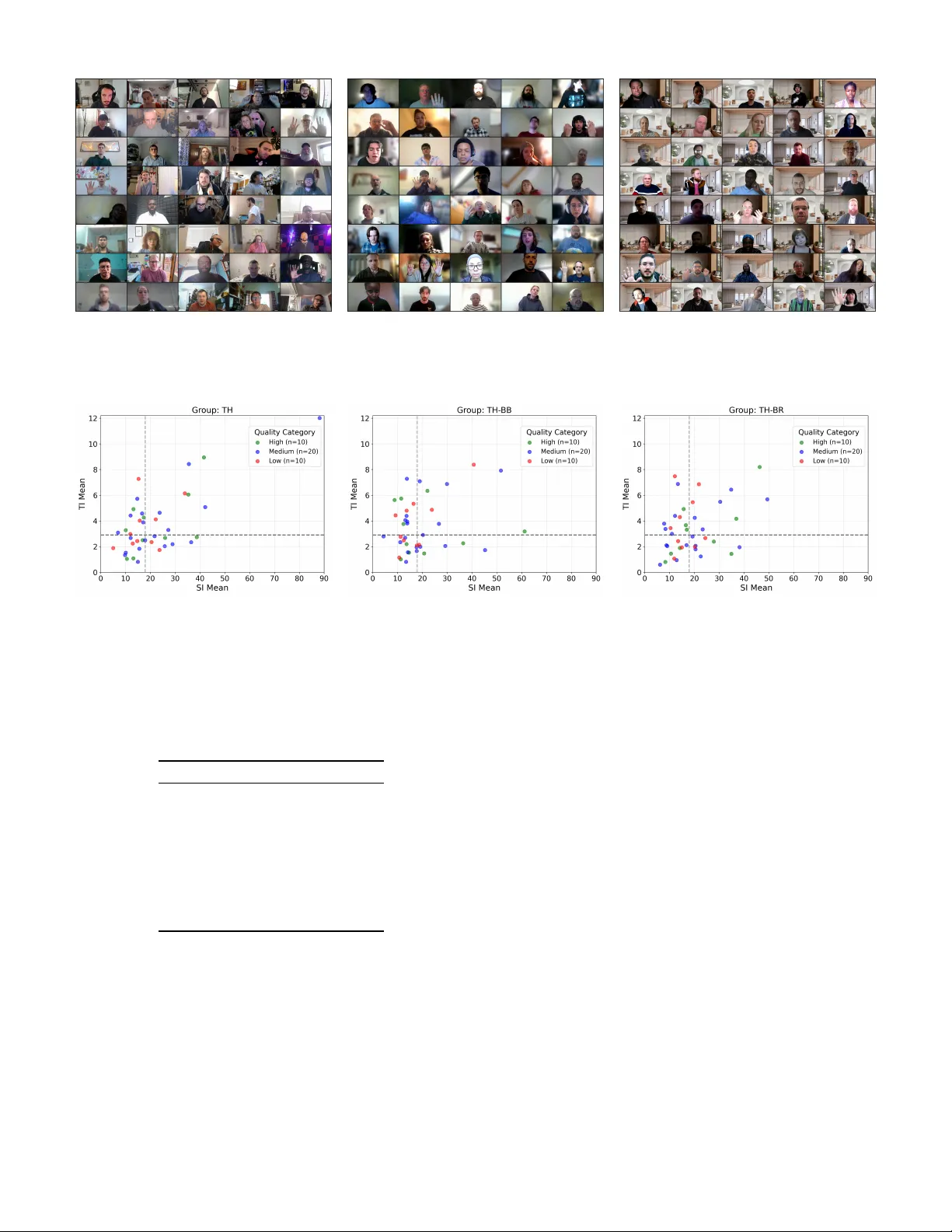

본 논문은 실시간 화상회의(RTC)에서 가장 흔히 사용되는 토킹헤드 영상을 대상으로, 고품질·대규모·무손실 데이터셋을 구축하고 이를 공개함으로써 영상 처리 및 압축 연구에 필요한 근본적인 레퍼런스를 제공한다. 데이터 수집은 805명의 자원봉사자를 모집해, 446종의 소비자 웹캠(내장·외장 모두 포함)으로 각 참가자가 자신의 자연스러운 환경(거실, 홈오피스 등)에서 20초 영상을 촬영하도록 설계되었다. 캡처 애플리케이션은 DirectShow와 FFmpeg을 이용해 카메라가 지원하는 최대 해상도와 최고 품질 픽셀 포맷을 그대로 추출하고, 프레임 타임스탬프를 보존한 채 FFV1 무손실 코덱으로 저장한다. 이 과정에서 카메라 펌웨어가 수행하는 디모자이킹·화이트밸런스·감마 보정은 허용하지만, 이후 어떠한 손실 압축도 가하지 않아 ‘near‑raw’라는 개념을 도입한다. 최종적으로 1,119개의 원본 영상을 수집했으며, 품질·프레임레이트·프레임 손실 등 기술적 결함을 기준으로 272개를 제외하고 847개의 클립을 공개한다.

영상은 15초 길이이며, 해상도는 720p(≈60 %), 1080p(≈33 %), 1440p 이상(≈6 %)로 분포한다. 픽셀 포맷은 비압축(YUYV 422, NV12) 24.4 %와 MJPEG 75.6 %가 혼합돼 있다. MJPEG은 카메라 펌웨어가 내부적으로 고품질 JPEG 압축을 수행한 것이며, 이를 디코딩 후 무손실 저장함으로써 카메라 자체 압축 품질을 그대로 보존한다.

품질 라벨링은 두 단계로 진행된다. 첫 번째는 ITU‑T P.910 ACR 방식을 적용해 216명의 크라우드 워커가 각 클립에 대해 5점 척도 MOS를 부여했으며, 평균 7표본을 확보해 신뢰성을 확보했다. 두 번째는 10가지 인지 품질 토큰을 정의해 다중 라벨링을 수행했다. 토큰 선정 과정은 (1) 자유 서술형 코멘트를 LLM·키워드 분석으로 집계해 후보 토큰을 도출, (2) 200클립에 대해 24명의 워커가 검증, (3) 전체 1,119클립에 대해 112명의 워커가 라벨링하는 3단계 절차를 거쳤다. 토큰은 ‘노이즈’, ‘저해상도’, ‘조명·색상’, ‘흐림’, ‘끊김’, ‘프레임레이트’, ‘밴딩’, ‘기타’, ‘무이슈’, ‘블록성’으로 구성되며, 선택 비율은 노이즈 69.8 %, 저해상도 61.3 % 등으로 나타났다. MOS와 토큰 선택 비율 간의 피어슨 상관계수는 0.859(전체)·0.893(공통 200클립)로 높으며, 다중 회귀 분석 결과 토큰 조합이 MOS 변동의 64.4 %를 설명한다.

벤치마크 서브셋은 전체 847클립 중 120클립을 층화 샘플링하여 선정했다. 각 클립은 10초로 트리밍하고, 원본(TH), 배경 흐림(TH‑BB), 배경 교체(TH‑BR) 3가지 콘텐츠 조건으로 40클립씩 배치했다. 배경 흐림·교체는 실제 화상회의에서 흔히 사용되는 실시간 배경 처리 파이프라인을 적용해, 콘텐츠 변형이 압축 효율에 미치는 영향을 정량화한다.

코덱 효율성 평가는 H.264(AVC), H.265(HEVC), H.266(VVC), AV1 네 코덱을 동일 설정으로 인코딩하고, VMAF 기반 BD‑rate를 계산했다. 실험 결과 H.266이 H.264 대비 최대 ‑71.3 %의 비트레이트 절감 효과를 보였으며, 코덱 × 데이터셋(ηp² = 0.112) 및 코덱 × 콘텐츠 조건(ηp² = 0.149) 상호작용이 통계적으로 유의했다. 이는 배경 흐림·교체와 같은 전처리 단계가 압축 효율에 실질적인 영향을 미친다는 것을 입증한다.

본 데이터셋은 기존 토킹헤드 데이터(예: VoxCeleb, HDTF, CelebV‑HQ 등)가 웹 플랫폼 압축에 의존하거나 배경을 제거한 반면, 실제 웹캠 센서 노이즈·자동 노출·조명 변동을 그대로 보존한다는 점에서 차별화된다. 또한 규모면에서 가장 큰 공개 토킹헤드 웹캠 데이터(160클립)보다 5배 이상 크며, 무손실 FFV1 저장을 통해 ‘깨끗한’ 레퍼런스를 제공한다. 따라서 비디오 압축, 초해상도, 노이즈 감소, 배경 처리 등 RTC 특화 연구에 있어 학습·평가용 고품질 데이터베이스로 활용될 수 있다.

한계점으로는 MJPEG 기반 캡처가 전체의 75 %를 차지해 완전 비압축 데이터가 상대적으로 적고, 라벨링이 크라우드 기반이므로 주관적 편차가 존재한다는 점을 들 수 있다. 향후 연구에서는 고해상도(4K) 캡처 비중을 확대하고, 다양한 조명·네트워크 조건을 추가해 데이터 다양성을 높이는 것이 바람직하다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기