희소 목표의 하드 라벨이 회전 불변 알고리즘을 오도한다

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

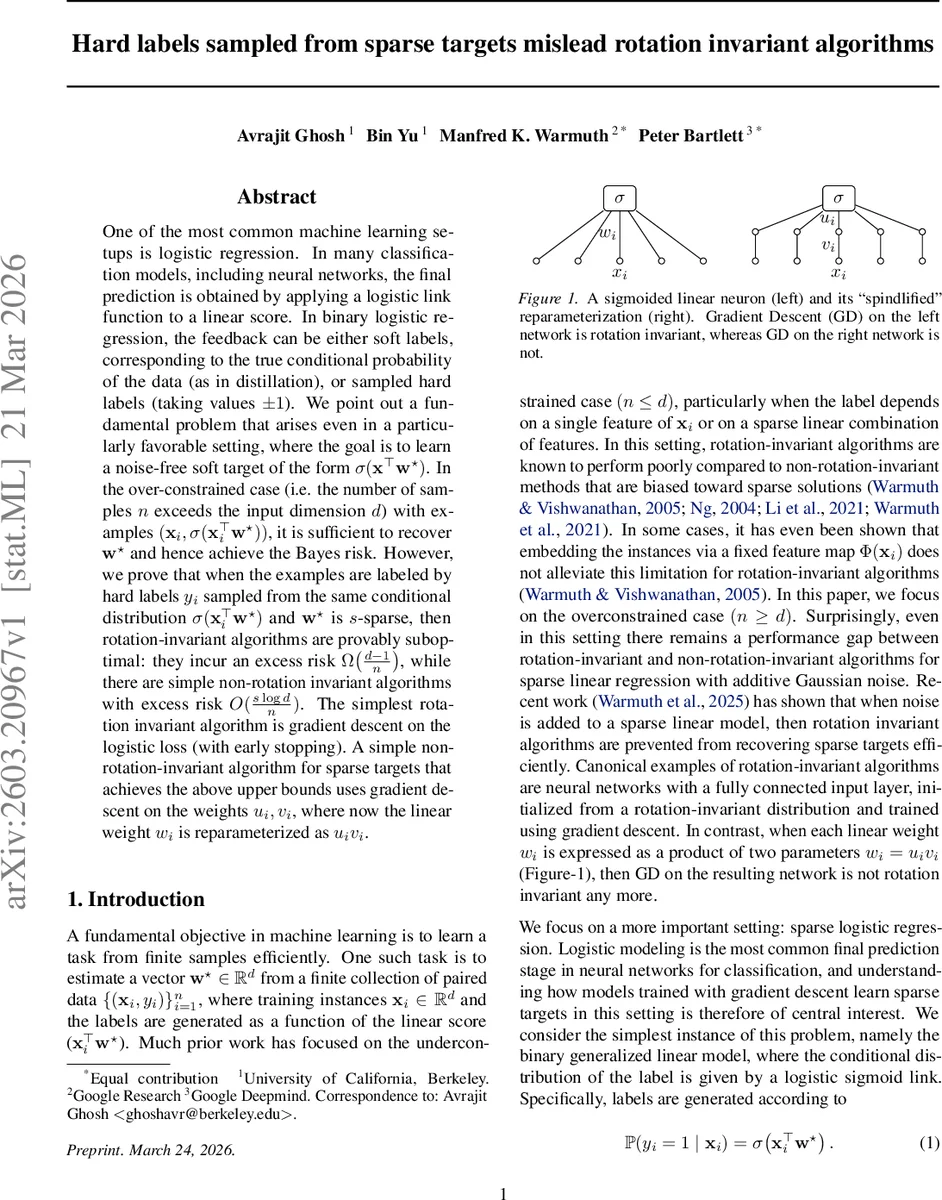

이 논문은 입력이 정규분포를 따르고 목표 가중치가 s‑희소인 로지스틱 회귀에서, 소프트 라벨을 사용할 경우 회전 불변 알고리즘(예: 로지스틱 손실에 대한 GD)으로 정확히 w*를 복원할 수 있지만, 하드 라벨(±1)을 샘플링해 학습하면 동일한 알고리즘은 Ω((d‑1)/n) 의 과잉 위험을 갖는다. 반면, 가중치를 w_i = u_i v_i 로 파라미터화한 비회전 불변 “스핀들” 네트워크에 GD를 적용하면 O(s log d / n) 의 위험을 달성한다. 저자는 회전 불변성 정의, 회전 불변 알고리즘의 하한, 비회전 불변 알고리즘의 상한을 각각 기하학적·ODE 분석을 통해 증명한다.

상세 분석

본 연구는 두 가지 핵심 가정을 전제로 한다. 첫째, 입력 벡터 x∈ℝ^d 가 i.i.d. 표준 정규분포 N(0,I)를 따른다. 둘째, 목표 파라미터 w*∈ℝ^d 가 ‖w*‖_0 = s (s≪d)이며 ‖w*‖_2=1 로 정규화된다. 라벨은 조건부 확률 P(y=1|x)=σ(xᵀw*) 로 정의되며, 여기서 σ(t)=1/(1+e^{‑t})는 로지스틱 시그모이드이다.

소프트 라벨 vs. 하드 라벨

소프트 라벨(σ(xᵀw*))을 직접 이용하면 경험 손실 L_soft(w)= (1/n)∑_i E_y|x_i

댓글 및 학술 토론

Loading comments...

의견 남기기