LLM을 활용한 소셜봇 탐지의 편향 완화와 OOD 견고성 강화

초록

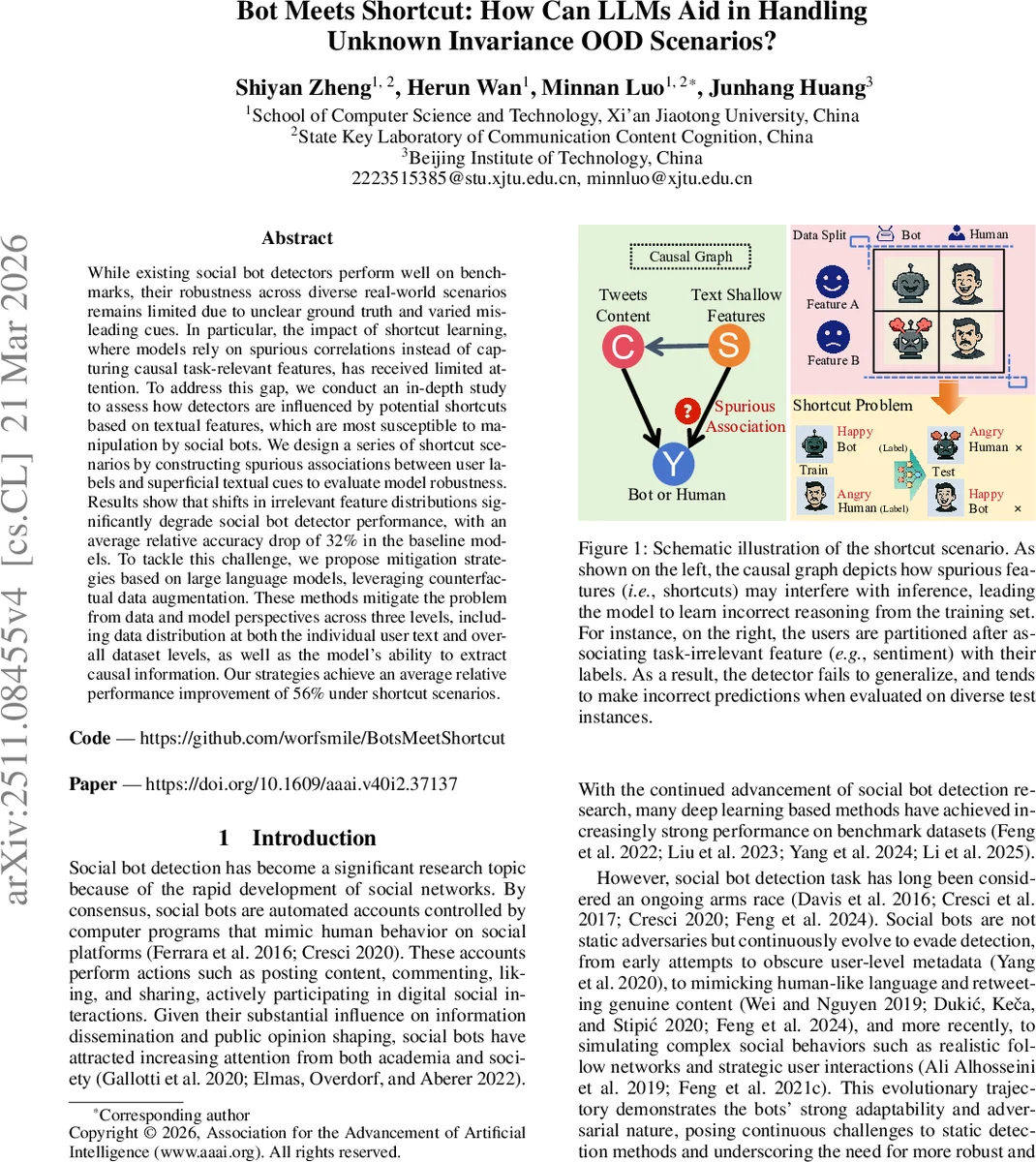

본 논문은 텍스트 기반 소셜봇 탐지 모델이 감정·주제·가치와 같은 얕은 텍스트 특성에 의존하는 ‘shortcut learning’에 취약함을 실험적으로 입증한다. spurious correlation을 인위적으로 만든 학습·테스트 셋을 통해 정확도가 평균 32 % 감소하는 것을 확인하고, 대형 언어 모델(LLM) 기반의 counterfactual data augmentation을 적용해 텍스트, 데이터셋, 모델 레벨에서 편향을 완화한다. 결과적으로 shortcut 상황에서 평균 56 % 이상의 상대 성능 회복을 달성한다.

상세 분석

이 연구는 소셜봇 탐지 분야에서 흔히 간과되는 ‘shortcut learning’ 현상을 체계적으로 규명한다. 먼저 저자들은 텍스트의 감정(sentiment), 주제(topic), 감정(emotion), 인간 가치(value) 네 가지 얕은 특성을 선택하고, 각 특성별로 긍정/부정 혹은 특정 주제·가치 라벨을 인위적으로 부여해 spurious correlation을 만든다. 예를 들어, ‘긍정적인 감정’을 가진 트윗을 봇 라벨과 연결하고, ‘부정적인 감정’을 가진 트윗을 인간 라벨과 연결하는 방식이다. 이렇게 구성된 Shortcut Train Set과, 반대 관계를 갖는 Shortcut Test Set, 그리고 기존 분포를 유지하는 Standard Test Set을 각각 세 개의 공개 데이터셋(Cresci‑2015, Cresci‑2017, Twibot‑20)에 적용하였다.

실험에서는 텍스트 기반 RoBERTa‑large와 그래프 기반 BotRGCN 두 대표 모델을 평가했으며, Shortcut Train → Shortcut Test 조합에서 정확도가 평균 33 %(텍스트)·30 %(그래프) 수준으로 급락함을 보고한다. 특히 감정·가치 특성에서는 90 % 이상 감소하는 경우도 관찰되었다. 기존 편향 완화 기법인 CIGA와 AMR 기반 디코딩을 적용했지만, spurious correlation을 완전히 제거하지 못하고 성능 회복이 미미했다.

이를 극복하기 위해 저자들은 LLM(DeepSeek API 기반)으로 Counterfactual Data Augmentation(CDA)을 수행한다. Prompt 설계는 “{속성}을 {다른 속성}으로 바꾸되 의미와 라벨은 유지한다”는 형태로, 최소한의 단어 교체만을 허용한다. 이렇게 생성된 텍스트는 원본과 쌍(pair)으로 저장되어 텍스트‑레벨 편향 점수를 계산하고, 편향이 낮은 샘플을 선택해 데이터셋‑레벨에서 클래스 간 특성 분포를 균형 맞춘다. 마지막으로 모델‑레벨에서는 contrastive learning을 도입해 원본‑대조 텍스트 쌍을 가까이, 다른 라벨 간은 멀리 배치하도록 학습함으로써 임베딩이 얕은 특성보다 인과적 의미에 집중하도록 유도한다.

세 단계(텍스트, 데이터셋, 모델) 모두를 적용한 후, 동일한 Shortcut Test 환경에서 텍스트 기반 모델은 평균 59 %↑, 그래프 기반 모델은 53 %↑의 상대 성능 향상을 기록했다. 특히 감정·가치와 같이 가장 큰 성능 저하를 보였던 경우에도 70 % 이상 회복되었다. 이러한 결과는 LLM이 제공하는 고품질의 counterfactual 텍스트가 spurious correlation을 효과적으로 억제하고, 모델이 진정한 인과적 특징을 학습하도록 돕는다는 점을 실증한다.

전반적으로 이 논문은 (1) 소셜봇 탐지 모델이 텍스트 얕은 특성에 과도하게 의존한다는 위험성을 정량화하고, (2) 기존 편향 완화 기법이 한계가 있음을 보여주며, (3) LLM 기반 데이터 증강이 OOD(Out‑of‑Distribution) 상황에서도 견고한 성능을 유지하도록 하는 실용적 해결책을 제시한다는 점에서 학술적·실무적 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기