대화 속 추론, 왜 더 어려워지는가

초록

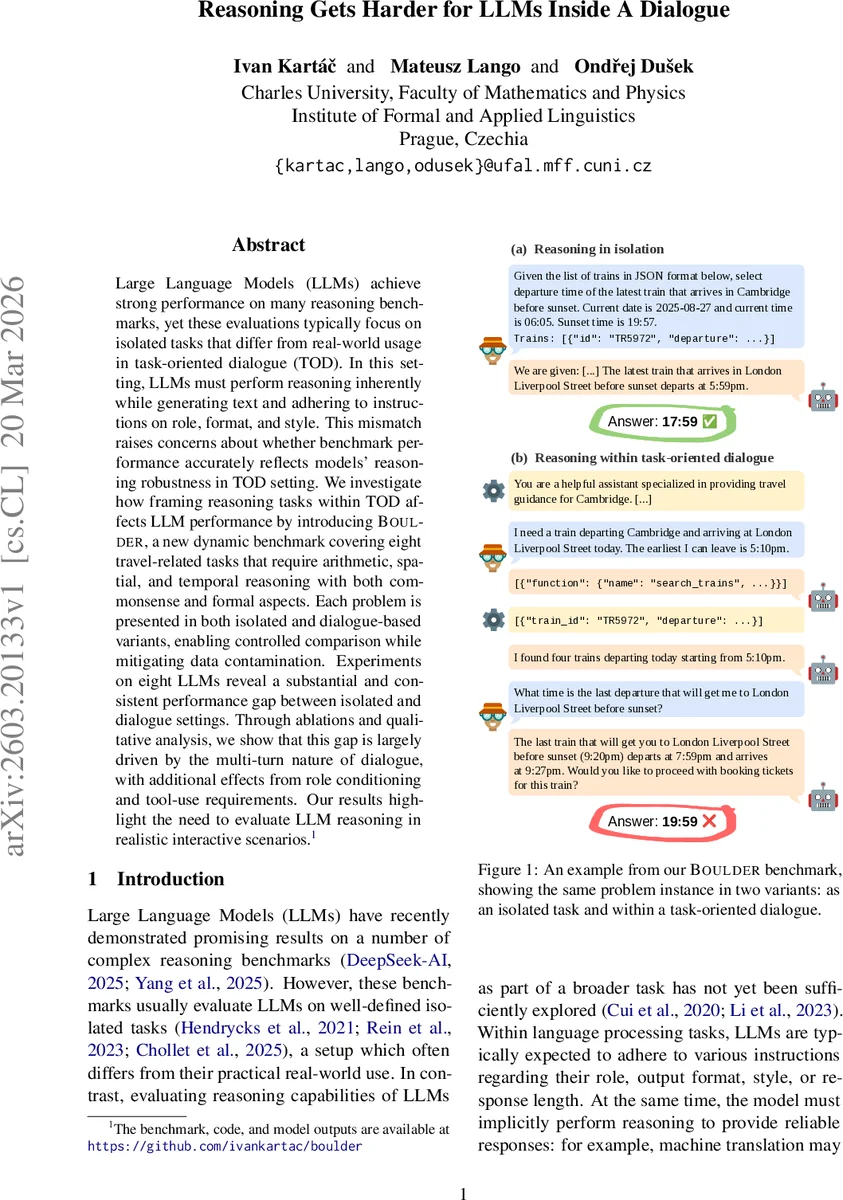

본 논문은 기존 추론 벤치마크와 달리 실제 업무 대화(TOD) 환경에서 LLM의 추론 능력을 평가한다. 여행 도메인 8가지 과제를 포함한 동적 벤치마크 BOULDER를 설계하고, 동일 문제를 ‘단일 과제’와 ‘다중 턴 대화’ 두 형태로 제공한다. 8개 모델을 실험한 결과, 대화형 설정에서 성능이 크게 떨어짐을 확인했으며, 이는 다중 턴 상호작용, 역할 지정, 툴 호출 요구가 복합적으로 작용하기 때문이다.

상세 분석

BOULDER 벤치마크는 여행 관련 8개의 서브태스크(티켓 가격, 호텔 예약 가격, 열차 출발 시각, 출발 빈도, 식당 영업시간, 거리 계산, 방향 관계, 최단 경로)를 정의하고, 각각을 ‘isolated’와 ‘dialogue’ 두 변형으로 생성한다. 데이터는 MultiWOZ를 기반으로 동적으로 합성했으며, 동일한 JSON 데이터가 두 변형에 그대로 제공돼 비교가 공정하도록 설계되었다.

실험에서는 오픈소스 모델(Qwen‑3 30B, Mistral‑Small 24B 등)과 상용 모델(Claude, GPT‑4 등) 8종을 평가했으며, 정확도(Accuracy), 평균 절대오차(MAE) 등 태스크별 메트릭을 사용했다. 결과는 대화형 설정에서 평균 정확도가 10~20%p 감소했음을 보여준다. 특히 다중 턴 대화에서 모델이 이전 턴의 정보를 유지하지 못하거나, 역할(‘assistant as travel guide’)을 오해해 형식·스타일 요구를 위반하는 경우가 빈번했다.

세부 ablation 실험에서는 (1) 대화 히스토리를 제거하고 단일 턴 질문만 남겼을 때 성능 회복, (2) 역할 프롬프트를 없애면 약간 개선, (3) 툴 호출을 요구하지 않게 하면 가장 큰 성능 향상이 관찰되었다. 이는 LLM이 ‘생성 + 툴 호출’이라는 이중 역할을 수행할 때 인지 부하가 급증함을 시사한다.

답변 추출 파서는 Qwen‑3 30B MoE 모델을 활용해 LLM 응답에서 JSON 형태로 정답을 추출했으며, 인간 검증을 통해 파서 정확도가 94% 이상임을 확인했다. 이 과정은 자동 평가의 신뢰성을 높였지만, 여전히 ‘자유 형식’ 응답을 파싱해야 하는 한계가 존재한다.

논문의 주요 시사점은 (① 기존 추론 벤치마크는 실제 대화형 서비스에서의 성능을 과대평가한다, ② 다중 턴, 역할 지정, 툴 사용이 복합적으로 추론 성능을 저하시킨다, ③ 향후 평가와 모델 설계는 이러한 현실적 제약을 반영해야 한다)이다. 특히, LLM을 단일 모듈로 활용하는 최신 TOD 시스템이 늘어나는 상황에서, 모델이 대화 흐름을 유지하고 동시에 정확한 추론을 수행하도록 훈련·프롬프트 설계가 필요함을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기