Semantic Routing 기반 LoRA로 구현하는 가역적 평생 모델 편집

초록

SoLA는 각 편집을 독립적인 LoRA 모듈로 캡슐화하고, 입력의 의미 표현을 키로 사용해 semantic routing으로 모듈을 동적으로 활성화한다. 모듈과 키를 편집 후 고정함으로써 의미 드리프트와 파라미터 간섭을 방지하고, 키를 삭제하면 특정 편집을 정확히 되돌릴 수 있다. 또한 라우팅 네트워크를 별도로 두지 않고 편집 레이어 자체에서 결정 메커니즘을 수행한다. 실험 결과 SoLA는 적은 파라미터(0.08M)만 추가하면서 편집 정확도와 유지율을 기존 방법보다 크게 향상시킨다.

상세 분석

SoLA는 기존 평생 모델 편집 방법이 겪는 두 가지 핵심 문제—semantic drift와 catastrophic forgetting—를 근본적으로 해결한다. 첫 번째로, 각 편집을 독립적인 LoRA(Low‑Rank Adaptation) 모듈에 할당하고, 편집이 끝난 뒤 해당 모듈과 매핑 키를 완전히 고정한다. 이는 클러스터 중심을 지속적으로 업데이트하는 MELO와 달리, 의미 표현이 시간에 따라 변형되지 않으므로 동일 입력에 대해 동일 모듈이 일관되게 선택된다. 두 번째로, LoRA 모듈만을 현재 편집에 대해 학습시키고 다른 모듈은 전혀 업데이트하지 않음으로써 파라미터 공유에 따른 지식 손실을 최소화한다.

Semantic routing은 입력 시퀀스의 마지막 토큰 hidden state를 키 벡터(e)로 사용한다. 편집 단계에서 이 키와 LoRA 모듈을 1:1 매핑해 메모리 테이블에 저장하고, 추론 시 동일한 방식으로 쿼리(q)를 추출해 거리 기반 매칭(예: L2 거리)으로 가장 근접한 키를 찾는다. 매칭 성공 시 해당 LoRA 모듈을 활성화하고, 실패 시 기본 모델 파라미터만 사용한다. 이 과정은 별도의 라우팅 네트워크를 필요로 하지 않으며, “master decision layer”에서 거리와 임계값 α(0.01)를 비교해 이진 결정을 내린다.

가역성은 키를 메모리에서 삭제함으로써 구현된다. 키가 사라지면 해당 LoRA 모듈은 매칭되지 않아 원래의 베이스 모델이 그대로 동작한다. 따라서 편집을 추가·삭제하는 것이 마치 버전 관리 시스템처럼 직관적이며, 재학습 없이도 정확한 롤백이 가능하다.

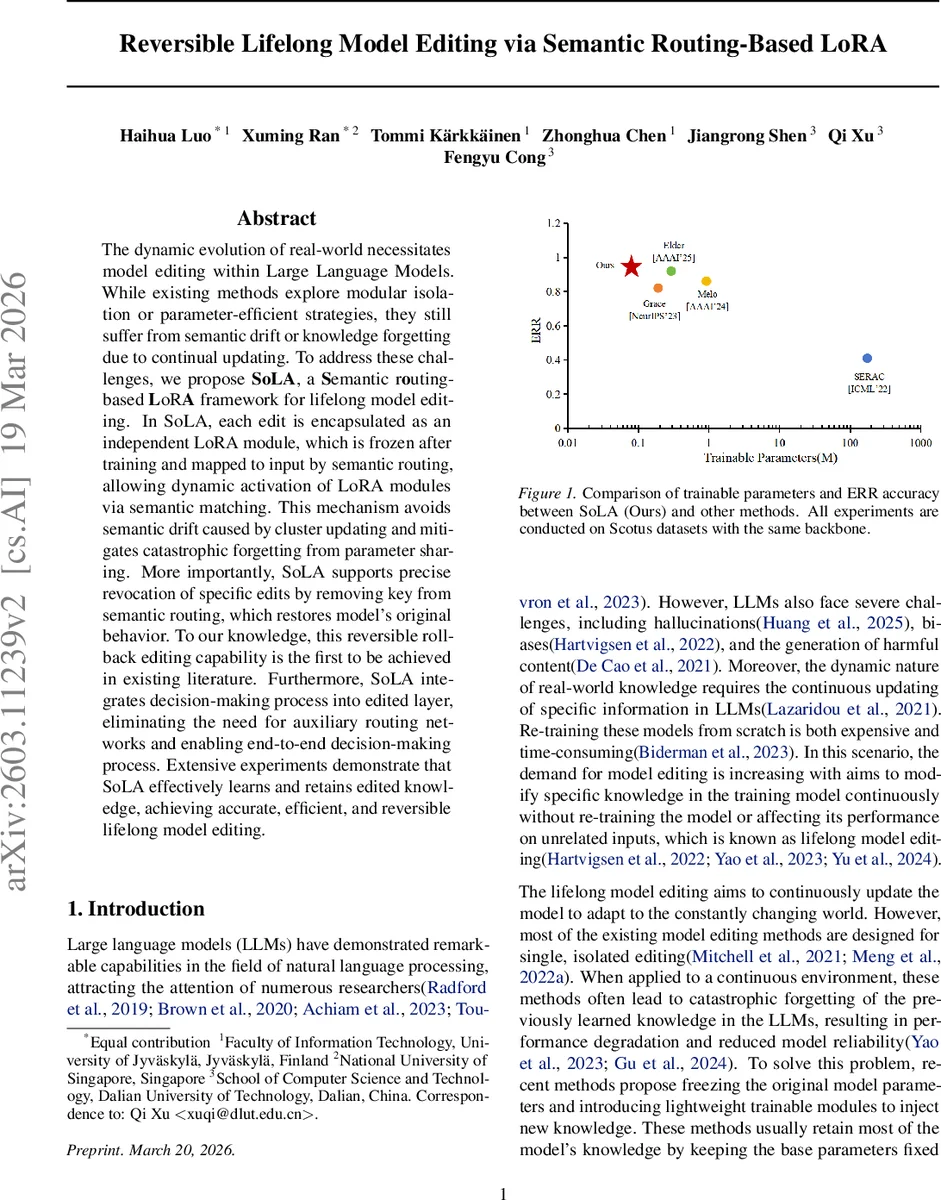

파라미터 효율성 측면에서 SoLA는 전체 모델에 비해 0.08M 정도의 추가 파라미터만 필요하다. 이는 기존 MoE 기반 ELDER나 클러스터링 기반 MELO가 요구하는 수백만 파라미터에 비해 현저히 적다. 실험에서는 SCO TUS, zsRE, Hallucination 등 다양한 벤치마크에서 Edit Reliability Rate(ERR), Task Retention Rate(TRR), Accuracy Attention Rate(ARR)를 종합적으로 평가했으며, SoLA가 가장 높은 ERR(0.97)과 TRR(0.95)을 기록했다.

또한 SoLA는 “master decision mechanism”을 통해 라우팅 로직을 편집 레이어 내부에 통합함으로써 end‑to‑end 학습과 추론 파이프라인을 단순화한다. 이는 외부 라우팅 네트워크가 추가적인 연산 비용과 복잡성을 유발하는 문제를 해결한다. 전체적으로 SoLA는 파라미터 효율성, 편집 정확도, 지식 보존, 그리고 가역성이라는 네 가지 핵심 요구사항을 동시에 만족시키는 최초의 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기