멀티모달 검색 기반 방사선 인상 초안 자동화

본 연구는 CLIP 기반 이미지·텍스트 임베딩을 활용해 MIMIC‑CXR의 사례를 검색하고, 검색된 사례를 근거로 하여 인상( impression) 초안을 생성하는 RAG 시스템을 제안한다. 이미지와 보고서 텍스트를 융합한 임베딩이 단일 이미지 임베딩보다 검색 성능을 크게 향상시켰으며(Recall@5 ≈ 0.97), 생성된 초안은 사례 인용(

저자: Himadri Samanta

본 논문은 “Grounded Multimodal Retrieval‑Augmented Drafting of Radiology Impressions Using Case‑Based Similarity Search”라는 제목으로, 방사선 이미지와 기존 보고서 텍스트를 동시에 활용해 임상적으로 신뢰할 수 있는 인상 초안을 자동 생성하는 시스템을 제안한다. 연구 배경으로는 기존 딥러닝 기반 자동 보고서 생성 모델이 높은 유창성을 보이지만, 근거가 없는 ‘환각’이나 사실과 다른 서술이 빈번해 임상 현장에서의 안전성에 의문이 제기된 점을 들었다. 이를 해결하고자 저자들은 ‘검색‑보강 생성(RAG)’ 접근법을 채택했으며, 특히 방사선학에서 이미지와 보고서 텍스트가 모두 중요한 정보를 담고 있다는 점에 주목해 멀티모달 임베딩을 설계하였다.

데이터 구축 단계에서는 MIMIC‑CXR‑JPG 데이터베이스에서 2 000건의 연구를 무작위 추출하고, DICOM‑level 메타데이터와 이미지 파일을 매핑해 3 149개의 이미지‑보고서 쌍을 확보하였다. 이후 보고서에서 ‘IMPRESSION’ 섹션만을 추출해 품질 검증을 거친 결과, 최종적으로 2 696개의 고품질 이미지‑인상 쌍을 확보하였다. 이 과정에서 라벨링 오류, 결측 텍스트, 비정상 이미지 등을 제거해 데이터 정합성을 높였다.

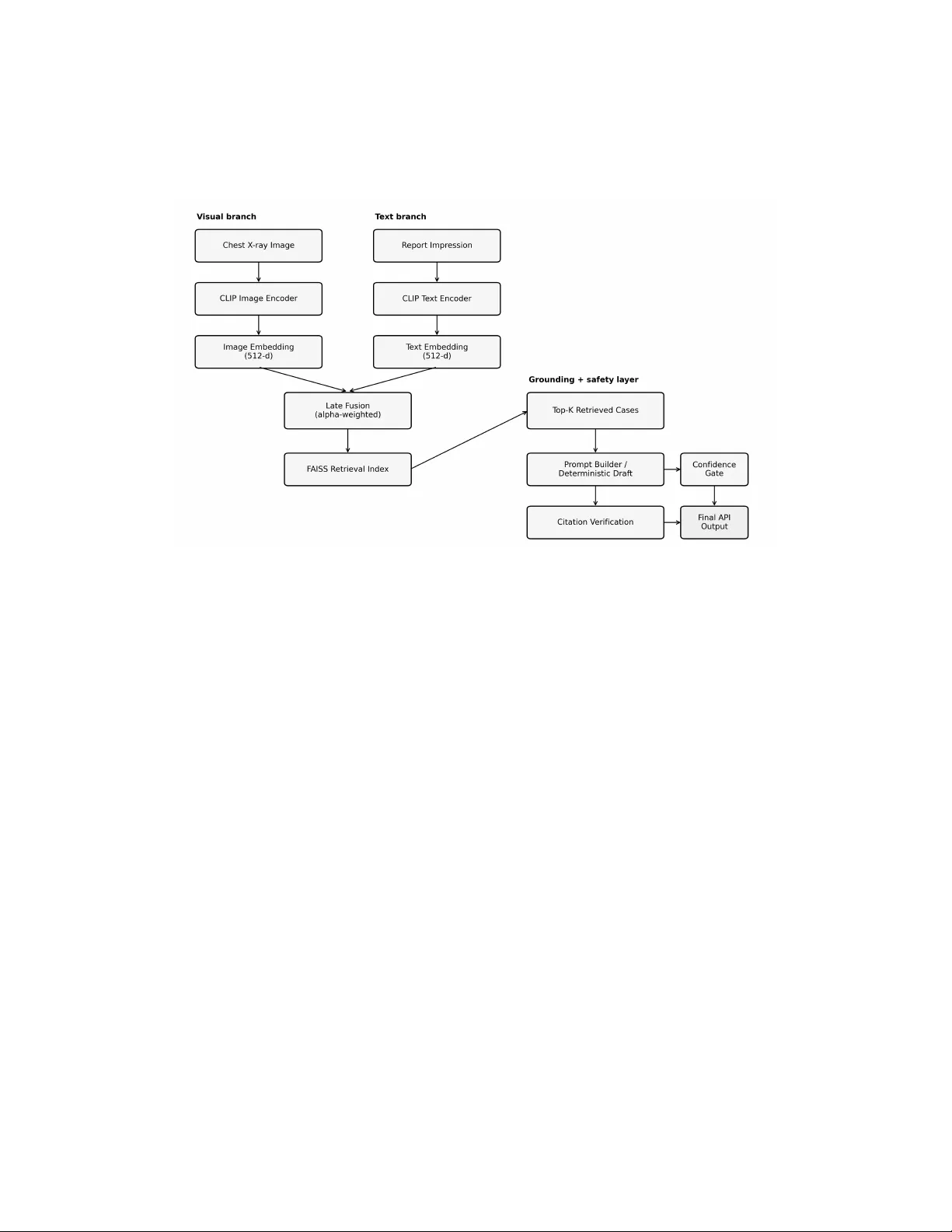

임베딩 생성은 CLIP 모델을 기반으로 한다. 이미지에는 CLIP ViT‑B/32 인코더를, 텍스트에는 동일 CLIP 텍스트 인코더를 사용해 각각 512‑차원 벡터를 얻고, L2 정규화를 통해 코사인 유사도와 동일한 내적 연산이 가능하도록 했다. 이후 ‘late‑fusion’ 방식을 적용해 이미지와 텍스트 임베딩을 α · e_image + (1‑α)·e_text 로 결합했으며, α 값에 대한 실험적 탐색을 통해 α = 0.5가 가장 높은 Recall@5(0.975)를 기록함을 확인했다. 이는 이미지와 텍스트가 서로 보완적인 정보를 제공한다는 것을 실증한다.

검색 인프라로는 FAISS를 이용해 정규화된 결합 벡터를 인덱싱하였다. 질의 단계에서는 사용자가 제공한 새로운 흉부 X‑ray 이미지만을 입력으로 받아 이미지‑전용 인덱스를 조회하고, 가장 유사한 K (논문에서는 3) 사례를 반환한다. 반환된 사례들의 ‘IMPRESSION’ 텍스트는 ‘증거 스니펫’으로 가공돼 프롬프트에 삽입된다. 초안 생성은 두 가지 경로를 제공한다. 첫 번째는 경량 LLM(예: GPT‑Neo)으로 자유형 텍스트를 생성하고, 두 번째는 결정론적 요약기(Deterministic Summarizer)를 사용해 증거 스니펫을 그대로 요약한다. 두 번째 방식은 LLM이 비정상적인 출력을 내는 경우에 대비한 ‘fallback’ 역할을 수행한다.

생성된 초안은 반드시 사례 인용 마크(

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기