그래프 트랜스포머의 구조적 장점, 가우시안 프로세스 한계로 밝히다

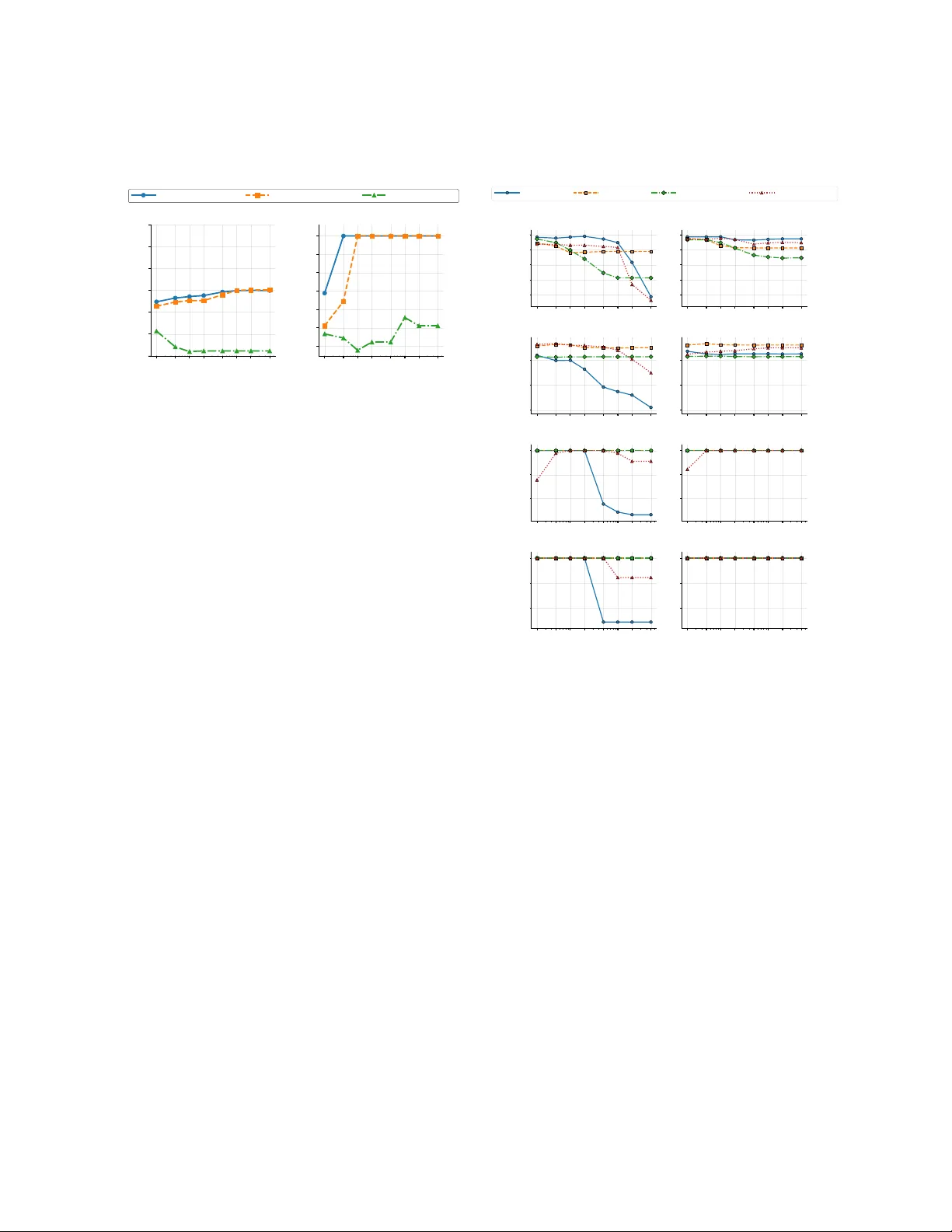

본 논문은 그래프 트랜스포머(GAT, Graphormer, Specformer)의 무한 폭·무한 헤드 한계에서 나타나는 뉴럴 네트워크 가우시안 프로세스(NNGP) 커널을 유도하고, 이를 통해 그래프 컨볼루션 기반 GCN이 겪는 오버스무딩 현상을 트랜스포머가 어떻게 회피하는지 이론적으로 증명한다. 특히 커뮤니티 구조를 보존하는 메커니즘과 위치 인코딩·구조적 프라이어가 깊은 레이어에서도 표현력을 유지시키는 역할을 함을 보인다.

저자: Nil Ayday, Lingchu Yang, Debarghya Ghoshdastidar

본 연구는 그래프 구조 데이터를 처리하는 최신 모델인 그래프 트랜스포머(GAT, Graphormer, Specformer)의 성공 요인을 이론적으로 규명하고자 한다. 기존 메시지 패싱 기반 GNN은 깊은 레이어에서 노드 임베딩이 서로 동일해지는 오버스무딩 현상과, 정보가 급격히 압축되는 오버스쿼싱 문제에 직면한다. 이러한 한계에도 불구하고 그래프 트랜스포머는 실험적으로 더 깊은 네트워크에서도 좋은 성능을 유지한다는 점이 관찰되었지만, 그 원리는 아직 명확히 밝혀지지 않았다.

논문은 먼저 뉴럴 네트워크 가우시안 프로세스(NNGP) 프레임워크를 도입한다. 무한 폭( width →∞ )과 무한 헤드( heads →∞ ) 조건 하에서, 랜덤 초기화된 신경망은 가우시안 프로세스로 수렴한다는 기존 결과를 그래프 트랜스포머에 적용한다. 이를 위해 각 모델의 레이어별 프리액티베이션 gℓ 를 정의하고, 그 공분산 Σ(ℓ) 와 포스트액티베이션 커널 K(ℓ) 를 재귀적으로 표현한다.

**GAT‑GP**

GAT는 인접 이웃에 대한 어텐션 스코어를 학습한다. 무한 헤드 한계에서 각 헤드의 어텐션 로그잇은 독립적인 가우시안 변수이며, 전체 어텐션 행렬 S(ℓ,h) 은 평균화된 커널 K(ℓ) 에 의해 정의된다. 정리 6에 따르면, Σ(ℓ)ab 은 이전 레이어의 K(ℓ‑1)와 인접 노드 집합 N_a, N_b 에 대한 평균을 통해 업데이트된다. 이 구조는 인접 노드 간 상관관계를 유지하면서도 헤드 수가 충분히 크면 노드 간 차별화가 보존됨을 보인다.

**Graphormer‑GP**

Graphormer는 전역 어텐션을 사용하고, 각 레이어마다 포지셔널 인코딩 Pℓi (라플라시안 고유벡터, 거리 버킷 등)를 결합한다. 이때 노드 특성은 ˜fℓ‑1i =

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기