신경 연산자들의 변환 불변성: 피츠휴‑나구모 모델 적용

본 연구는 피츠휴‑나구모(FHN) 모델의 강직한 시공간 동역학을 학습하기 위해 일곱 가지 신경 연산자(NO) 아키텍처를 비교한다. 훈련 데이터는 전류 자극의 위치와 강도만을 변동시키고 시간은 고정한 새로운 전략을 도입해 변환 불변성을 평가한다. 테스트에서는 자극을 시간·공간 모두에서 이동시켜 OOD 상황을 만든다. 결과는 CNO가 변환된 테스트에 가장 강건하지만 훈련 비용이 높고, FNO는 훈련 오차가 가장 낮지만 추론 시간이 오래 걸리며, D…

저자: Luca Pellegrini

본 논문은 신경 연산자(Neural Operators, NOs)의 변환 불변성(translation invariance) 학습 능력을 평가하기 위해, 피츠휴‑나구모(FitzHugh‑Nagumo, FHN) 모델을 실험 플랫폼으로 선택하였다. FHN 모델은 전압 V와 회복 변수 w를 연결하는 반응‑확산 편미분 방정식(PDE)과 강직 상미분 방정식(ODE)으로 구성되며, 전류 Iₐₚₚ가 일정한 형태로 시간·공간에 적용될 때, 자극을 시간축으로 이동시키면 해가 동일하게 시간만 이동한다는 물리적 변환 불변성을 가진다. 저자들은 이 특성을 활용해 훈련 데이터는 전류 자극의 위치와 강도만을 다양화하고, 자극 시작 시점은 고정한 새로운 데이터 생성 전략을 제안한다. 이렇게 하면 대규모 데이터셋을 생성하는 비용을 크게 절감하면서도 모델이 근본적인 변환 불변성을 학습하도록 강제한다.

비교 대상으로는 현재 문헌에서 제안된 일곱 가지 NO 아키텍처를 선정하였다. 1) Convolutional Neural Operators (CNOs): 밴드제한 함수 공간 위에서 연산자를 정의하고, U‑Net 구조와 스킵 연결을 통해 고주파 정보를 보존한다. 2) Deep Operator Networks (DONs): 브랜치‑트렁크 구조로 입력 전류를 계수 벡터, (x,t) 좌표를 기반으로 한 기저 함수를 각각 학습한다. 3) DONs‑CNN: 브랜치에 CNN 전처리를 추가해 공간적 특징을 추출한다. 4) POD‑DONs: 트렁크를 POD 모드로 대체해 차원 축소와 파라미터 효율성을 확보한다. 5) Fourier Neural Operators (FNOs): 푸리에 변환을 이용해 전역 커널을 파라미터화, 전역 의존성을 효율적으로 학습한다. 6) Tucker‑Tensorized FNOs (TFNOs): 텐서 분해를 적용해 파라미터 수를 감소시키면서도 FNO와 유사한 성능을 목표로 한다. 7) Localized Neural Operators (LocalNOs): 지역 커널을 적용해 메모리 사용을 최소화한다.

각 모델은 동일한 훈련·검증·테스트 분할을 사용해 학습하였다. 훈련 데이터는 자극 위치를 0.1, 0.5, 0.7 등으로, 강도 i=3, 0.5, 1.5 등으로 변형한 3가지 시나리오를 포함한다. 테스트 데이터는 자극을 시간축(예: 2 ms, 20 ms, 32 ms)과 공간축(예: 0.25, 0.5, 0.7) 모두에서 이동시킨 OOD 상황을 만든다. 이렇게 함으로써 모델이 변환 불변성을 실제로 내재화했는지를 평가한다.

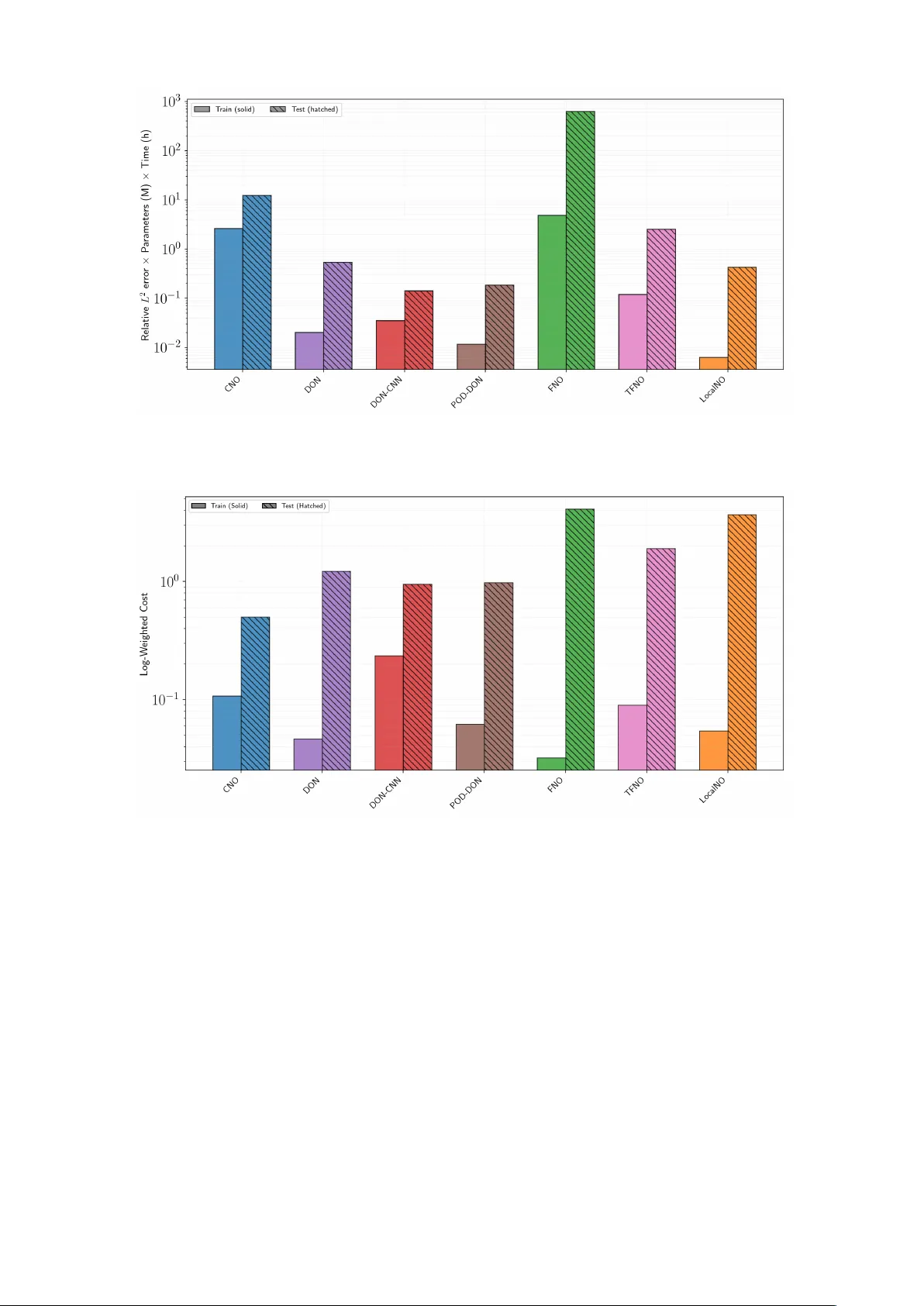

성능 평가는 네 가지 지표로 이루어진다. (1) 훈련 오차와 테스트 오차(주로 L2‑norm 기반), (2) 훈련 시간, (3) 추론 시간, (4) 파라미터 수. 결과는 다음과 같다. CNO는 테스트에서 변환된 자극에 대해 가장 낮은 상대 오차를 기록했으며, 변환 불변성을 가장 잘 보존했다. 그러나 훈련 단계에서 가장 많은 연산량과 메모리를 요구했으며, 훈련 시간도 상대적으로 길었다. FNO는 훈련 오차가 최소였고, 학습이 빠르게 수렴했지만, 변환된 테스트에서는 오차가 급격히 증가하고 추론 시간이 가장 오래 걸렸다. TFNO는 FNO와 비슷한 정확도를 보였지만 파라미터 효율성에서 약간의 이점을 가졌다. DON 계열은 훈련과 추론 모두에서 가장 가벼웠으며, 파라미터 수가 적어 실시간 적용에 유리했지만, 변환된 테스트에서는 일반화 성능이 현저히 떨어졌다. 특히 DON‑CNN은 약간의 개선을 보였으나 변환 불변성 학습에는 한계가 있었다. POD‑DON은 차원 축소 효과가 있었지만 정확도는 평균 수준에 머물렀다. LocalNO는 메모리 사용이 최소였으나 전체적인 정확도와 일반화 능력이 낮았다.

이러한 결과는 NO 아키텍처가 물리적 불변성을 어떻게 내재화하느냐에 따라 성능이 크게 달라진다는 점을 강조한다. 변환 불변성을 명시적으로 고려한 데이터 생성 전략이 CNO와 같은 고해상도 공간 변환을 유지하는 구조에 특히 유리하게 작용했으며, 전역 커널 기반 FNO는 훈련 효율은 좋지만 변환된 입력에 대한 일반화가 약함을 보여준다. 따라서 실제 전기생리학 시뮬레이션에서 빠른 추론과 변환된 자극에 대한 견고함을 동시에 요구한다면, CNO와 같은 구조가 가장 적합하다고 판단된다. 또한, 파라미터 효율성과 실시간 요구가 우선인 경우에는 DON 계열이 유리하지만, 변환 불변성 보장은 별도의 데이터 증강이나 아키텍처 설계가 필요함을 시사한다.

본 연구는 NO의 물리적 불변성 학습을 위한 데이터 효율적인 전략을 제시하고, 다양한 최신 NO 아키텍처를 포괄적으로 벤치마크함으로써 향후 전기생리학 및 기타 강직 PDE 문제에 NO를 적용할 때 고려해야 할 설계 지침을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기