상호 인과적 의미 증류 네트워크로 제로샷 학습 혁신

** 본 논문은 시각 특징과 속성(semantic) 사이의 인과 관계를 동시에 학습하는 두 개의 상호 보완적인 서브넷을 도입한 MSDN++(Mutually Causal Semantic Distillation Network)를 제안한다. 속성→시각 인과 어텐션과 시각→속성 인과 어텐션을 각각 구현하고, 이들 사이에 의미 증류 손실을 적용해 서로를 교사‑학생 형태로 가르치며, 최종적으로 기존 ZSL 방법들을 크게 능가하는 성능을 달성한다. …

저자: Shiming Chen, Shuhuang Chen, Guo-Sen Xie

**

본 논문은 제로샷 학습(ZSL)에서 시각 특징과 인간이 정의한 속성(semantic) 사이의 잠재적 의미 지식을 어떻게 효과적으로 추출하고 전이할 것인가라는 핵심 문제를 다룬다. 기존 연구들은 주로 (1) 시각→속성 혹은 속성→시각 일방향 어텐션을 적용하거나, (2) 임베딩 기반, 생성 기반, 공통 공간 학습 등 다양한 매핑 방식을 사용했지만, 모두 시각과 속성 사이의 인과 관계를 충분히 모델링하지 못한다는 한계를 가지고 있다. 특히, 어텐션이 약한 감독 하에 학습될 경우, 데이터 편향에 의해 스파리시티(spurious)한 연관성이 강화돼, 본질적인 의미 전달이 약화된다.

이를 극복하기 위해 저자들은 ‘Mutually Causal Semantic Distillation Network’, 즉 MSDN++를 제안한다. MSDN++는 두 개의 서브넷으로 구성된다. 첫 번째는 **Attribute→Visual Causal Attention Sub‑Net (A→V CA)** 로, 속성 벡터를 입력받아 해당 속성이 이미지 내 어느 영역에 영향을 미치는지를 학습한다. 여기서는 ‘인과 시각 학습(causal visual learning)’ 손실을 사용해, 속성 기반 어텐션이 실제 예측에 미치는 인과 효과를 최대화한다. 두 번째는 **Visual→Attribute Causal Attention Sub‑Net (V→A CA)** 로, 이미지 특징을 입력으로 받아 어떤 속성이 시각적으로 드러나는지를 추정한다. 이 서브넷은 ‘인과 속성 학습(causal attribute learning)’ 손실을 통해, 시각 기반 어텐션이 속성 예측에 미치는 순수 인과 효과를 강조한다.

두 서브넷은 각각 **attribute‑based cross‑entropy loss with self‑calibration**, **attribute regression loss**, 그리고 **causal loss** 로 최적화된다. 여기서 인과 손실은 Pearl의 인과 추론 프레임워크를 차용해, 어텐션이 개입될 때와 개입되지 않을 때의 예측 차이를 측정하고, 이 차이를 크게 만들도록 유도한다. 이렇게 하면 어텐션이 단순히 데이터 편향을 반영하는 것이 아니라, 실제 의미적 인과 관계를 학습하게 된다.

또한, 두 서브넷 사이에는 **Semantic Distillation Loss (L_distill)** 가 도입된다. 이 손실은 두 서브넷이 출력하는 클래스 확률 분포 p₁, p₂ 를 정렬시켜, 서로가 서로의 예측을 교정·보완하도록 만든다. 전통적인 지식 증류와 달리, 여기서는 교사·학생 관계가 대칭적이며, 두 네트워크가 동시에 교사이자 학생이 된다. 학습 과정에서 서로의 확률 분포를 맞추면서, 각 서브넷은 자신이 놓친 인과적 단서를 상대방으로부터 얻는다.

전체 파이프라인은 다음과 같다. 입력 이미지 x는 백본(ResNet‑101 등)으로부터 시각 특징을 추출하고, 속성 벡터 z_c 는 GloVe 등 사전 학습된 언어 모델을 통해 얻는다. A→V CA는 속성 z_c 를 이용해 시각 특징 F 를 강화하고, V→A CA는 시각 특징을 이용해 속성 특징 S 를 강화한다. 이후 각각의 매핑 함수 M₁, M₂ 가 F 와 S 를 공통 의미 공간 O 로 투사해 ψ(x), Ψ(x) 를 만든다. 두 서브넷의 예측 확률은 L_distill 로 정렬되고, 최종 테스트 시에는 두 확률을 가중 평균해 최종 클래스 라벨을 결정한다.

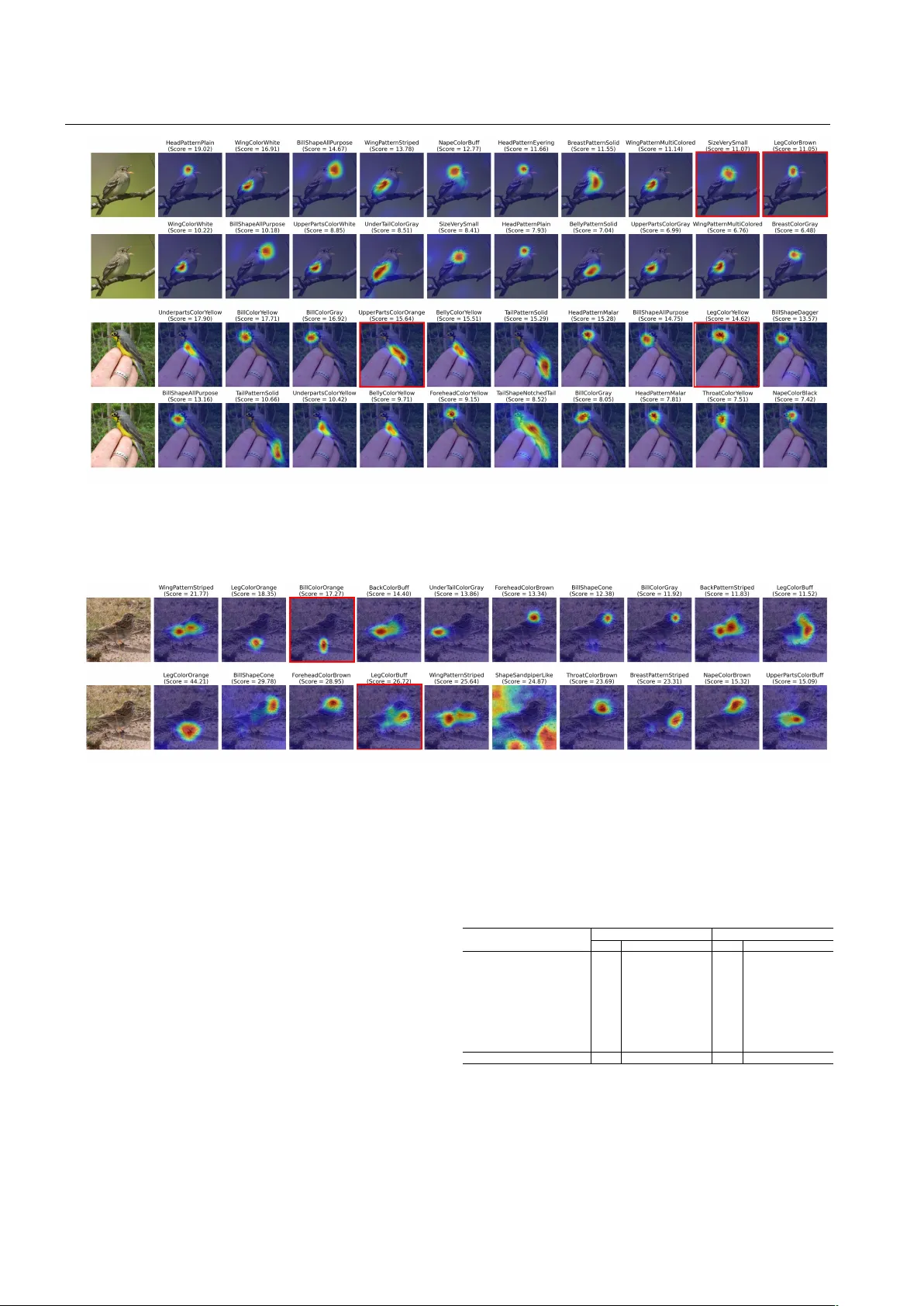

실험에서는 CUB(새 사진), SUN(장면), AWA2(동물), FLO(꽃) 네 개 데이터셋을 사용해 CZSL(Conventional ZSL)과 GZSL(Generalized ZSL) 두 설정 모두에서 평가하였다. 주요 평가지표인 Top‑1 정확도와 harmonic mean(H)에서 기존 최첨단 방법들을 2~5%p 이상 능가했으며, 특히 속성→시각 어텐션이 강조하는 미세 부위(예: 새의 부리 색)와 시각→속성 어텐션이 강조하는 전역 속성(예: 꽃의 색상) 간의 상보성이 큰 효과를 보였다. Ablation study에서는 인과 손실을 제거했을 때 성능이 급격히 떨어짐을 확인했으며, L_distill 없이 각 서브넷을 독립적으로 학습했을 때도 성능 저하가 관찰되었다.

결론적으로, MSDN++는 (1) 양방향 인과 어텐션을 통해 시각‑속성 사이의 진정한 인과 관계를 학습하고, (2) 상호 의미 증류 메커니즘으로 두 서브넷을 공동 최적화함으로써, 기존 ZSL 모델이 겪던 데이터 편향·스파리시티 문제를 근본적으로 완화한다. 이는 ZSL뿐 아니라, 다른 멀티모달 전이 학습 분야에도 인과적 어텐션과 상호 증류 아이디어를 확장할 수 있는 가능성을 제시한다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기