설명 가능한 에너지와 지연 최적화를 위한 적응형 강화학습 메모리 컨트롤러

본 논문은 메모리 컨트롤러의 파라미터를 실시간으로 조정하여 DRAM의 지연과 에너지 소비를 동시에 최소화하는 다중 에이전트 강화학습 프레임워크인 ReLMXEL을 제안한다. 보상 함수를 여러 성능 지표로 분해하고, 보상 차이 설명(RDX)과 최소 충분 설명(MSX) 기법을 적용해 의사결정 과정을 투명하게 만든다. DDR4 기반 시뮬레이션 실험에서 다양한 워크로드에 대해 기존 정적 정책 대비 평균 12 % 이상의 지연 감소와 9 % 이상의 에너지 …

저자: Panuganti Chirag Sai, G, holi Sarat

본 논문은 현대 컴퓨팅 시스템에서 DRAM 메모리 서브시스템의 지연과 에너지 소비를 동시에 최소화하는 것이 핵심 과제임을 지적하고, 이를 해결하기 위한 새로운 프레임워크인 ReLMXEL을 제안한다. ReLMXEL은 “Reinforcement Learning for Memory Controller with Explainable Energy and Latency Optimization”의 약자로, 메모리 컨트롤러 내부에 다중 강화학습 에이전트를 배치해 실시간으로 파라미터를 조정한다. 기존 연구(Ipek 등)의 자기 최적화 메모리 컨트롤러가 스케줄링 명령에만 초점을 맞추고, 파라미터 전반을 다루지 못했으며, 강화학습 정책의 불투명성 때문에 실제 시스템에 적용하기 어려웠다는 문제점을 인식한다.

### 1. 설계 원리

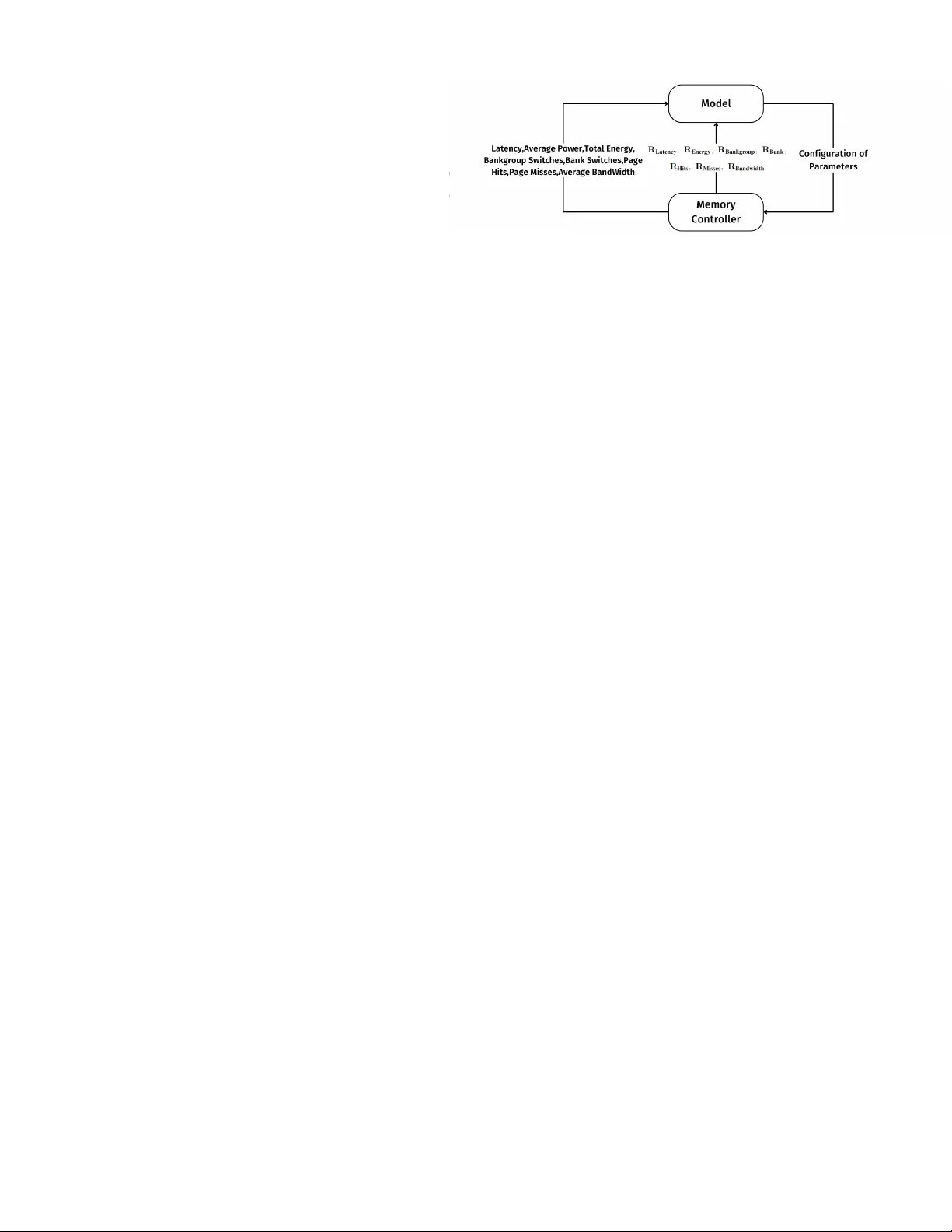

ReLMXEL은 메모리 컨트롤러가 제공하는 상세 메트릭을 상태(state)로 사용한다. 여기에는 요청당 지연, 평균 전력, 총 에너지, 대역폭 활용도, 뱅크·뱅크그룹 전환 횟수, 페이지 히트·미스 등이 포함된다. 이러한 메트릭은 DRAM의 물리적 동작을 직접 반영하므로, 에이전트가 현재 메모리 시스템의 상태를 정확히 파악할 수 있다.

행동(action)은 DRAM 파라미터의 조합으로 정의된다. 페이지 정책(Open, OpenAdaptive, Closed, ClosedAdaptive), 스케줄러(FIFO, FR‑FCFS, FR‑FCFS‑Grp), 스케줄러 버퍼(Bankwise, ReadWrite, Shared), 아비터(Simple, FIFO, Reorder), 응답 큐(FIFO, Reorder), 리프레시 정책(NoRefresh, AllBank), RefreshMaxPostponed, RefreshMaxPulledin, RequestBufferSize, MaxActiveTransactions 등 총 12개의 조정 가능한 파라미터가 있다. 각 파라미터마다 독립적인 Q‑테이블을 유지해 상태‑행동‑보상 삼중관계를 학습한다.

보상 함수는 기존의 단일 스칼라 보상이 아니라, 목표값과 관측값의 차이를 각 메트릭별로 정규화한 벡터 Rₓ = |R_target – R_observed| 로 구성한다. 전체 보상은 R_T = Σ_i R_Xi 로 합산한다. 이렇게 하면 에너지와 지연 등 서로 상충하는 목표를 동시에 고려할 수 있다.

### 2. 설명 가능성 메커니즘

ReLMXEL은 보상 분해와 설명 가능성 기법을 결합한다. 보상 차이 설명(RDX)은 두 행동 a₁, a₂ 사이의 Q‑값 차이를 메트릭별로 계산해 ∆(s,a₁,a₂)=∑_c

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기