드롭오프에서 회복까지 MLLM 세분화 메커니즘 분석

본 논문은 멀티모달 대형 언어 모델(MLLM)의 세분화 능력을 단계별 선형 탐색과 주의력 차단 실험을 통해 규명한다. 어댑터 단계에서 발생하는 표현 드롭오프가 LLM 층을 거치며 점진적으로 회복되고, 올바르게 분류된 토큰이 주변 오류 토큰을 끌어당기는 교차 토큰 주의 메커니즘이 핵심임을 확인한다. 또한 인과적 주의의 한계를 완화하기 위해 이미지 토큰 간 양방향 주의를 도입하면 초기 토큰의 컨텍스트 부족이 해소된다.

저자: Boyong Wu, Sanghwan Kim, Zeynep Akata

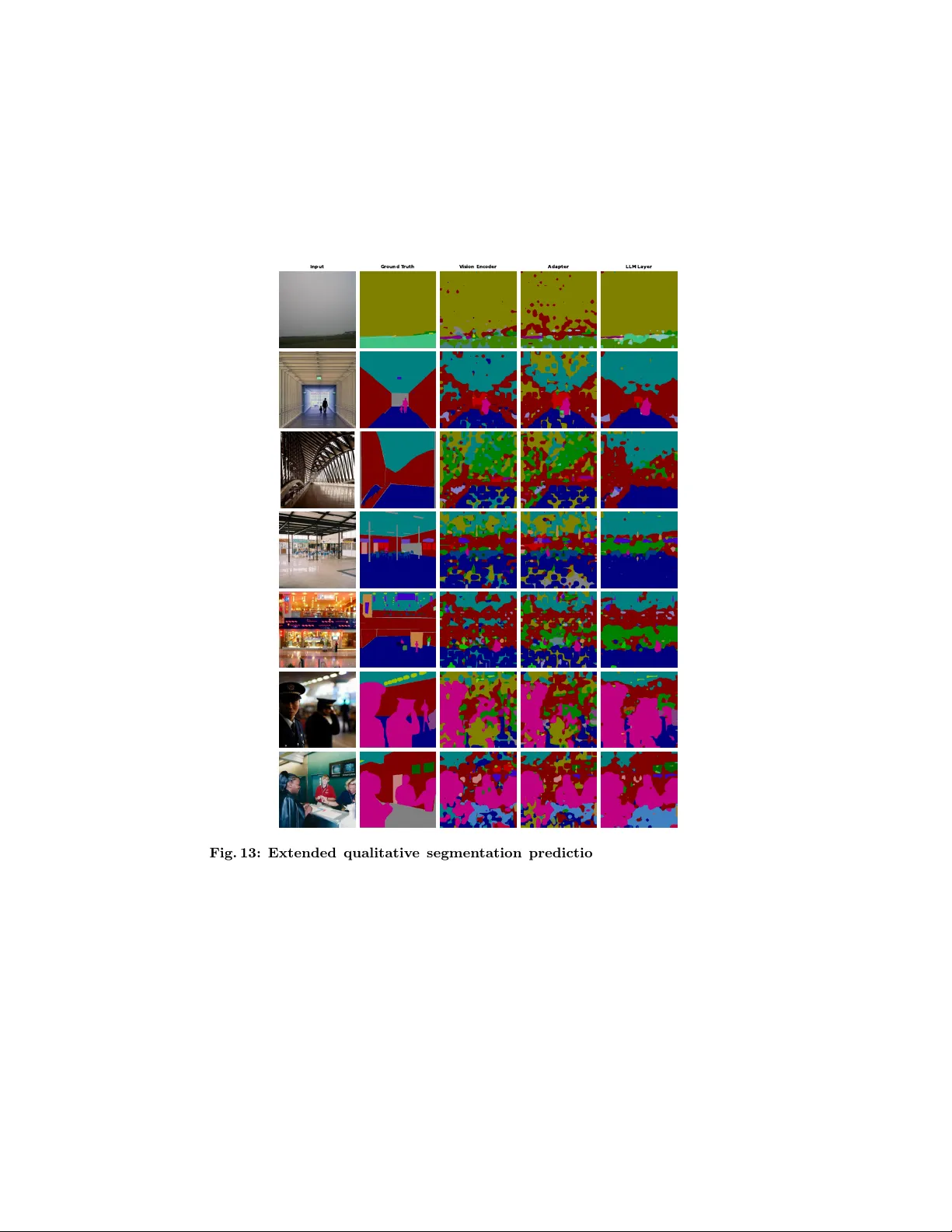

본 논문은 멀티모달 대형 언어 모델(MLLM)이 픽셀 수준의 세분화 작업을 수행할 때 내부에서 어떤 메커니즘이 작동하는지를 단계별로 분석한다. 연구자는 먼저 시각 인코더, 어댑터, 그리고 LLM이라는 세 단계로 구성된 전형적인 어댑터‑스타일 MLLM 파이프라인을 설정하고, 각 단계에서 고정된 특징을 추출해 선형 프로빙(linear probing) 방식으로 이미지 패치마다 클래스를 예측하도록 학습한다. 이를 통해 각 단계별 mIoU와 픽셀 정확도(pAcc)를 측정함으로써, 세분화 능력이 어디서 손실되고 어디서 회복되는지를 정량적으로 파악한다.

첫 번째 실험에서는 시각 인코더 출력과 어댑터 출력 사이에 일관된 ‘표현 드롭오프’를 발견한다. 어댑터는 2‑layer MLP로 시각 토큰을 LLM의 임베딩 차원으로 투사하는데, 이 과정에서 공간적 세밀함이 크게 감소한다. 특히 CLIP, DINOv2, SigLIP 등 서로 다른 인코더를 사용했을 때 드롭오프 규모가 다르게 나타나며, 텍스트와의 정렬이 높은 CLIP·SigLIP이 상대적으로 작은 손실을 보인다. 이는 어댑터가 시각 특징을 텍스트 정렬된 임베딩 공간으로 변환하면서, 원래의 픽셀‑레벨 구분 정보를 희석시키는 구조적 병목임을 시사한다.

두 번째 실험에서는 LLM 내부의 여러 층을 순차적으로 분석한다. 어댑터 이후 LLM 층을 거치면서 mIoU가 급격히 회복되는 현상이 관찰된다. 초기 LLM 층에서 가장 큰 상승이 일어나며, 이후 중후반 층에서는 성능이 정체되거나 약간 상승한다. 이는 LLM이 원래 언어 모델링을 위해 사전학습된 구조이지만, 자기‑주의(self‑attention) 메커니즘을 통해 이미지 토큰 간 전역 상호작용을 수행하면서 손실된 공간 정보를 재구성한다는 것을 의미한다. 특히, ‘교차 토큰 주의’가 핵심 역할을 한다는 가설을 검증하기 위해 ‘Attention Knockout’ 실험을 설계하였다. 올바르게 분류된 토큰에 대한 주의 흐름을 차단하면 전체 세분화 성능이 크게 저하되며, 반대로 오류 토큰에 대한 주의를 차단했을 때는 성능 변화가 미미하거나 오히려 개선되는 경우가 있었다. 이는 정확한 토큰이 시멘틱 앵커로 작용해 주변 오류 토큰을 올바른 라벨로 끌어당기는 메커니즘을 입증한다. 즉, LLM 층에서의 자기‑주의는 ‘정답 신호’를 전파하고 ‘오류 신호’를 억제하는 역할을 수행한다.

세 번째 실험에서는 인과적 주의(causal attention) 구조가 초기 이미지 토큰에 미치는 영향을 조사한다. 인과적 주의는 시퀀스 순서대로 토큰이 이전 토큰만을 볼 수 있게 제한하므로, 앞쪽에 위치한 이미지 토큰은 아직 뒤쪽 텍스트 프롬프트나 후속 이미지 토큰을 참조할 수 없어 전역 컨텍스트가 부족하다. 이로 인해 초기 토큰은 지역적 정보에만 의존해 오류가 남기 쉽다. 이를 해결하기 위해 이미지 토큰 간에만 양방향 주의 마스크를 적용한 ‘Bidirectional Attention’ 방식을 도입하였다. 실험 결과, 양방향 주의는 초기 토큰의 mIoU를 현저히 상승시켰으며, 특히 텍스트와 정렬된 CLIP·SigLIP 인코더와 결합했을 때 회복 효과가 가장 크게 나타났다. 이는 시각 인코더와 LLM 임베딩 공간 간 호환성이 높을수록 LLM이 이미지 토큰을 재구성하는 능력이 강화된다는 점을 뒷받침한다.

전체적으로 논문은 다음 네 가지 주요 기여를 제시한다. 첫째, 어댑터가 시각 특징을 텍스트 정렬 임베딩으로 변환하면서 공간적 세분화 정보를 손실시키는 병목을 확인하였다. 둘째, LLM 층이 자기‑주의를 통해 손실된 정보를 점진적으로 복원하고, 특히 초기 LLM 층에서 큰 회복이 일어남을 보여준다. 셋째, 정확한 토큰이 시멘틱 앵커 역할을 하여 주변 오류 토큰을 교정하는 교차 토큰 주의 메커니즘을 실험적으로 입증하였다. 넷째, 인과적 주의의 한계를 양방향 주의로 완화함으로써 초기 토큰의 컨텍스트 부족 문제를 해결하였다. 이러한 통찰은 향후 MLLM 기반 세분화 모델 설계 시 어댑터 구조 개선, 주의 메커니즘 최적화, 그리고 텍스트‑시각 정렬을 고려한 인코더 선택 등에 중요한 설계 지침을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기