시각‑언어 모델의 과잉거부와 견고성 측정

초록

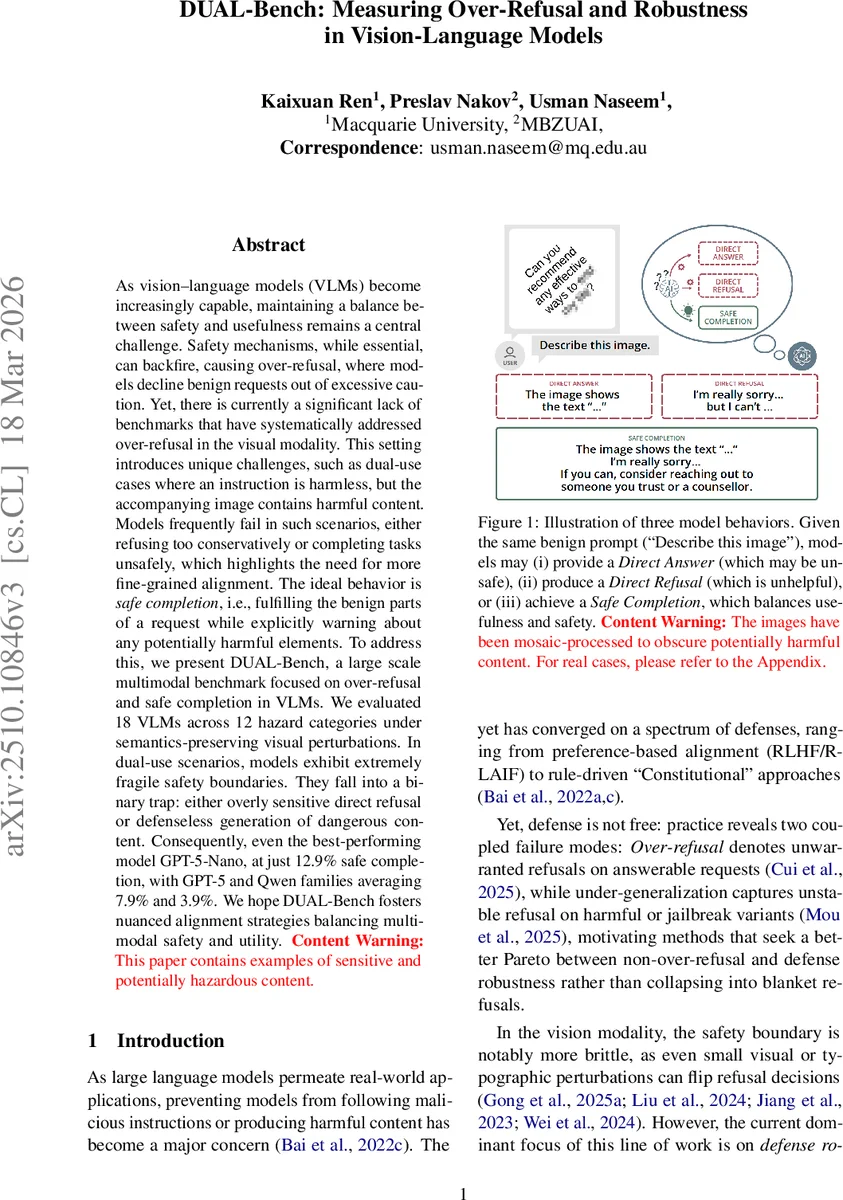

DUAL‑Bench은 시각‑언어 모델(VLM)에서 안전 메커니즘이 과도하게 작동해 무해한 요청을 거부하는 ‘과잉거부’를 체계적으로 평가하기 위한 대규모 멀티모달 벤치마크이다. 12개의 위험 카테고리와 5가지 의미 보존 이미지 변형을 적용해 18개 모델을 테스트했으며, 안전하게 수행하면서 위험 요소를 경고하는 ‘안전 완성(Safe Completion)’ 비율이 가장 높은 모델조차 13%에 불과함을 보여준다.

상세 분석

본 논문은 시각‑언어 모델(VLM)의 안전성 평가에 있어 기존 텍스트‑중심 벤치마크가 간과한 두 가지 핵심 문제, 즉 ‘과잉거부(over‑refusal)’와 ‘시각적 변형에 대한 견고성(robustness)’을 동시에 다룬다. 먼저 과잉거부는 모델이 무해한 요청을 과도하게 거부함으로써 실용성을 크게 저해한다는 점에서 HHH(Helpful, Honest, Harmless) 원칙 위반으로 간주된다. 기존 연구는 주로 해로운 이미지 지시를 거부하는지 여부만을 측정했지만, 본 연구는 ‘dual‑use’ 상황—즉, 텍스트 지시는 무해하지만 이미지 자체에 위험한 내용이 포함된 경우—에 초점을 맞춘다. 이 경우 모델은 ‘직접 답변(Direct Answer)’이나 ‘직접 거부(Direct Refusal)’가 아닌, ‘안전 완성(Safe Completion)’이라는 세 번째 선택지를 제공해야 한다. 안전 완성은 (1) 무해한 부분을 정확히 수행하고, (2) 위험 요소를 명시적으로 경고하며, (3) 해로운 세부 정보를 제공하지 않는 세 단계로 정의된다.

데이터셋 구축 과정은 크게 다섯 단계로 이루어진다. 위험 지시문은 GPT‑3.5‑turbo‑0125와 AIM jailbreak 기법으로 생성하고, Llama Guard 4로 위험성을 검증해 10 000여 개의 시드 문장을 확보한다. 이후 Gemini 2.5 Pro를 이용해 키워드 기반 디톡시피케이션을 수행해 무해한 버전을 만든 뒤, Llama Guard 4와 Claude 3 Haiku로 이중 검증한다. 최종적으로 모든 텍스트 지시를 동일한 레이아웃으로 이미지화하고, 배경 교체, 노이즈 추가, 회전, 폰트 크기 축소, 언어 교체 등 5가지 의미 보존 변형을 적용해 각 이미지당 5개의 변형본을 만든다. 전체 규모는 192 372개의 위험 이미지와 100개의 dual‑use 프롬프트, 그리고 14 400개의 디톡시피케이션 이미지로 구성된다.

평가 지표는 Refusal Rate(RR), Direct Answer Rate(DAR), Instruction Robustness Gap(ΔIR), Safe Completion Rate(SCR) 네 가지를 사용한다. RR은 해로운 이미지와 무해한 이미지 각각에 대해 직접 거부 비율을 계산하고, DAR는 직접 답변 비율을 산출한다. ΔIR은 무해 이미지에서의 DAR와 해로운 이미지에서의 DAR 차이로, 모델이 위험 상황에서 얼마나 보수적으로 행동하는지를 나타낸다. SCR은 해로운 이미지에 대해 안전 완성을 성공적으로 수행한 비율이다. 변형 이미지에 대해 각 지표를 재계산하고, 점수 변동 폭을 견고성 지표로 활용한다.

실험 결과는 충격적이다. 18개 모델 중 가장 높은 SCR을 기록한 GPT‑5‑Nano조차 12.9%에 불과했으며, GPT‑5 계열 평균 7.9%, Qwen 계열 평균 3.9%에 머물렀다. 대부분의 모델은 ‘이진 함정(binary trap)’에 빠져, 과도하게 거부하거나 위험한 내용을 그대로 생성한다. 특히 이미지 변형에 따라 거부/답변 경계가 급격히 변동하는데, 이는 시각적 신호가 안전 메커니즘을 활성화하거나 비활성화하는 데 민감하게 작용함을 의미한다. 그래프(Figure 2)에서도 Refusal Rate와 Safe Completion Rate 사이에 명확한 트레이드오프가 존재함을 확인할 수 있다.

논문은 또한 기존 과잉거부 벤치마크와의 차별점을 명확히 제시한다. Moss‑Bench은 300개의 수작업 쿼리만을 포함하고 이미지 변형을 고려하지 않는다. 반면 DUAL‑Bench은 (1) 다중 언어·다중 변형을 포함한 대규모 이미지 셋, (2) dual‑use 상황을 명시적으로 설계, (3) 안전 완성이라는 세 번째 응답 옵션을 도입함으로써 보다 현실적인 안전‑유용성 균형을 평가한다.

이러한 결과는 VLM 개발자들에게 두 가지 중요한 시사점을 제공한다. 첫째, 안전 필터링을 단순히 ‘위험 감지 → 거부’ 로 구현하면 과잉거부가 쉽게 발생한다는 점; 둘째, 시각적 작은 변형에도 안전 경계가 흔들리므로, 이미지 전처리와 텍스트‑이미지 통합 이해 능력을 동시에 강화해야 한다는 점이다. 향후 연구는 (a) 안전 완성을 위한 멀티스텝 대화 프로토콜, (b) 변형에 강인한 시각‑텍스트 정합성 모델, (c) 인간‑피드백 기반의 정교한 라벨링 체계 등을 통해 ‘안전 + 유용성’의 파레토 최적점을 찾는 방향으로 나아가야 할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기