오픈리서처: 완전 오프라인 장기 연구 트래젝터리 합성 파이프라인

초록

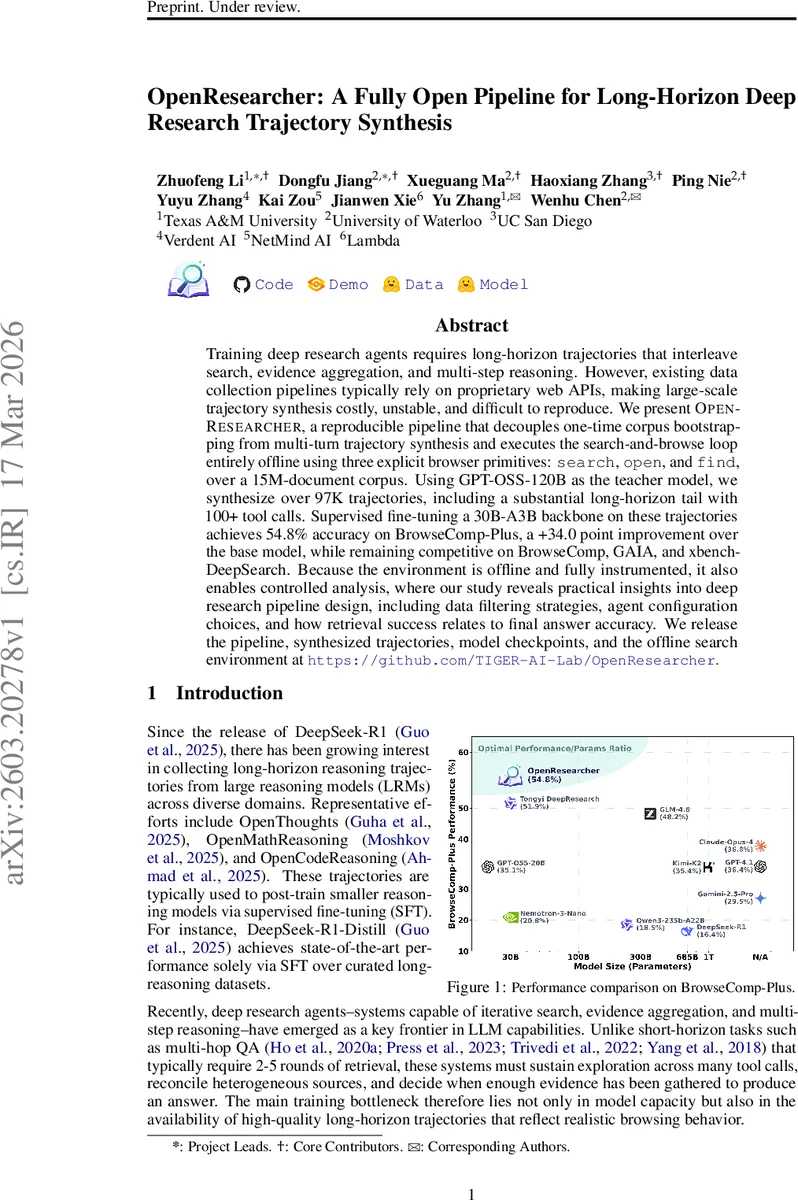

오픈리서처는 웹 API 의존성을 없애고 15 M 문서 오프라인 코퍼스를 활용해 검색·열기·찾기 세 가지 브라우저 원시 연산만으로 장기 연구 트래젝터리를 자동 생성한다. GPT‑OSS‑120B 교사 모델로 97 K 이상의 트래젝터리를 만든 뒤 30 B‑A3B 학생 모델을 SFT 하면 BrowseComp‑Plus 에 54.8 % 정확도를 달성하고, 기존 상용 모델 대비 34 포인트 상승한다. 파이프라인, 데이터, 모델, 오프라인 검색 환경을 모두 공개한다.

상세 분석

오픈리서처는 기존 딥 리서치 에이전트 학습에 필요한 장기 트래젝터리 생성 과정을 크게 두 단계로 분리한다. 첫 번째 단계는 ‘코퍼스 부트스트래핑’으로, 온라인 검색 API(Serper)를 한 번만 사용해 6 K 질문에 대해 정답을 뒷받침하는 10 K 골드 문서를 수집한다. 이 골드 문서는 이후 오프라인 코퍼스에 병합되어 15 M FineWeb 문서와 함께 인덱싱된다. 문서 임베딩은 Qwen3‑Embedding‑8B 로 생성하고 FAISS‑IVF 를 이용해 대규모 밀집 검색을 지원한다. 이렇게 하면 실시간 API 비용과 불안정성을 완전히 차단하면서도 실제 웹의 잡음과 다양성을 유지할 수 있다.

두 번째 단계는 ‘트래젝터리 합성’이다. 여기서는 교사 모델인 GPT‑OSS‑120B 를 브라우저 도구 집합(검색, 열기, 찾기)만 사용할 수 있도록 제한한다. 검색은 질의에 대한 상위 K 결과(제목·URL·스니펫)를 반환하고, 열기는 선택된 URL의 전체 텍스트를 제공한다. 찾기 도구는 현재 열린 문서 내에서 문자열 매치를 수행해 정확한 증거 위치를 지정한다. 이러한 원시 연산은 인간 연구자가 웹을 탐색하는 과정을 단계별로 모사한다는 점에서 기존의 ‘검색 → 문서 반환’ 방식보다 훨씬 풍부한 행동 공간을 제공한다.

교사 모델은 질문과 시스템 프롬프트만을 입력받아, 생각(Chain‑of‑Thought) → 도구 호출 → 관찰 순서를 반복한다. 트래젝터리는 최대 256 K 토큰 길이까지 사전 패킹되어 오프라인 환경에서도 손실 없이 저장된다. 생성된 97 K 트래젝터리 중 약 55 K는 최종 답변이 정답과 일치하도록 필터링되었으며, 이 중 다수는 100회 이상의 도구 호출을 포함하는 긴 꼬리를 형성한다. 이는 기존 연구에서 2~5회 호출에 머물던 데이터와는 확연히 차별화된다.

학생 모델은 NVIDIA‑Nemotron‑3‑Nano‑30B‑A3B 를 기반으로 Megatron‑LM 에서 8 GPU H100 으로 8시간 학습한다. 학습률 5e‑5, 학습 단계는 고정이며, 트래젝터리 길이에 맞춰 컨텍스트를 256 K 로 확장한다. 결과적으로 BrowseComp‑Plus 에서 54.8 % 정확도를 기록했으며, 이는 동일 베이스 모델 대비 34 포인트 상승이다. 또한 BrowseComp, GAIA, xbench‑DeepSearch 등 라이브 웹 벤치마크에서도 경쟁력을 유지한다.

오프라인 환경 덕분에 저자들은 여러 분석을 수행했다. (RQ1) 데이터 필터링 전략이 트래젝터리 품질에 미치는 영향, (RQ2) 골드 문서 비율과 코퍼스 규모가 검색 성공률에 미치는 효과, (RQ3) 도구 호출 예산(턴 버짓)과 모델 성능 간의 트레이드오프, (RQ4) 검색·열기·찾기 조합이 증거 발견 효율에 미치는 차이, (RQ5) 최종 정답 정확도와 검색 성공률(골드 문서 도달 여부) 사이의 상관관계 등을 체계적으로 조사했다. 특히, ‘열기+찾기’ 조합이 긴 호라이즌에서 증거 위치 파악을 크게 개선하고, 검색 성공률이 80 % 이상일 때 최종 정확도가 급격히 상승한다는 점을 밝혀냈다.

전체적으로 오픈리서처는 (1) 비용 효율적인 오프라인 검색 인프라 구축, (2) 인간‑같은 브라우징 행동을 모델링한 최소 도구 집합, (3) 대규모 장기 트래젝터리 생성 및 정제 파이프라인, (4) 재현 가능하고 분석 친화적인 환경 제공이라는 네 가지 핵심 기여를 한다. 이는 향후 딥 리서치 에이전트 연구에서 데이터 구축 비용을 크게 낮추고, 설계 선택을 정량적으로 평가할 수 있는 기반을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기