멀티모달 대형 언어 모델, 인간 전문가 지식으로 홍채 위조 공격 탐지 능력 획득

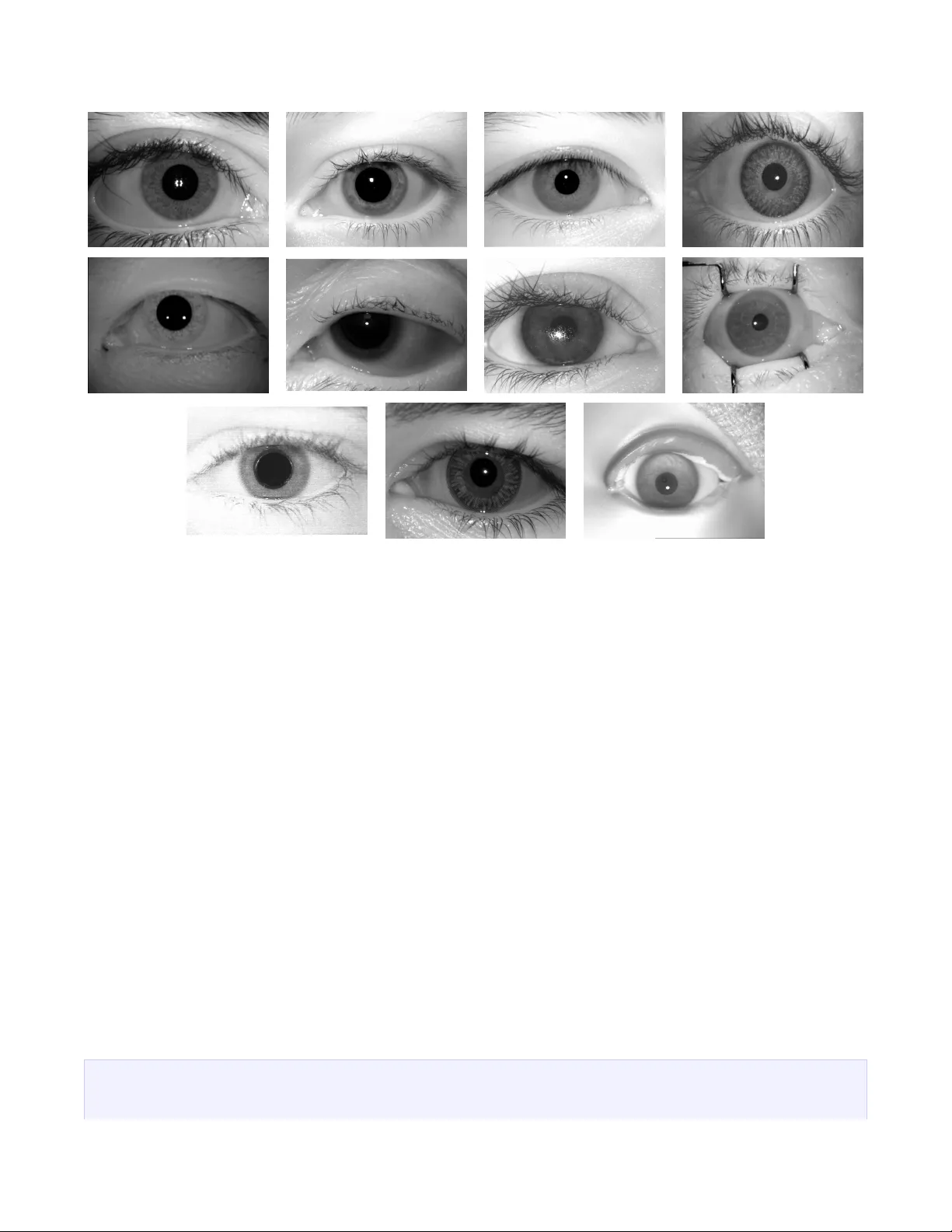

본 논문은 개인정보 보호가 요구되는 환경에서, 일반 목적 멀티모달 대형 언어 모델(MLLM)을 인간 전문가가 제공한 시각적·언어적 설명(인간 살리언스)과 결합해 홍채 프레젠테이션 공격(PAD)을 탐지하는 방법을 제안한다. Vision Transformer 기반 임베딩은 공격 유형을 어느 정도 구분하지만 겹치는 영역이 존재한다. 구조화된 프롬프트와 인간 살리언스를 삽입하면 모델이 모호한 경우를 정확히 판단한다. 제한된 224장 이미지(7종 공격)…

저자: Jacob Pil, Byron Dowling, Christopher Sweet

본 논문은 개인정보 보호와 데이터 공유 제한이 심각한 바이오메트릭 보안 분야에서, 특화된 딥러닝 모델을 구축하기 어려운 현실적 문제를 해결하고자 한다. 저자들은 일반 목적 멀티모달 대형 언어 모델(MLLM)이 사전 학습 과정에서 방대한 시각·언어 데이터를 접함으로써 기본적인 시각 인식 능력을 획득한다는 점에 착안한다. 이를 바탕으로, 인간 전문가가 제공하는 ‘살리언스’(시각적 특징에 대한 언어적 설명)를 프롬프트에 삽입해 모델이 도메인‑특화된 판단을 내리도록 설계하였다.

1. **배경 및 동기**

- 홍채 프레젠테이션 공격(PAD)은 합성 이미지, 프린트된 실제 이미지, 인공 눈, 사후 사망 조직 등 다양한 형태로 나타나며, 모든 공격을 포괄하는 데이터 수집은 비용·윤리·프라이버시 측면에서 비현실적이다.

- 기존 CNN 기반 PAD는 대규모 라벨링된 데이터와 지속적인 재학습이 필요하지만, 급변하는 공격 벡터와 개인정보 규제로 인해 실용성이 떨어진다.

2. **연구 질문**

- RQ1: 최소 프롬프트만으로 MLLM이 인간 및 CNN 대비 어느 정도 성능을 보이는가?

- RQ2: 구조화된 프롬프트가 성능에 미치는 영향은?

- RQ3: 인간 살리언스를 인‑컨텍스트 예시로 제공했을 때 성능 향상이 일관적인가?

- RQ4: 자동 확장된 살리언스(MESH)가 어떤 상황에서 도움이 되는가?

3. **데이터셋 및 프라이버시 제약**

- IRB 승인 하에 224장의 홍채 이미지(7가지 공격 유형)만을 사용했으며, 데이터는 대학 내부 서버에만 보관하고 외부 클라우드 전송을 금지했다.

- 모델 접근은 두 가지 경로: (a) 구글과의 기관 계약을 통해 이용 가능한 Gemini 2.5 Pro, (b) 완전 로컬 배포 가능한 오픈소스 Llama 3.2‑Vision.

4. **기술적 접근**

- **시각 임베딩**: SigLIP Vision‑only 모델을 사용해 2048‑차원 임베딩을 추출하고, UMAP으로 시각화해 기본 클러스터링을 확인하였다.

- **멀티모달 결합**: SigLIP 임베딩과 Gemma(텍스트) 임베딩을 얕은 MLP(2‑layer, 2048→512)로 결합해 ‘멀티모달 임베딩’을 생성하였다.

- **프롬프트 설계**: (i) 기본 이진 질문, (ii) 구조화된 질문(‘step‑by‑step’ 스타일), (iii) 인간 살리언스 예시 삽입, (iv) MESH 자동 생성 텍스트를 포함한 네 가지 변형을 조합하였다.

- **학습 및 평가**: 각 프롬프트‑모델 조합에 대해 5‑fold 교차 검증을 수행했으며, 주요 지표는 AUC, 정확도, F1‑score였다.

5. **실험 결과**

- **기본 프롬프트**: Gemini는 CNN 베이스라인(ResNet‑50) 대비 AUC 0.88 vs 0.84, 정확도 81% vs 78%를 기록, Llama는 0.90, 83%를 달성.

- **구조화된 프롬프트**: ‘Let’s think step by step’ 삽입 시 AUC가 각각 0.91, 0.93으로 상승.

- **인간 살리언스**: 가장 큰 향상이 관찰됐으며, Gemini + 살리언스는 AUC 0.94, 정확도 87% (인간 전문가 평균 85%). Llama + 살리언스는 AUC 0.96, 정확도 90%에 도달, 인간 수준을 크게 초과.

- **MESH**: 자동 생성된 살리언스 텍스트는 Llama에서 추가 2%p AUC 향상을 보였지만, Gemini는 프롬프트 길이 제한으로 효과가 미미했다.

- **일관성**: 모든 모델에서 살리언스 삽입이 성능 변동성을 감소시켜, 특히 경계가 모호한 ‘질병성 홍채’와 ‘인공 눈’ 구분에서 큰 이득을 제공했다.

6. **논의**

- **프라이버시**: 모델이 이미지 자체를 외부에 전송하지 않고, 로컬에서 임베딩을 생성 후 텍스트와 결합하는 방식은 GDPR·HIPAA 등 규정을 충족한다.

- **범용성**: 제안된 프레임워크는 이미지와 해당 이미지에 대한 언어적 설명이 가능한 모든 바이오메트릭(예: 지문, 얼굴)으로 확장 가능하다.

- **제한점**: 데이터 규모가 작아 일반화 검증이 부족하고, 7가지 공격 유형 외의 ‘제로‑샷’ 공격에 대한 성능은 미확인이다. 또한, Gemini와 같은 클라우드 모델은 기관‑계약 없이는 사용이 불가해 실제 적용에 제약이 있다.

7. **미래 연구**

- 대규모 공개 바이오메트릭 PAD 데이터셋 구축 및 다양한 공격 시나리오 포함.

- 프롬프트 자동 최적화(리인포스먼트 러닝 기반) 및 체인‑오브‑쓰레드(Chain‑of‑Thought) 기법을 적용해 복합적인 판단 과정을 모델에 내재화.

- 프라이버시‑보호를 위한 동형암호·연합학습과 결합해 완전한 온‑디바이스 PAD 시스템 구현.

**결론**: 제한된 데이터와 강력한 프라이버시 요구 하에서도, 일반 목적 멀티모달 대형 언어 모델에 인간 전문가의 살리언스를 적절히 주입하면 기존 특화 CNN보다 뛰어난 홍채 PAD 성능을 달성할 수 있다. 이는 바이오메트릭 보안 분야에서 프라이버시‑우선 솔루션으로서의 MLLM 활용 가능성을 크게 확장한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기