360도 위쪽 피쉬아이 카메라 기반 다중인물 시선 추정 GazeOnce360

초록

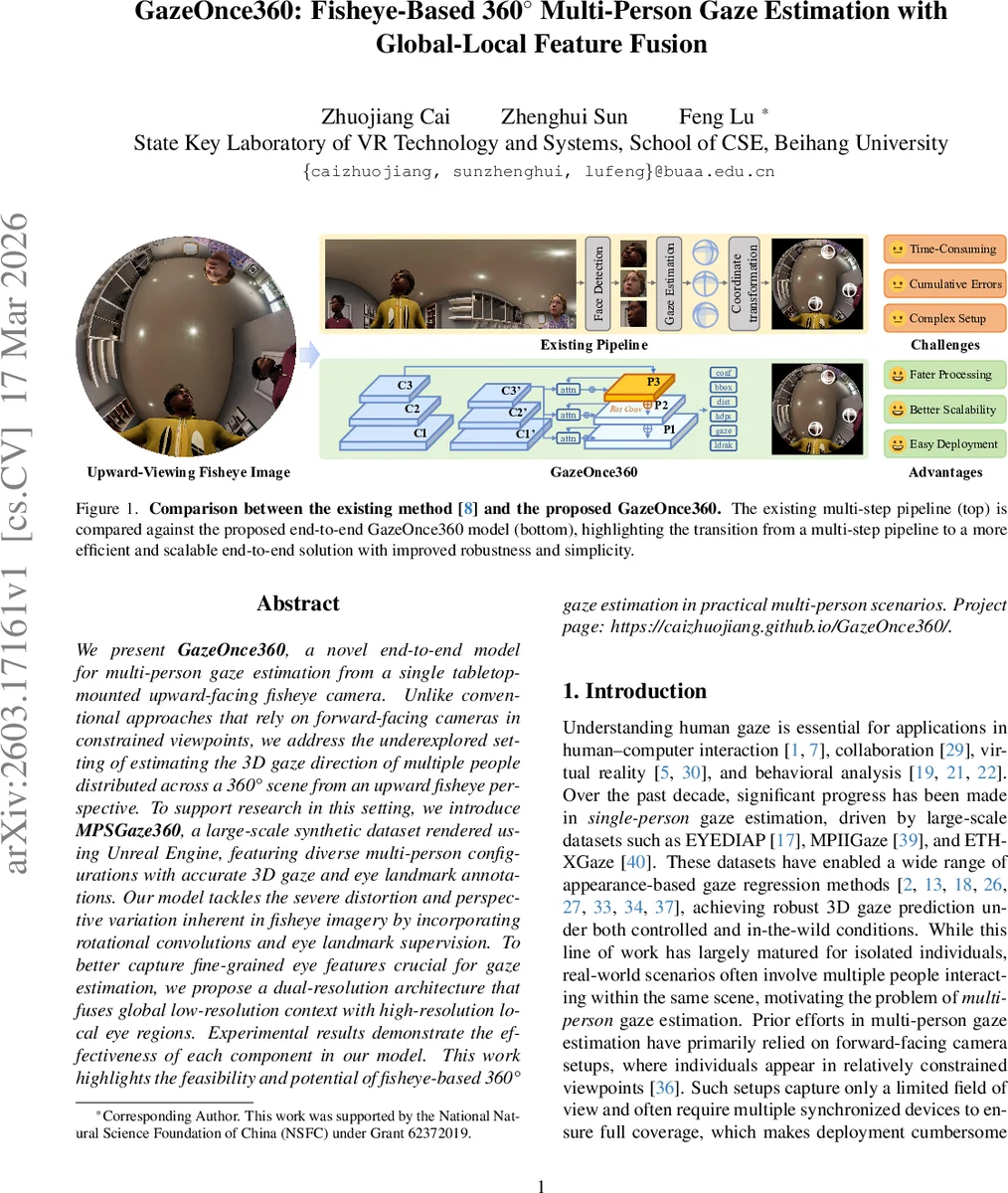

GazeOnce360은 테이블 위에 설치된 위쪽을 향한 피쉬아이 카메라 한 대만으로 360° 전방위에 존재하는 여러 사람의 3D 시선 방향을 실시간으로 추정하는 엔드‑투‑엔드 모델이다. 회전 컨볼루션, 눈 랜드마크 다중 과제 학습, 그리고 전역‑국부 이중 해상도 피처 융합이라는 세 가지 핵심 설계를 통해 피쉬아이 이미지의 강한 왜곡과 다양한 시점 변화를 효과적으로 보정한다. 또한, Unreal Engine 5와 MetaHuman을 활용해 다중인물 구성을 포함한 대규모 합성 데이터셋 MPSGaze360을 구축해 학습 및 평가 기반을 제공한다.

상세 분석

본 논문은 기존의 전방향 카메라 기반 다중인물 시선 추정이 갖는 시야 제한과 다중 디바이스 필요성을 극복하고자, 위쪽을 향한 피쉬아이 카메라 한 대만으로 360° 전방위 시선 정보를 획득하는 새로운 패러다임을 제시한다. 핵심 기술은 크게 세 부분으로 나뉜다. 첫째, 피쉬아이 렌즈 특유의 방사형 왜곡을 보정하기 위해 회전 컨볼루션(Rotational Convolution)을 도입하였다. 이는 기존 2D 컨볼루션 커널을 0°, 90°, 180°, 270° 네 방향으로 회전시켜 각각의 응답을 평균화함으로써 회전 불변성을 강화하고, 특히 상하 방향에서 급격히 변하는 시야각에 강인한 특징 추출이 가능하도록 한다. 둘째, 눈 랜드마크와 얼굴 바운딩 박스, 머리 자세, 거리 등 여러 부가 정보를 동시에 예측하는 다중 과제(Multi‑Task) 학습을 적용하였다. 눈 랜드마크는 미세한 안구 움직임을 직접 지도함으로써 시선 회귀의 정밀도를 높이고, 바운딩 박스와 머리 자세는 전역 컨텍스트와 국부 피처를 효과적으로 연결하는 역할을 한다. 셋째, 이중 해상도 구조를 채택하였다. 저해상도 전역 브랜치는 전체 피쉬아이 이미지에서 광범위한 공간 정보를 추출하고, 얼굴 검출 결과를 바탕으로 고해상도 로컬 브랜치가 각 얼굴 영역을 크롭해 세밀한 눈 특징을 학습한다. 두 브랜치의 피처는 교차‑어텐션(Cross‑Attention) 모듈을 통해 상호 보완적으로 융합되며, 최종적으로 시선 벡터와 부가 과제 출력이 동시에 도출된다. 학습 단계에서는 실제 바운딩 박스를 사용해 로컬 브랜치를 정확히 정렬하지만, 추론 시에는 모델이 자체적으로 검출한 박스를 이용해 완전한 엔드‑투‑엔드 파이프라인을 구현한다. 데이터 측면에서는 Unreal Engine 5와 MetaHuman을 활용해 다양한 인종·연령·복장·조명 조건을 포함한 23,496장의 합성 피쉬아이 이미지와 1~7명의 얼굴이 동시에 존재하는 장면을 생성하였다. 각 프레임에는 3D 시선, 3D 머리 자세, 2D 눈·얼굴 랜드마크, 거리 등 정밀한 주석이 자동으로 제공되어, 실제 환경에서 수집하기 어려운 대규모 라벨링 문제를 해결한다. 실험 결과, 회전 컨볼루션, 다중 과제 학습, 이중 해상도 융합 각각이 성능 향상에 기여함을 정량적으로 입증했으며, 실제 촬영된 피쉬아이 이미지에서도 좋은 일반화 능력을 보였다. 전체적으로 본 연구는 피쉬아이 기반 360° 다중인물 시선 추정이라는 새로운 응용 분야를 개척하고, 실시간 로봇·스마트 환경·협업 작업 등에서의 적용 가능성을 크게 확대한다.

댓글 및 학술 토론

Loading comments...

의견 남기기