회귀 인식 강화학습으로 LLM 평가자를 최적화

LLM을 점수 매기는 평가자로 활용할 때, 기존 RL은 0‑1 보상만 사용해 순서 정보를 무시한다. REAL은 정책‑의존 회귀 보상을 일반화된 정책 그라디언트로 최적화해 CoT 탐색과 최종 점수 정제를 동시에 학습한다. Pearson·Spearman 상관계수를 직접 최적화하는 이론적 근거와 8B‑32B 규모 모델에 대한 실험 결과를 통해 SFT 기반 회귀 방법과 기존 RL을 크게 앞선다.

저자: Yasi Zhang, Tianyu Chen, Mingyuan Zhou

본 논문은 대형 언어 모델(LLM)을 “LLM‑as‑a‑Judge”라는 평가자로 활용할 때 발생하는 핵심 문제를 짚고, 이를 해결하기 위한 새로운 강화학습 프레임워크인 REAL(Regression‑Aware Reinforcement Learning)을 제안한다.

**배경 및 문제점**

LLM‑as‑a‑Judge는 모델이 텍스트에 대해 수치 점수를 매기는 작업으로, 본질적으로 회귀 문제이다. 그러나 기존 RL 기반 포스트‑트레이닝은 0‑1 정확도 보상만을 사용해 예측값 간의 순서·거리 정보를 무시한다. 이로 인해 예측값 4와 1 사이의 차이가 5와 1 사이의 차이와 동일하게 취급돼 Pearson·Spearman 상관계수와 같은 평가 지표가 제대로 최적화되지 않는다. 반면, 최근 회귀‑인식 SFT 방법(RAFT, TRACT)은 손실 함수에 제곱오차를 도입해 순서 정보를 반영하지만, 정적인 지도학습에 머물러 모델이 스스로 생성한 CoT(Chain‑of‑Thought) 경로를 탐색·수정할 메커니즘이 없다.

**REAL의 설계**

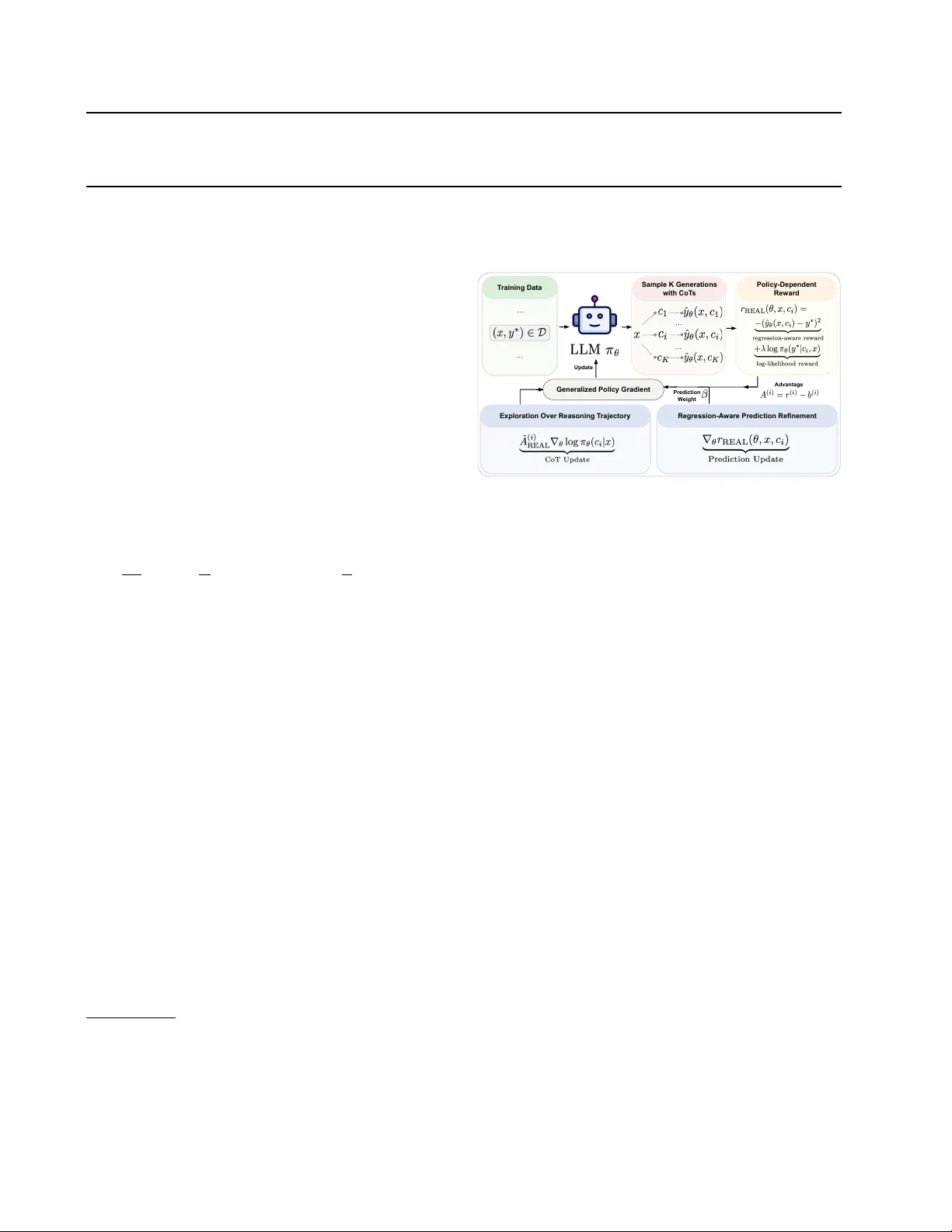

REAL은 두 가지 혁신적인 요소를 결합한다. 첫째, **정책‑의존 회귀 보상**을 정의한다. 보상 함수 r_REAL(θ, x, c) = –(ŷ_θ(x,c) – y*)² + λ·log π_θ(y*|x,c)는 현재 파라미터 θ에 의해 계산되는 예측값 ŷ_θ와 로그 확률을 포함한다. 둘째, 이 보상이 파라미터에 의존한다는 점을 고려해 **일반화된 정책 그라디언트**(Generalized Policy Gradient)를 적용한다. 이 그라디언트는 기존 REINFORCE 식에서 ∇_θ r = 0이라는 가정을 제거하고, 보상의 파라미터 미분을 명시적으로 포함한다.

**그라디언트 분해**

일반화된 정책 그라디언트는 두 개의 상호 보완적인 항으로 분해된다.

1. **CoT 탐색 항**: ∇_θ log π_θ(c|x)·r_REAL – 모델이 다양한 추론 경로를 시도하도록 유도한다.

2. **예측 정제 항**: ∇_θ ŷ_θ·(ŷ_θ – y*) – 최종 점수 예측을 회귀 손실에 직접 연결한다.

이러한 구조는 “추론 탐색 + 수치 정확도 정제”라는 두 목표를 하나의 학습 루프에서 동시에 달성하게 만든다.

**이론적 근거**

논문은 제 3절에서 Lemma 3.1을 통해 **제곱오차 손실이 Pearson 상관계수를 최적화하는 충분조건**임을 증명한다. 조건부 기대값 μ(x,c)=E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기