통합 인체 파라메트릭 모델 SOMA

SOMA는 SMPL, SMPL‑X, MHR, Anny, GarmentMeasurements 등 서로 다른 형태와 스켈레톤을 가진 5개 파라메트릭 인체 모델을 하나의 공통 토폴로지와 리깅으로 연결한다. 메쉬 토폴로지 추상화, 스켈레톤 추상화, 포즈 추상화라는 세 단계로 구성된 파이프라인은 각 모델을 O(1) 시간에 변환하고, 전체 흐름을 완전 미분 가능하게 만든다. 이를 통해 기존의 O(M²) 어댑터 문제를 O(M)으로 축소하고, 다양한 아이덴티…

저자: Jun Saito, Jiefeng Li, Michael de Ruyter

2026년 발표된 “SOMA: Unifying Parametric Human Body Models” 논문은 현재 인간 재구성·애니메이션·시뮬레이션 분야에서 널리 사용되는 다섯 개의 파라메트릭 인체 모델(SMPL, SMPL‑X, MHR, Anny, GarmentMeasurements)을 하나의 통합 프레임워크로 묶는 방법을 제시한다. 각 모델은 메쉬 토폴로지, 관절 계층, 형태 파라미터, 단위 체계가 서로 달라, 서로 다른 모델을 동시에 활용하려면 모델‑쌍마다 별도의 어댑터를 구현해야 하는 O(M²) 복잡도가 발생한다. SOMA는 이를 “공통 토폴로지 + 공통 리깅”이라는 피벗을 중심으로 재구성함으로써, 백엔드 모델당 하나의 어댑터만 구현하면 언제든지 자유롭게 조합할 수 있는 O(M) 구조를 만든다.

SOMA의 파이프라인은 크게 세 단계로 나뉜다. 첫 번째 단계인 메쉬 토폴로지 추상화는 각 백엔드 모델의 중립(뉴트럴) 메쉬와 SOMA 표준 메쉬 사이에 3‑D 바리센트릭 좌표를 사전 계산한다. 구체적으로, SOMA 메쉬의 각 정점에 대해 가장 가까운 소스 메쉬 삼각형을 찾고, 해당 삼각형을 법선 방향으로 확장해 4‑점 테트라헤드론을 만든 뒤, 3×3 선형 시스템을 풀어 4‑차원 바리센트릭 가중치를 얻는다. 이 가중치와 삼각형 인덱스는 초기화 시점에 고정 버퍼에 저장되며, 런타임에서는 소스 메쉬가 형태 파라미터 β에 따라 변형될 때, 저장된 가중치를 이용해 단순 가중합 연산만으로 SOMA 메쉬 정점을 재구성한다. 이 과정은 소스 정점 수 Nₛ와 무관하게 O(Nₕ) 시간에 수행된다.

두 번째 단계인 스켈레톤 추상화는 공유된 메쉬 위에 77개의 관절을 갖는 통합 리깅을 피팅한다. 관절 위치는 각 관절에 할당된 스키닝 가중치가 비‑제로인 정점 집합 𝒩ₖ를 이용해 라디얼 베이시스 함수(RBF) 회귀기로 사전 학습된 모델에 입력한다. RBF는 원본 바인드‑포즈 메쉬 정점 좌표를 기반으로 하며, 관절마다 별도의 파라미터를 갖는다. 회전은 관절 위치와 부모 관절 위치를 이용해 프로크루스테스 정렬을 수행하고, 결과 행렬을 뉴턴‑슐츠 정규화 절차를 통해 즉시 직교화한다. 중요한 점은 이 두 연산이 모두 닫힌 형태(closed‑form)이며, 포즈가 적용된 형태에서도 동일하게 적용될 수 있다는 것이다. 따라서 기존의 “rest‑pose 전용 관절 회귀기”와 달리, 임의의 포즈 상태에서도 정확한 관절 변환을 얻을 수 있다.

세 번째 단계인 포즈 추상화는 LBS(Linear Blend Skinning) 파이프라인을 역전시켜, 어떤 백엔드 모델의 포즈된 정점 집합으로부터 직접 SOMA 관절 회전을 복원한다. 역 LBS는 정점‑관절 가중치 행렬을 이용해 관절 회전 행렬을 추정하는 선형 시스템을 풀고, 얻어진 회전 행렬을 뉴턴‑슐츠 절차로 직교화한다. 이 과정은 모델‑특정 리타게팅 없이도 SMPL, SMPL‑X, MHR, Anny 등에서 얻은 포즈 데이터를 그대로 SOMA 리깅에 적용할 수 있게 만든다.

SOMA는 또한 단일 MLP 기반 포즈 보정 네트워크를 도입한다. 기존 LBS는 관절 간 간섭이나 비선형 변형을 완전히 설명하지 못하는데, 보정 네트워크는 각 포즈에 대해 정점 변위를 학습해 이러한 아티팩트를 보정한다. 이 보정 모델은 하나만 학습하면 모든 백엔드에 적용 가능하므로, 모델‑별 보정 학습 비용을 크게 절감한다.

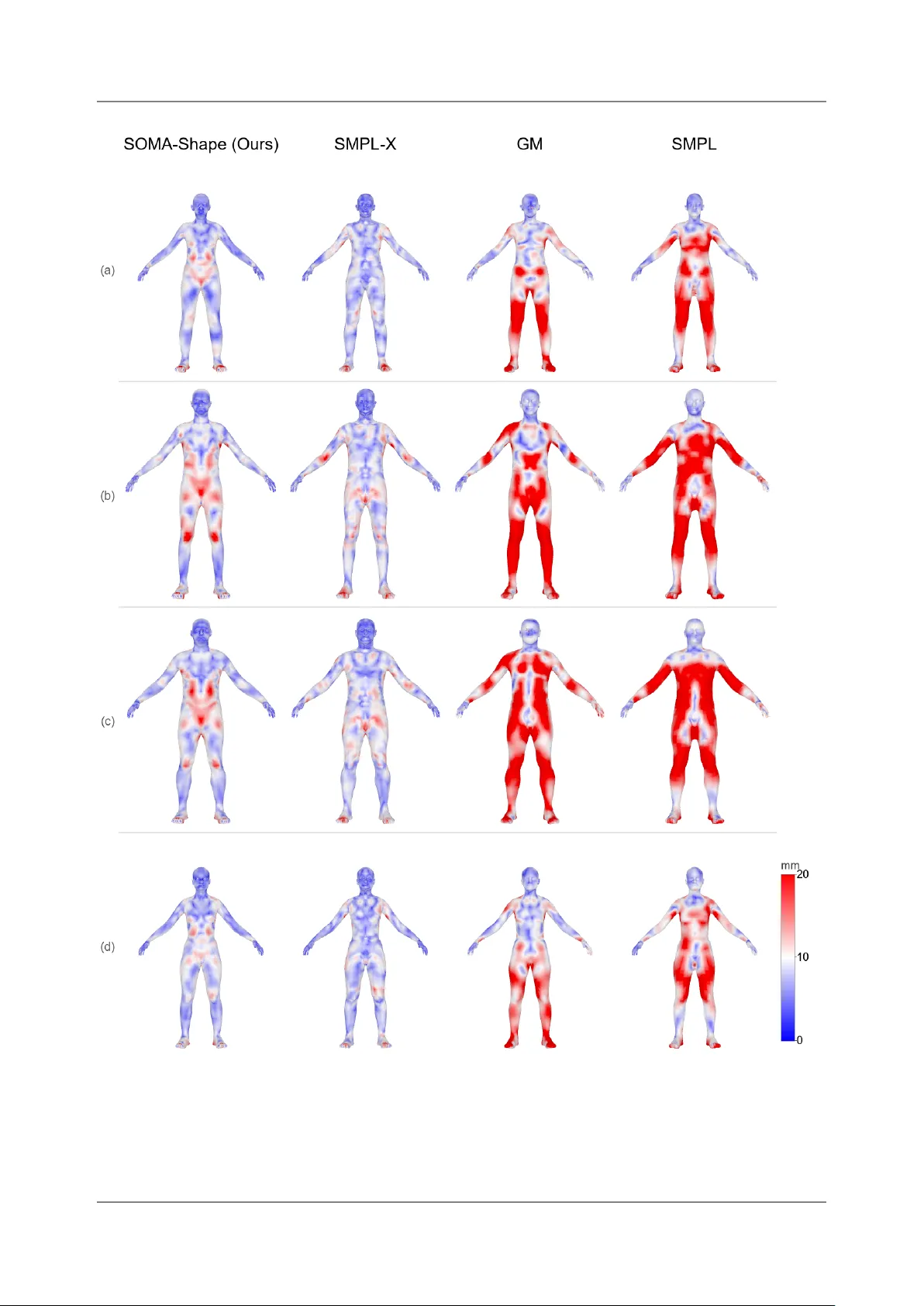

학습 측면에서 SOMA‑Shape는 자체 PCA 형태 공간을 갖는다. 9,326개의 SizeUSA 스캔, 303개의 Triplegangers 포토그래메트리 스캔, 그리고 GarmentMeasurements에서 추출한 샘플을 40/40/20 비율로 혼합해 Incremental PCA를 수행, 128개의 주성분을 확보한다. 이렇게 구축된 형태 공간은 SMPL‑X(300 PC)보다 저차원임에도 다양한 체형을 충분히 표현한다.

전체 파이프라인은 NVIDIA‑Warp를 활용한 GPU 가속 구현으로, 메쉬 변환·스켈레톤 피팅·포즈 역변환을 모두 실시간 수준(수십 밀리초 이하)으로 수행한다. 모든 연산이 미분 가능하도록 설계돼 PyTorch·TensorFlow와 같은 딥러닝 프레임워크와 자연스럽게 연동될 수 있다.

SOMA는 공개된 여러 프로젝트와 연계된다. SOMA Retargeter, GEM, Kimodo, BONES‑SEED, ProtoMotions, GEAR SONIC 등은 모두 SOMA를 기반으로 다양한 인간 애니메이션·시뮬레이션 파이프라인을 구현한다. 이를 통해 연구자는 특정 아이덴티티 모델에 얽매이지 않고, 원하는 형태와 포즈 데이터를 자유롭게 조합해 새로운 애플리케이션을 빠르게 프로토타이핑할 수 있다.

결론적으로, SOMA는 파라메트릭 인체 모델 간의 구조적 불일치를 근본적으로 해소하고, O(M) 어댑터 구조와 완전 미분 가능·GPU 가속 파이프라인을 제공함으로써 인간 디지털 트윈 연구와 산업 응용에 획기적인 생산성을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기