관계 인식 확산 비대칭 그래프 대조 학습 기반 추천 시스템

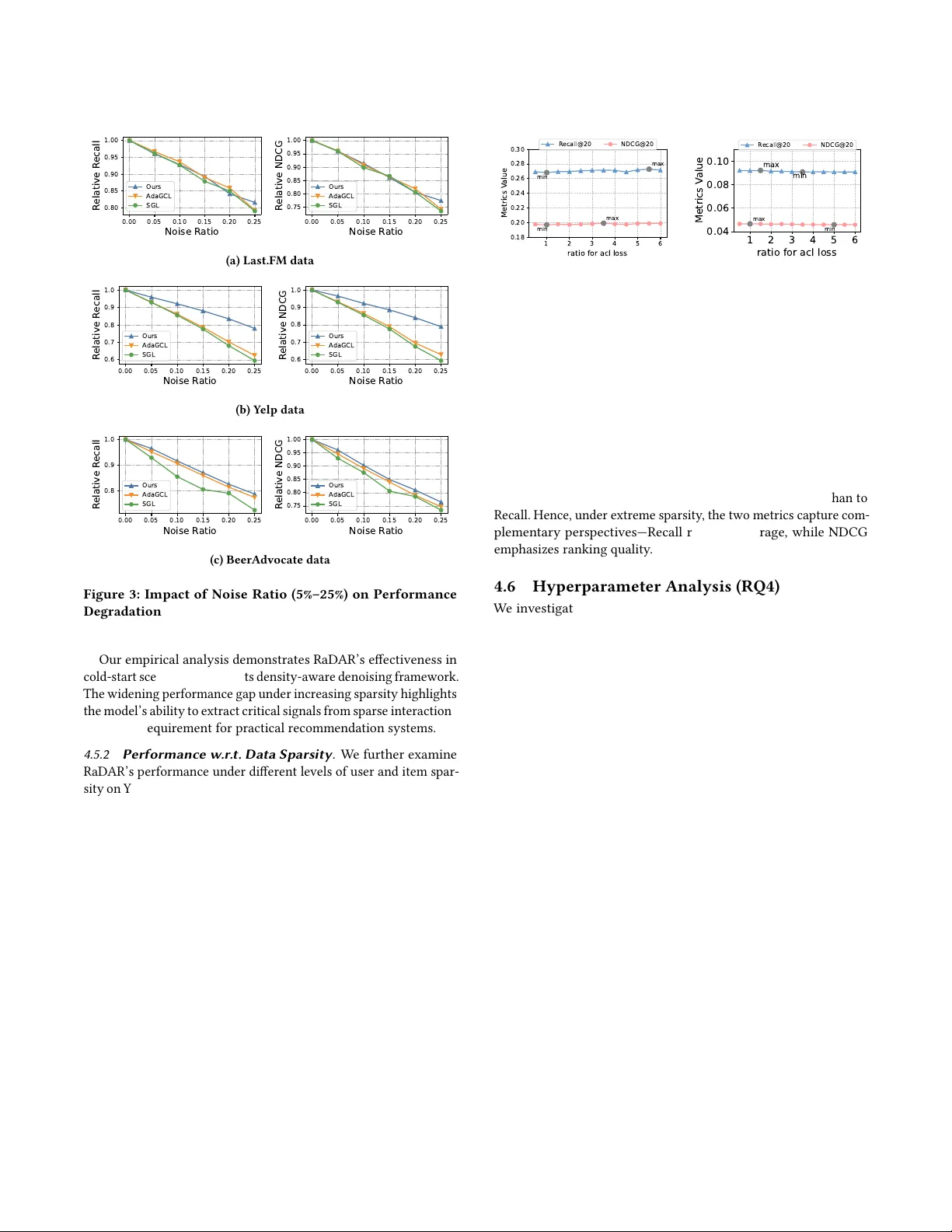

RaDAR는 그래프 생성 모델과 관계‑인식 디노이징 모델을 결합한 두 가지 뷰 생성 방식을 도입하고, 비대칭 대조 학습과 확산‑가이드 증강을 통해 희소·노이즈가 많은 사용자‑아이템 그래프에서 구조적 의미와 관계 표현을 동시에 보존한다. 실험 결과, 기존 GNN‑기반 대조 학습 모델들을 크게 앞서며 특히 고희소·고노이즈 상황에서 강인함을 보인다.

저자: Yixuan Huang, Jiawei Chen, Shengfan Zhang

본 논문은 협업 필터링(CF) 기반 추천 시스템에서 그래프 신경망(GNN)과 그래프 대조 학습(GCL)의 결합이 가져오는 두 가지 핵심 한계, 즉 (1) 무작위 엣지·노드 드롭아웃에 의한 구조 의미 손실과 (2) 데이터 희소성으로 인한 고차 관계 전파 부족을 해결하고자 한다. 이를 위해 제안된 RaDAR(Relation‑aware Diffusion‑Asymmetric Graph Contrastive Learning) 프레임워크는 두 개의 상보적인 뷰 생성 메커니즘을 도입한다. 첫 번째는 전역 구조를 포착하는 그래프 생성 모델(VGAE)이며, 두 번째는 관계‑인식 디노이징 모델로 잡음이 섞인 엣지를 정제한다.

**핵심 혁신 1 – 비대칭 대조 학습과 글로벌 네거티브 샘플링**

전통적인 대조 학습은 두 뷰를 대칭적으로 처리해 동일한 임베딩을 끌어당기지만, 이는 잡음이 포함된 뷰에서도 동일하게 최적화돼 의미 정렬을 약화시킨다. RaDAR는 한 뷰에 ‘포워드 노이즈’를, 다른 뷰에 ‘리버스 노이즈’를 적용해 비대칭적인 손실을 설계한다. 또한, 전체 그래프에서 무작위로 추출한 글로벌 네거티브 샘플을 사용해 의미가 다른 노드들을 명시적으로 구분함으로써, 잡음 억제와 의미 정렬을 동시에 달성한다.

**핵심 혁신 2 – 확산‑가이드 증강**

확산 모델(Diffusion Model)의 노이즈‑투‑데이터 생성 메커니즘을 차용해, 임베딩 공간에 단계적 Gaussian 노이즈를 주입하고 역확산 네트워크가 이를 복원하도록 학습한다. 이 과정은 DDPM과 유사하게 ELBO를 최대화하는 형태로 구현되며, 노이즈 스케줄러(선형 α_t)와 역전파 MLP를 통해 각 단계에서 최적의 복원 능력을 갖춘다. 결과적으로, 원본 그래프의 구조적 특성을 보존하면서도 노이즈에 대한 강인성을 획득한다.

**핵심 혁신 3 – 관계‑인식 엣지 정제**

각 엣지는 사용자·아이템 간의 관계 특성(예: 상호작용 강도, 메타데이터)과 현재 노드 임베딩을 입력으로 하는 어댑티브 게이트(g)와 어텐션 가중치(α_ij)를 통해 동적으로 가중치가 부여된다. 마스크 M_l은 Bernoulli 분포를 concrete distribution으로 근사해 미분 가능하게 만들고, sparsity 파라미터 τ를 통해 전체 마스크의 밀도를 제어한다. 이렇게 정제된 그래프는 잡음이 제거된 깨끗한 뷰로 활용되어 대조 학습에 기여한다.

**모델 아키텍처**

1. **임베딩 전파**: LightGCN 스타일의 다층 메시지 전달을 통해 기본 사용자·아이템 임베딩을 얻는다. 정규화된 인접 행렬 ˜A를 이용해 각 레이어에서 E_u^l = ˜A E_v^{l‑1} + E_u^{l‑1}, E_v^l = ˜A^T E_u^{l‑1} + E_v^{l‑1} 형태로 업데이트하고, 모든 레이어의 임베딩을 합산해 최종 표현을 만든다.

2. **그래프 생성 뷰**: VGAE(Variational Graph Auto‑Encoder)를 사용해 변분 인코더(GCN)와 디코더(가우시안 샘플링)로 그래프 구조를 재구성한다. KL‑divergence, 재구성 손실, BPR 손실을 결합한 복합 목표를 최적화한다.

3. **관계‑인식 디노이징 뷰**: 어댑티브 게이트와 concrete distribution 기반 마스크를 통해 엣지 보존 확률을 학습한다. 마스크된 인접 행렬 A_l = A ⊙ M_l을 사용해 디노이징된 그래프를 만든다. 이 과정에서 L_c(Concrete loss)와 BPR 손실, L2 정규화를 포함한다.

4. **확산‑가이드 증강**: 임베딩 h_L을 초기 상태로 두고, t 단계마다 𝜒_t = √ᾱ_t 𝜒_0 + √(1‑ᾱ_t) ε (ε∼N(0,I)) 형태로 노이즈를 주입한다. 역확산 네트워크 ˆ𝜒_θ(·)는 MLP로 구현돼, 각 단계에서 원본 임베딩을 복원한다. ELBO 기반 손실 L_elbo = E_{t∼U(1,T)}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기