시각적 표현 정렬을 위한 공동 디노이징 V‑Co 연구

V‑Co는 픽셀‑공간 확산 모델에 사전학습된 시각 인코더(DINOv2)의 특징을 직접 결합하는 공동 디노이징 방식을 체계적으로 분석한다. 네 가지 핵심 요소—완전한 듀얼‑스트림 구조, 구조적 마스킹 기반 CFG, 퍼셉추얼‑드리프팅 하이브리드 손실, RMS 기반 특징 스케일링—를 조합한 레시피가 제시되며, ImageNet‑256 실험에서 기존 픽셀‑공간 확산 모델 및 최신 공동 디노이징 방법들을 능가한다.

저자: Han Lin, Xichen Pan, Zun Wang

본 연구는 픽셀‑공간 확산 모델이 고해상도 이미지 생성에서 뛰어난 성능을 보이지만, 의미적 감독이 약해 고수준 시각 구조를 충분히 포착하지 못한다는 문제점을 출발점으로 삼는다. 최근 REPA와 같은 표현 정렬 기법이 사전학습된 비전 인코더와의 정합을 통해 성능을 끌어올릴 수 있음을 보였지만, 이러한 방법들은 설계 선택이 복합적으로 얽혀 있어 핵심 요인을 파악하기 어렵다. 이를 해결하고자 저자들은 ‘V‑Co’라는 통합 프레임워크를 제안한다. V‑Co는 JiT(Just‑in‑Time) 트랜스포머 기반의 픽셀‑공간 확산 모델에 DINOv2와 같은 강력한 사전학습 비전 인코더를 고정(frozen)시켜, 이미지와 의미 특징을 동시에 노이즈화하고 공동으로 디노이징한다.

핵심 연구 질문은 네 가지이다. (i) 어떤 아키텍처가 픽셀과 의미 스트림 간의 상호작용을 최적화하는가? (ii) CFG를 위한 무조건적 예측을 어떻게 정의해야 하는가? (iii) 의미 스트림에 대한 보조 손실로 어떤 형태가 가장 효과적인가? (iv) 두 스트림의 스케일 차이를 어떻게 보정해야 하는가?

첫 번째 질문에 대해, 저자들은 단일 스트림(공유 백본)과 듀얼 스트림(별도 정규화·MLP·QKV) 두 가지 설계를 비교한다. 실험 결과, 토큰‑레벨 결합을 사용한 듀얼 스트림이 가장 높은 FID 감소를 보였으며, 이는 의미와 픽셀 각각의 특화된 처리를 유지하면서도 공동 어텐션을 통해 유연하게 정보를 교환할 수 있기 때문이다.

두 번째 질문에서는 기존 CFG가 입력 레벨 드롭아웃을 이용해 무조건적 예측을 만든다. 그러나 공동 디노이징 상황에서는 의미‑투‑픽셀 경로를 마스킹해 명시적으로 무조건적 흐름을 정의하는 것이 더 효과적이었다. 이 구조적 마스킹은 의미 흐름을 차단한 상태에서 픽셀만을 예측하게 함으로써, 가이드 스케일을 조절할 때 더 안정적인 신호를 제공한다.

세 번째 질문에 대한 답으로, 저자들은 인스턴스‑레벨 정렬(예: REPA loss)과 분포‑레벨 정규화(예: 퍼셉추얼 손실)를 결합한 ‘퍼셉추얼‑드리프팅 하이브리드 손실’을 제안한다. 이 손실은 의미 특징이 이미지와 일치하도록 강제하면서도, 전체 특징 분포가 자연스러운 형태를 유지하도록 유도한다. 실험에서 이 하이브리드 손실이 단일 REPA 손실보다 일관되게 높은 샘플 품질을 제공한다.

네 번째 질문에서는 두 스트림의 RMS 차이가 학습을 불안정하게 만든다는 점을 발견하고, RMS 기반 스케일링을 적용한다. 이는 의미 스트림의 평균·분산을 픽셀 스트림에 맞추어 SNR을 동일하게 만들며, 수학적으로는 의미 스트림의 노이즈 스케줄을 조정하는 것과 동등한 효과를 가진다.

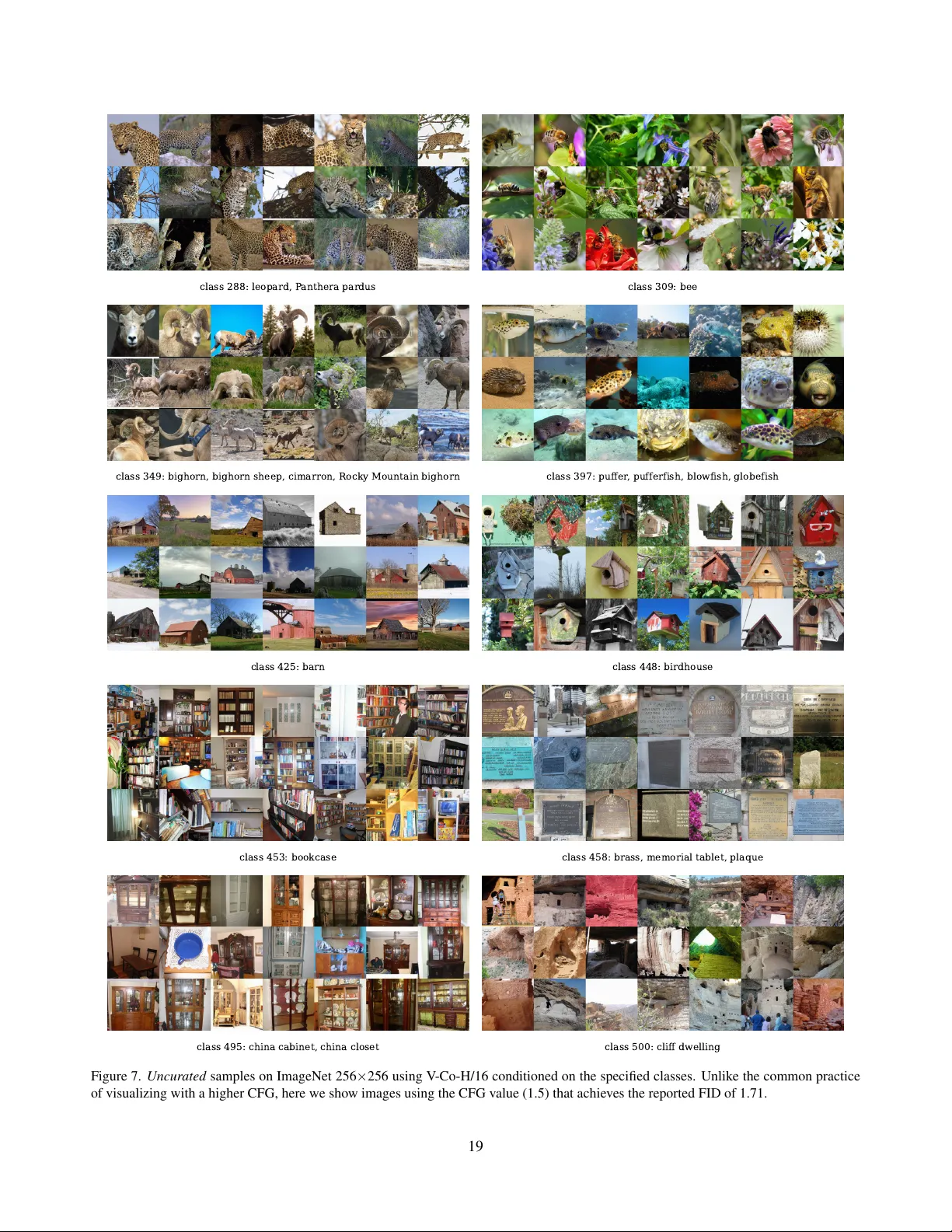

이 네 가지 요소를 차례대로 적용한 V‑Co 레시피는 ImageNet‑256 실험에서 눈에 띄는 성능 향상을 보였다. 동일 파라미터 규모의 JiT‑B/16 대비 FID 2.33 → 2.33(동일) → 1.71(V‑Co‑H/16)까지 개선했으며, 파라미터가 260M인 V‑Co‑B/16은 459M 파라미터 JiT‑L/16과 거의 동등한 성능을 기록했다. 또한 500~300 epoch 훈련만으로도 2B 파라미터 규모의 JiT‑G/16을 능가하는 결과를 얻었다. 이는 공동 디노이징이 의미 정보를 효율적으로 주입하면서도 학습 효율성을 크게 높일 수 있음을 증명한다.

마지막으로, 저자들은 V‑Co가 픽셀‑공간 확산 모델에 사전학습된 시각 인코더를 통합하는 실용적인 설계 가이드라인을 제공함으로써, 향후 다양한 모달리티와의 공동 디노이징 연구에 기반이 될 수 있음을 강조한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기