언어유사성으로 저자원 번역 가이드

본 논문은 대규모 언어 모델(LLM)을 파라미터 업데이트 없이 저자원 언어 번역에 적용하기 위해, 언어학적으로 가까운 피벗 언어와 소수의 인‑컨텍스트 예시를 결합한 프롬프트 기법을 제안한다. 콘카니와 튀니지 아라비아어를 대상으로 실험했으며, 피벗 기반 프롬프트가 특정 상황에서 번역 품질을 modest하게 향상시키지만, 언어 간 유사성, 모델 내 어휘 커버리지, 예시 선택 등에 크게 좌우된다는 점을 확인했다.

저자: Aishwarya Ramasethu, Niyathi Allu, Rohin Garg

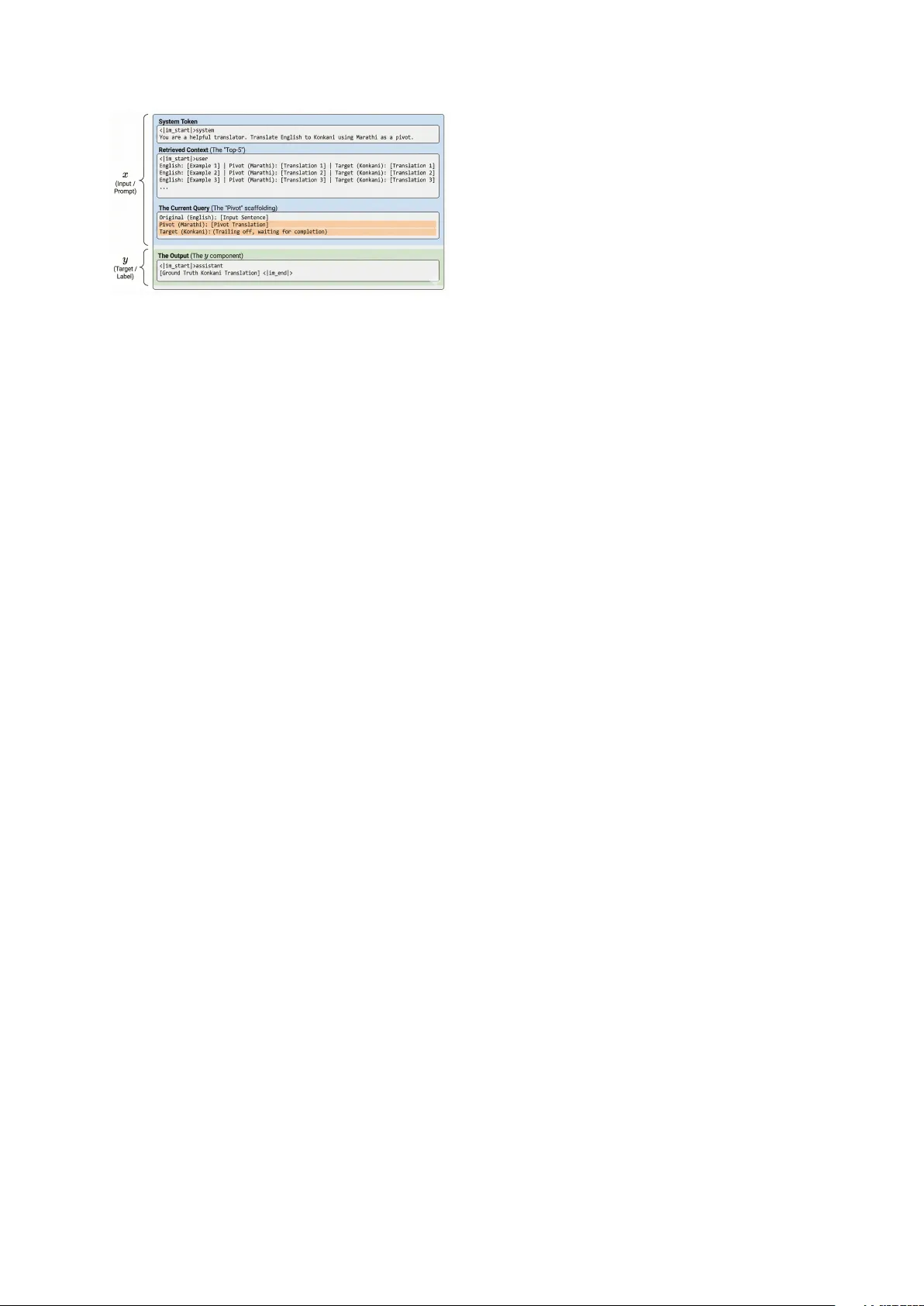

본 논문은 “언어유사성으로 저자원 번역 가이드”라는 질문에 답하고자, 대규모 언어 모델(LLM)을 파라미터 업데이트 없이 저자원 언어 번역에 적용하는 새로운 인‑컨텍스트 학습(ICL) 프레임워크를 제안한다. 핵심 아이디어는 두 단계로 구성된다. 첫째, 언어학적으로 가까운 피벗 언어와 목표 언어 사이의 삼중항(영어‑피벗‑목표)을 사전 구축하고, 의미적 임베딩(MiniLM‑L12‑v2)으로 색인한다. 둘째, 테스트 시 입력 영어 문장의 임베딩을 기반으로 가장 유사한 k개의 삼중항을 검색하고, 이를 “영어‑피벗‑목표” 형태의 예시와 함께 피벗 번역 자체를 프롬프트에 삽입한다. 이렇게 구성된 프롬프트는 ChatML 형식으로 LLM에 전달되며, 모델은 추가적인 파인튜닝 없이 바로 번역을 생성한다.

실험 대상은 인도 서부의 콘카니(Konkani)와 튀니지 아라비아어(Tunisian Arabic)라는 두 저자원 언어이며, 각각 마라티어와 현대 표준 아라비아어(MSA)를 피벗 언어로 선택했다. 두 언어 모두 비라틴 스크립트를 사용하고, 기존 다국어 번역 모델(NLLB 등)에서 지원이 제한적이다. 데이터는 각각 약 800~900개의 트레이닝 삼중항과 100~200개의 테스트 샘플로 구성했으며, 이는 실제 저자원 상황을 모사하기 위한 의도적인 제한이다.

모델로는 Unbabel Tower‑Instruct‑7B와 Llama 3‑8B 기반 HerMES‑2‑Pro를 사용했으며, 두 모델 모두 다국어 사전 학습은 했지만 목표 언어에 대한 직접적인 학습은 거의 이루어지지 않았다. 실험에서는 (1) 피벗‑보강 프롬프트 vs. 직접 프롬프트, (2) 피벗 포함 여부 vs. 피벗 제외, (3) k값(예시 수) 변화, (4) 예시 선택 전략(의미적 유사도 기반 vs. 무작위) 등을 체계적으로 비교했다.

주요 결과는 다음과 같다. 피벗‑보강 프롬프트는 chrF++ 기준으로 평균 1.2~2.5 포인트 상승했으며, 특히 타깃 언어가 모델 어휘에 희박하게 존재하는 경우(튜니지 아라비아어) 효과가 두드러졌다. 반면, 콘카니처럼 피벗과 타깃이 문자·어휘적으로 매우 유사한 경우에는 이득이 미미하거나 오히려 성능이 감소했다. 또한, 예시를 의미적 유사도 상위 k개로 선택했을 때와 무작위 선택했을 때의 차이가 크게 나타났으며, 고품질·고유사도 예시가 없으면 피벗 효과가 사라지는 것을 확인했다. k값이 증가할수록 약간의 성능 향상이 있었지만, 일정 수준을 넘어선 경우 오히려 노이즈가 증가해 성능이 정체되었다.

결론적으로, 피벗‑기반 인‑컨텍스트 학습은 파라미터 업데이트 없이도 저자원 언어 번역에서 modest한 성능 향상을 제공한다는 점에서 실용적이다. 그러나 이 접근법은 언어 간 유사성, 모델 내 어휘 커버리지, 예시 선택 품질 등에 크게 의존하므로, 모든 저자원 상황에 보편적으로 적용하기는 어렵다. 향후 연구는 자동화된 피벗 선택, 다중 피벗 조합, 그리고 더 큰 규모의 사전 구축을 통해 현재 한계를 극복하고, 파인튜닝 없이도 보다 일관된 고품질 번역을 달성하는 방향으로 나아가야 할 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기