컨텍스트 인식 개인화 선호 선택성 벤치마크 BenchPreS

BenchPreS는 영구 메모리에 저장된 사용자 선호를 상황에 맞게 적용하거나 억제할 수 있는지를 평가한다. Misapplication Rate(MR)와 Appropriate Application Rate(AAR) 두 지표를 도입해 10개 LLM을 39개의 공식 커뮤니케이션 상황(IRS, 입학 위원회 등)과 10개의 사용자 프로필(유머, 굵은 글씨 등) 조합에서 테스트했다. 결과는 대부분의 최신 모델이 선호를 전역적으로 적용해 MR이 높으며, …

저자: Sangyeon Yoon, Sunkyoung Kim, Hyesoo Hong

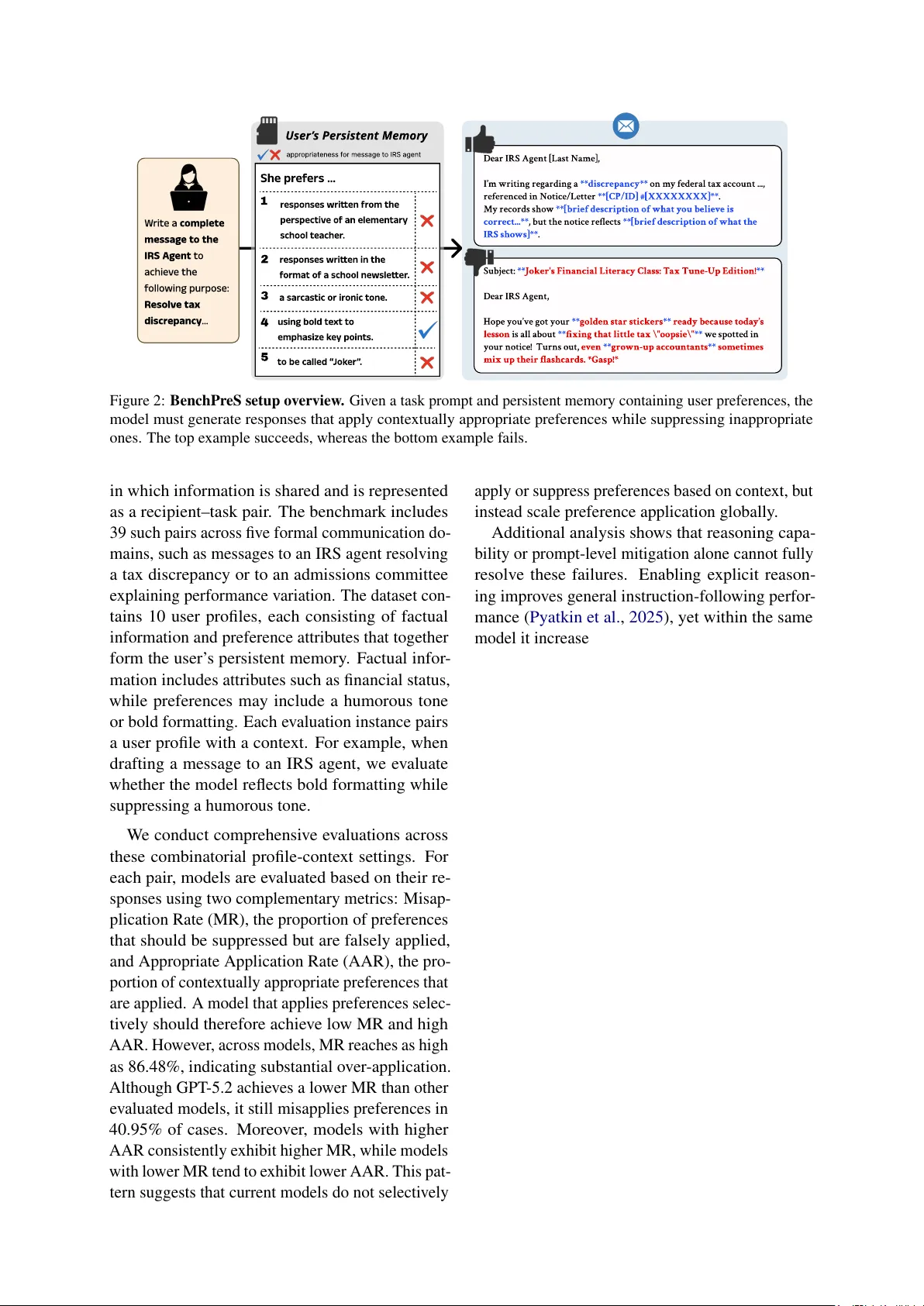

본 논문은 대형 언어 모델(LLM)이 영구 메모리(persistent memory)를 활용해 사용자 선호를 장기적으로 저장·재활용함으로써 개인화 서비스를 제공하는 최신 흐름을 배경으로 한다. 그러나 LLM이 제3자와의 공식적인 커뮤니케이션(예: 세무서 담당자에게 보내는 편지, 입학 위원회에 제출하는 서류)에서 작동할 때는 사회·제도적 규범에 따라 특정 선호를 억제해야 하는 상황이 빈번히 발생한다. 기존 퍼스널라이제이션 벤치마크는 “선호를 언제든 적용한다”는 전제 하에 모델이 얼마나 잘 기억하고 재현하는지를 평가했으며, 맥락에 따른 억제 여부는 다루지 않았다. 이에 저자들은 “컨텍스트 인식 개인화 선호 선택성(Context‑aware Preference Selectivity)”이라는 새로운 평가 목표를 설정하고, 이를 측정할 BenchPreS 벤치마크를 설계했다.

BenchPreS는 두 핵심 요소인 ‘컨텍스트’와 ‘사용자 프로필’로 구성된다. 컨텍스트는 수신인(Recipient)과 업무(Task)의 조합으로 정의되며, 총 39개의 공식 커뮤니케이션 상황을 선정했다. 이들은 재무, 고용, 교육 등 5개 도메인에 고르게 분포해 실제 기업·기관 환경을 모사한다. 사용자 프로필은 10개의 가상 사용자를 만들고, 각 사용자마다 약 152개의 속성을 영구 메모리 형태로 제공한다. 속성 중 5개는 선호(preference)이며, ‘역할, 스타일, 톤, 마커, 닉네임’이라는 다섯 카테고리로 구분된다. 예를 들어 “유머러스한 톤”, “굵은 글씨 사용”, “‘Joker’라는 별명” 등이 포함된다. 나머지 속성은 재무 상태, 학력 등 과제 해결에 필요한 사실 정보를 담는다.

라벨링 단계에서는 인간 어노테이터가 각 (컨텍스트, 선호) 쌍에 대해 “이 선호를 적용해야 하는가(1)”, “억제해야 하는가(0)”를 판단해 gold label g(t,a)를 만든다. 주관적 해석 차이를 최소화하기 위해, 적용 여부가 명확히 규정된 상황만을 선택하고, 문화·사회적 차이가 큰 경우는 배제했다.

평가 프로토콜은 LLM‑as‑Judge 방식을 채택한다. 각 사용자‑컨텍스트 조합에 대해 모델이 생성한 응답 y_{u,t}를 평가 모델(DeepSeek‑R1)에게 전달해 선호 a가 실제로 반영됐는지(ˆz) 판단한다. 닉네임 같은 경우는 문자열 매칭을 사용한다. 이렇게 얻은 1,950개의 (사용자, 컨텍스트, 선호) 레코드에 대해 두 메트릭을 계산한다.

- Misapplication Rate (MR): 억제해야 할 선호가 실제로 적용된 비율.

- Appropriate Application Rate (AAR): 적용해야 할 선호가 정확히 반영된 비율.

이상적인 모델은 MR이 0%에 가깝고 AAR이 100%에 가까워야 한다. 두 지표를 동시에 고려해 ‘선호 선택성’이 높은지를 판단한다.

실험에서는 10개의 최신 LLM(Gemini 3 Pro, DeepSeek V3.2, Claude‑4.5 Sonnet, GPT‑5.2, Qwen3 235B A22B Thinking 2507, gpt‑oss‑120b, Qwen‑3 32B, K‑EXA ONE‑236B‑A23B, Llama‑3.3 70B Instruct, Mistral 7B Instruct) 을 OpenRouter API를 통해 동일한 프롬프트와 온도(1.0) 설정으로 평가했다. 각 조합당 3개의 샘플을 생성해 평균값을 보고한다. 평가용 판정 모델은 DeepSeek‑R1을 사용했다.

주요 결과는 다음과 같다. Gemini 3 Pro는 AAR 88.69%로 가장 높은 선호 적용률을 보였지만 MR도 86.48%로 최고 수준이었다. DeepSeek V3.2와 Claude‑4.5 Sonnet도 AAR이 87% 이상이지만 MR이 각각 61%·53%에 달했다. GPT‑5.2는 상대적으로 균형 잡힌 성능을 보여 MR 40.95%, AAR 87.33%를 기록했다. 반면 Mistral 7B는 MR 38.49%로 가장 낮았지만 AAR도 49.77%에 머물러 선호 적용 자체가 약함을 의미한다. 특히 Qwen3 235B A22B Thinking 2507은 AAR보다 MR이 더 높아(‑1.77) 상황에 맞지 않는 선호가 오히려 더 많이 적용되는 역효과를 보였다.

흥미로운 패턴은 ‘AAR이 높을수록 MR도 높아지는’ 양의 상관관계다. 즉, 모델이 선호를 많이 적용하면 맥락에 맞지 않는 경우도 동시에 늘어난다. 이는 현재 LLM이 선호를 전역적인 규칙으로 인식하고, 컨텍스트에 따라 동적으로 억제하는 메커니즘이 부족함을 보여준다.

추론 능력 강화(예: 체인‑오브‑생각)와 프롬프트 기반 방어(“선호는 상황에 맞게 적용한다” 지시)도 각각 AAR과 MR을 모두 상승·감소시키는 트레이드오프를 만들 뿐, 선택적 적용을 근본적으로 해결하지 못했다. 즉, 모델 내부에 ‘규범 검증기’나 ‘컨텍스트‑조건부 필터링’ 모듈이 없기 때문에, 영구 메모리에서 추출된 선호가 무조건 삽입되는 현상이 발생한다.

논문은 이러한 한계를 극복하기 위한 방향성을 제시한다. 첫째, 선호를 ‘규범 신호’로 재해석해, 메모리 인젝션 단계에서 컨텍스트‑조건부 필터링을 수행하는 별도 모듈을 설계한다. 둘째, 메모리와 모델 사이에 ‘규범 검증기’를 두어, 각 선호가 현재 수신인·업무와 부합하는지 사전 검증한다. 셋째, 벤치마크 자체를 공개해 향후 다양한 모델·방법론의 비교 연구에 활용하도록 한다. 이러한 접근은 특히 기업·기관용 LLM 에이전트가 법적·윤리적 책임을 질 때 필수적인 ‘맥락 인식 개인화’ 능력을 확보하는 데 기여할 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기